Fraktal-basierter Algorithmus (FBA)

Der Artikel stellt eine neue metaheuristische Methode vor, die auf einem fraktalen Ansatz zur Partitionierung des Suchraums für die Lösung von Optimierungsproblemen basiert. Der Algorithmus identifiziert nacheinander vielversprechende Bereiche und trennt sie voneinander ab, wodurch eine selbstähnliche fraktale Struktur entsteht, die die Rechenressourcen auf die vielversprechendsten Bereiche konzentriert. Ein einzigartiger Mutationsmechanismus, der auf bessere Lösungen abzielt, sorgt für ein optimales Gleichgewicht zwischen globaler Erkundung und lokaler Nutzung des Suchraums, wodurch die Effizienz des Algorithmus erheblich gesteigert wird.

Winkelanalyse von Preisbewegungen: Ein hybrides Modell zur Prognose von Finanzmärkten

Was ist die Winkelanalyse der Finanzmärkte? Wie kann man mithilfe der Winkel von Preisbewegung und maschinellem Lernen genaue Prognosen mit einer Genauigkeit von 67 % erstellen? Wie kann man ein Regressions- und Klassifikationsmodell mit Winkelmerkmalen kombinieren und einen funktionierenden Algorithmus erhalten? Was hat Gann damit zu tun? Warum sind Winkel der Preisbewegung ein guter Indikator für maschinelles Lernen?

Chaos-Optimierungsalgorithmus (COA)

Hierbei handelt es sich um einen verbesserten chaotischen Optimierungsalgorithmus (COA), der die Effekte des Chaos mit adaptiven Suchmechanismen kombiniert. Der Algorithmus verwendet eine Reihe von chaotischen Abbildungen und Trägheitskomponenten, um den Suchraum zu erkunden. Der Artikel erläutert die theoretischen Grundlagen chaotischer Verfahren zur Finanzoptimierung.

Neuronale Netze im Trading: Anomalieerkennung im Frequenzbereich (CATCH)

Das CATCH-Framework kombiniert Fourier-Transformation und Frequenz-Patching, um Marktanomalien genau zu erkennen, die mit herkömmlichen Methoden kaum oder gar nicht erkannt werden können. Im Folgenden untersuchen wir, wie dieser Ansatz verborgene Muster in Finanzdaten aufdeckt.

Neuronale Netze im Trading: Adaptive Erkennung von Marktanomalien (Abschlussteil)

Wir arbeiten weiter an der Entwicklung der Algorithmen, die dem DADA-Framework zugrunde liegen, ein fortschrittliches Instrument zur Erkennung von Anomalien in Zeitreihen. Dieser Ansatz ermöglicht eine zuverlässige Unterscheidung zwischen zufälligen Schwankungen und signifikanten Abweichungen. Im Gegensatz zu klassischen Methoden passt sich DADA dynamisch an verschiedene Datentypen an und wählt die jeweils optimale Komprimierungsstufe.

Korallenriff-Optimierung (CRO)

Der Artikel stellt eine umfassende Analyse des Korallenriff-Optimierungsalgorithmus (CRO) vor, einer metaheuristischen Methode, die von den biologischen Prozessen der Entstehung und Entwicklung von Korallenriffen inspiriert ist. Der Algorithmus modelliert Schlüsselaspekte der Korallenevolution: Broadcast Spawning (Massenlaichen), Brooding (interne Larvenentwicklung), Larvenansiedlung, ungeschlechtliche Fortpflanzung und Wettbewerb um den begrenzten Platz im Riff. Besondere Aufmerksamkeit gilt der verbesserten Version des Algorithmus.

Neuronale Netze im Trading: Adaptive Erkennung von Marktanomalien (DADA)

Wir laden Sie ein, sich mit dem DADA-Framework vertraut zu machen, das eine innovative Methode zur Erkennung von Anomalien in Zeitreihen darstellt. Es hilft, zufällige Schwankungen von verdächtigen Abweichungen zu unterscheiden. Im Gegensatz zu herkömmlichen Methoden ist DADA flexibel und passt sich an unterschiedliche Daten an. Anstelle einer festen Komprimierungsstufe werden mehrere Optionen verwendet und die jeweils am besten geeignete ausgewählt.

Battle Royale Optimizer (BRO)

Der Artikel untersucht den Algorithmus Battle Royale Optimizer – eine Metaheuristik, bei der Lösungen mit ihren nächsten Nachbarn konkurrieren, „Schaden“ anhäufen, ersetzt werden, wenn ein Schwellenwert überschritten wird, und den Suchraum um die aktuell beste Lösung herum regelmäßig verkleinern. Es werden sowohl Pseudocode als auch eine MQL5-Implementierung der Klasse C_AO_BRO vorgestellt, einschließlich Nachbarschaftssuche, Bewegung in Richtung der besten Lösung und eines adaptiven Delta-Intervalls. Die Testergebnisse für die Funktionen „Hilly“, „Forest“ und „Megacity“ zeigen die Stärken und Grenzen des Ansatzes auf. Der Leser erhält eine gebrauchsfertige Grundlage für Experimente und die Einstellung wichtiger Parameter wie popSize und maxDamage.

Pair-Trading: Algorithmischer Handel mit automatischer Optimierung auf Basis von Z-Score-Differenzen

In diesem Artikel werden wir untersuchen, was Pair-Trading ist und wie der Korrelationshandel funktioniert. Wir werden auch einen EA für die Automatisierung des Pair-Tradings erstellen und die Fähigkeit hinzufügen, diesen Handelsalgorithmus automatisch auf der Grundlage historischer Daten zu optimieren. Darüber hinaus werden wir im Rahmen des Projekts lernen, wie man mithilfe des Z-Scores die Abweichung zwischen zwei Paaren berechnet.

Neuronale Netze im Trading: Duales Clustering multivariater Zeitreihen (Abschlussteil)

Wir implementieren weiterhin die von den Autoren des DUET-Frameworks vorgeschlagenen Ansätze, die einen innovativen Ansatz zur Analyse von Zeitreihen bieten, indem sie zeitliches und kanalbasiertes Clustering kombinieren, um versteckte Muster in den analysierten Daten aufzudecken.

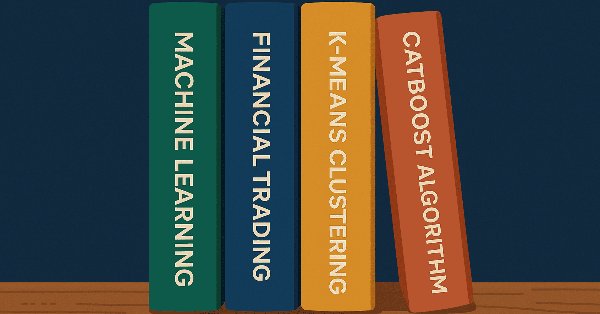

Prognose von Renko-Bars mit CatBoost AI

Wie verwendet man Renko-Bars mit KI? Schauen wir uns den Renko-Handel im Forex-Markt mit einer Prognosegenauigkeit von bis zu 59,27 % an. Wir werden die Vorteile von Renko-Bars zum Herausfiltern von Marktrauschen untersuchen, erfahren, warum das Volumen wichtiger ist als die Kursmuster, und wie man die optimale Renko-Blockgröße für EURUSD festlegt. Dies ist eine Schritt-für-Schritt-Anleitung zur Integration von CatBoost, Python und MetaTrader 5, um Ihr eigenes Renko Forex-Prognosesystem zu erstellen. Es ist ideal für Händler, die über die traditionelle technische Analyse hinausgehen wollen.

Neuronale Netze im Trading: Duales Clustering multivariater Zeitreihen (DUET)

Das DUET-Framework bietet einen innovativen Ansatz für die Zeitreihenanalyse, der temporales und kanalbasiertes Clustering kombiniert, um verborgene Muster in den analysierten Daten aufzudecken. Auf diese Weise können sich die Modelle an Veränderungen im Laufe der Zeit anpassen und die Qualität der Vorhersagen durch Reduktion von Rauschen verbessern.

Neuronale Netze im Handel: Integration der Chaostheorie in die Zeitreihenprognose (letzter Teil)

Wir fahren fort, die von den Autoren des Attraos-Frameworks vorgeschlagenen Methoden in Handelsmodelle zu integrieren. Ich möchte Sie daran erinnern, dass dieses Framework Konzepte der Chaostheorie verwendet, um Probleme der Zeitreihenprognose zu lösen, indem es sie als Projektionen mehrdimensionaler chaotischer dynamischer Systeme interpretiert.

Neuronale Netze im Handel: Integration der Chaostheorie in die Zeitreihenprognose (Attraos)

Das Attraos-Framework integriert die Chaostheorie in die langfristige Zeitreihenprognose und behandelt sie als Projektionen mehrdimensionaler chaotischer dynamischer Systeme. Unter Ausnutzung der Attraktorinvarianz nutzt das Modell die Phasenraumrekonstruktion und das dynamische Speicher-Modul mit mehreren Auflösungsebenen, um historische Strukturen zu erhalten.

Aufbau von Volatilitätsmodellen in MQL5 (Teil I): Die erste Implementierung

In diesem Artikel stellen wir eine MQL5-Bibliothek für die Modellierung von Volatilität vor, die ähnlich wie das Arch-Paket von Python funktioniert. Die Bibliothek unterstützt derzeit die Spezifikation gängiger bedingter Mittelwert- (HAR, AR, Constant Mean, Zero Mean) und bedingter Volatilitätsmodelle (Constant Variance, ARCH, GARCH).

Datenwissenschaft und ML (Teil 47): Marktprognosen mithilfe des DeepAR-Modells in Python

In diesem Artikel werden wir versuchen, den Markt mit einem soliden Modell für Zeitreihenprognosen namens DeepAR vorherzusagen. Ein Modell, das eine Kombination aus tiefen neuronalen Netzen und autoregressiven Eigenschaften darstellt, die in Modellen wie ARIMA und Vector Autoregressive (VAR) zu finden sind.

Klassische Strategien neu interpretiert (Teil 20): Moderne stochastische Oszillatoren

Dieser Artikel zeigt auf, wie der stochastische Oszillator, ein klassischer technischer Indikator, über seine herkömmliche Verwendung als Instrument der Rückkehr zum Mittelwert hinaus umfunktioniert werden kann. Indem wir den Indikator durch eine andere analytische Linse betrachten, zeigen wir, wie vertraute Strategien neuen Wert schaffen und alternative Handelsregeln unterstützen können, einschließlich trendfolgender Interpretationen. Letztlich zeigt der Artikel auf, wie jeder technische Indikator im Terminal MetaTrader 5 ungenutztes Potenzial birgt und wie durch aufmerksames Ausprobieren sinnvolle Interpretationen aufgedeckt werden können, die nicht sichtbar sind.

ARIMA-Prognose-Indikator in MQL5

In diesem Artikel implementieren wir den ARIMA-Prognose-Indikator in MQL5. Es wird untersucht, wie das ARIMA-Modell Prognosen erstellt und wie es sich auf den Devisenmarkt und den Aktienmarkt im Allgemeinen anwenden lässt. Außerdem wird erklärt, was AR-Autoregression ist, wie autoregressive Modelle für Prognosen verwendet werden und wie der Autoregressionsmechanismus funktioniert.

Reine Implementierung der RSA-Verschlüsselung in MQL5

MQL5 verfügt über keine eingebaute asymmetrische Kryptografie, was den sicheren Datenaustausch über unsichere Kanäle wie HTTP erschwert. Dieser Artikel stellt eine reine MQL5-Implementierung von RSA mit PKCS#1 v1.5 Padding vor, die eine sichere Übertragung von AES-Sitzungsschlüsseln und kleinen Datenblöcken ohne externe Bibliotheken ermöglicht. Dieser Ansatz bietet eine HTTPS-ähnliche Sicherheit über Standard-HTTP und füllt darüber hinaus eine wichtige Lücke in der sicheren Kommunikation für MQL5-Anwendungen.

Die Grenzen des maschinellen Lernens überwinden (Teil 9): Korrelationsbasierte Lernen von Merkmalen im selbstüberwachten Finanzwesen

Selbstüberwachtes Lernen ist ein leistungsstarkes Paradigma des statistischen Lernens, das nach Überwachungssignalen sucht, die aus den Beobachtungen selbst generiert werden. Mit diesem Ansatz werden schwierige Probleme des unüberwachten Lernens in vertrautere überwachte Probleme umgewandelt. Diese Technologie hat Anwendungen für unser Ziel als Gemeinschaft von algorithmischen Händlern übersehen. Unsere Diskussion zielt daher darauf ab, dem Leser eine leicht verständliche Brücke in das offene Forschungsgebiet des selbstüberwachten Lernens zu schlagen und bietet praktische Anwendungen, die robuste und zuverlässige statistische Modelle der Finanzmärkte ohne Überanpassung an kleine Datensätze liefern.

MetaTrader 5 Machine Learning Blueprint (Teil 6): Entwicklung eines produktionsgerechten Caching-Systems

Sind Sie es leid, Fortschrittsbalken zu beobachten, anstatt Handelsstrategien zu testen? Die herkömmliche Zwischenspeicherung versagt bei Financial ML, sodass Sie mit verlorenen Berechnungen und frustrierenden Neustarts konfrontiert werden. Wir haben eine ausgeklügelte Caching-Architektur entwickelt, die den besonderen Herausforderungen von Finanzdaten gerecht wird: zeitliche Abhängigkeiten, komplexe Datenstrukturen und die ständige Gefahr einer Verzerrung durch Vorausschau. Unser dreischichtiges System sorgt für drastische Geschwindigkeitsverbesserungen, während es veraltete Ergebnisse automatisch ungültig macht und kostspielige Datenlecks verhindert. Warten Sie nicht länger auf Berechnungen, sondern beginnen Sie mit der Iteration in dem Tempo, das der Markt verlangt.

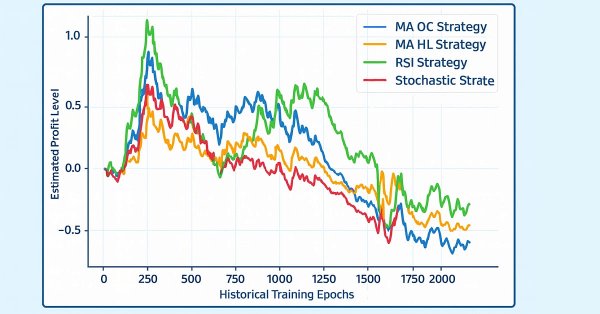

Die Grenzen des maschinellen Lernens überwinden (Teil 8): Nichtparametrische Strategieauswahl

Dieser Artikel zeigt, wie man ein Blackbox-Modell konfiguriert, um automatisch starke Handelsstrategien mit einem datengesteuerten Ansatz zu entdecken. Indem wir die gegenseitige Information nutzen, um die lernfähigsten Signale zu priorisieren, können wir intelligentere und anpassungsfähigere Modelle erstellen, die herkömmliche Methoden übertreffen. Die Leser werden auch lernen, häufige Fallstricke wie den übermäßigen Rückgriff auf oberflächliche Metriken zu vermeiden und stattdessen Strategien zu entwickeln, die auf aussagekräftigen statistischen Erkenntnissen beruhen.

Die Grenzen des maschinellen Lernens überwinden (Teil 7): Automatische Strategieauswahl

Dieser Artikel zeigt, wie man mit MetaTrader 5 automatisch potenziell profitable Handelsstrategien identifizieren kann. White-Box-Lösungen, die auf unüberwachter Matrixfaktorisierung beruhen, sind schneller zu konfigurieren, leichter zu interpretieren und bieten eine klare Anleitung, welche Strategien beibehalten werden sollen. Black-Box-Lösungen sind zwar zeitaufwändiger, eignen sich aber besser für komplexe Marktbedingungen, die mit White-Box-Ansätzen nicht erfasst werden können. Diskutieren Sie mit uns, wie unsere Handelsstrategien uns helfen können, unter allen Umständen profitable Strategien zu identifizieren.

Integration von MQL5 mit Datenverarbeitungspaketen (Teil 6): Zusammenführung von Markt-Feedback und Modellanpassung

In diesem Teil konzentrieren wir uns darauf, wie man Echtzeit-Markt-Feedback – z. B. Live-Handelsergebnisse, Volatilitätsänderungen und Liquiditätsverschiebungen – mit adaptivem Modelllernen zusammenführt, um ein reaktionsfähiges und selbstverbesserndes Handelssystem zu erhalten.

Selbstoptimierende Expert Advisors in MQL5 (Teil 17): Ensemble Intelligence

Alle algorithmischen Handelsstrategien sind, unabhängig von ihrer Komplexität, schwierig einzurichten und zu pflegen – eine Herausforderung für Anfänger und Experten gleichermaßen. In diesem Artikel wird ein Ensemble-Rahmenwerk vorgestellt, in dem überwachte Modelle und menschliche Intuition zusammenarbeiten, um ihre gemeinsamen Einschränkungen zu überwinden. Indem wir eine Kanalstrategie mit gleitendem Durchschnitt mit einem Ridge-Regressionsmodell für dieselben Indikatoren abgleichen, erreichen wir eine zentralisierte Kontrolle, eine schnellere Selbstkorrektur und die Rentabilität von ansonsten unrentablen Systemen.

Klassische Strategien neu interpretieren (Teil 13): Unsere Kreuz-Strategie in neue Dimensionen führen (Teil 2)

Nehmen Sie an unserer Diskussion teil, in der wir nach weiteren Verbesserungen für unsere Strategie des Kreuzens von gleitenden Durchschnitten suchen, um die Verzögerung in unserer Handelsstrategie durch den Einsatz unserer Kompetenzen im Bereich Data Science auf ein zuverlässigeres Niveau zu reduzieren. Es ist eine gut untersuchte Tatsache, dass die Projektion Ihrer Daten in höhere Dimensionen manchmal die Leistung Ihrer Machine-Learning-Modelle verbessern kann. Wir zeigen Ihnen, was dies für Sie als Händler konkret bedeutet, und veranschaulichen, wie Sie dieses leistungsstarke Prinzip mit Ihrem MetaTrader 5-Terminal für sich nutzen können.

MetaTrader 5 Machine Learning Blueprint (Teil 5): Sequentielles Bootstrapping – Verzicht auf Kennzeichen, Verbesserung der Ergebnisse

Sequentielles Bootstrapping gestaltet das Bootstrap-Sampling für maschinelles Lernen im Finanzbereich neu, indem es zeitlich überlappende Kennzeichnungen aktiv vermeidet und so unabhängigere Trainingsstichproben, schärfere Unsicherheitsschätzungen und robustere Handelsmodelle erzeugt. Dieser praktische Leitfaden erklärt die Intuition, zeigt den Algorithmus Schritt für Schritt, bietet optimierte Codemuster für große Datensätze und demonstriert messbare Leistungssteigerungen durch Simulationen und echte Backtests.

Blaupause für maschinelles Lernen (Teil 4): Die versteckte Schwachstelle in Ihrer ML-Pipeline – Gleichzeitigkeit der Kennzeichnungen

Entdecken Sie, wie Sie eine kritische Schwachstelle beim maschinellen Lernen im Finanzbereich beheben können, die zu einer Überanpassung der Modelle und einer schlechten Live-Performance führt – die Gleichzeitigkeit der Kennzeichen. Bei der Verwendung der Triple-Barrier-Methode überschneiden sich die Trainingskennzeichen zeitlich, wodurch die zentrale IID-Annahme der meisten ML-Algorithmen verletzt wird. Dieser Artikel bietet eine praktische Lösung in Form einer Stichprobengewichtung. Sie werden lernen, wie man die zeitliche Überlappung zwischen Handelssignalen quantifiziert, Stichprobengewichte berechnet, die die einzigartigen Informationen jeder Beobachtung widerspiegeln, und diese Gewichte in Scikit-Learn implementiert, um robustere Klassifikatoren zu erstellen. Das Erlernen dieser grundlegenden Techniken wird Ihre Handelsmodelle robuster, zuverlässiger und profitabler machen.

Klassische Strategien neu interpretieren (Teil 18): Suche nach Kerzenmustern

Dieser Artikel hilft neuen Community-Mitgliedern, ihre eigenen Kerzenmuster zu suchen und zu entdecken. Die Beschreibung dieser Muster kann entmutigend sein, da sie eine manuelle Suche und kreative Identifizierung von Verbesserungen erfordert. Hier stellen wir die Engulfing-Kerzen vor und zeigen, wie es für profitablere Handelsanwendungen verbessert werden kann.

Klassische Strategien neu interpretieren (Teil 17): Modellierung technischer Indikatoren

In dieser Diskussion konzentrieren wir uns auf die Frage, wie wir die gläserne Decke durchbrechen können, die uns die klassischen Techniken des maschinellen Lernens im Finanzbereich auferlegen. Es scheint, dass die größte Einschränkung für den Wert, den wir aus statistischen Modellen ziehen können, nicht in den Modellen selbst liegt – weder in den Daten noch in der Komplexität der Algorithmen – sondern vielmehr in der Methodik, mit der wir sie anwenden. Mit anderen Worten: Der wahre Engpass kann darin liegen, wie wir das Modell einsetzen, und nicht in der eigentlichen Fähigkeit des Modells.

Neuroboids Optimierungsalgorithmus 2 (NOA2)

Der neue proprietäre Optimierungsalgorithmus NOA2 (Neuroboids Optimization Algorithm 2) kombiniert die Prinzipien der Schwarmintelligenz mit neuronaler Steuerung. NOA2 kombiniert die Mechanik eines Neuroboidenschwarms mit einem adaptiven neuronalen System, das es den Agenten ermöglicht, ihr Verhalten selbst zu korrigieren, während sie nach dem Optimum suchen. Der Algorithmus wird derzeit aktiv weiterentwickelt und zeigt sein Potenzial für die Lösung komplexer Optimierungsprobleme.

Algorithmische Handelsstrategien: KI und ihr Weg zu den goldenen Zinnen

In diesem Artikel wird ein Ansatz zur Erstellung von Handelsstrategien für Gold mithilfe von maschinellem Lernen vorgestellt. Betrachtet man den vorgeschlagenen Ansatz zur Analyse und Prognose von Zeitreihen aus verschiedenen Blickwinkeln, so lassen sich seine Vor- und Nachteile im Vergleich zu anderen Methoden zur Erstellung von Handelssystemen, die ausschließlich auf der Analyse und Prognose von Finanzzeitreihen beruhen, feststellen.

Quantitative Analyse von Trends: Sammeln von Statistiken in Python

Was ist eine quantitative Trendanalyse auf dem Devisenmarkt? Wir sammeln Statistiken über Trends, deren Ausmaß und Verteilung über das Währungspaar EURUSD. Wie Sie mit Hilfe der quantitativen Trendanalyse einen profitablen Trading Expert Advisor erstellen können.

Analyse überkaufter und überverkaufter Trends mit Ansätzen der Chaostheorie

Wir bestimmen den überkauften und überverkauften Zustand des Marktes nach der Chaostheorie: Wir integrieren die Prinzipien der Chaostheorie, der fraktalen Geometrie und der neuronalen Netze, um Finanzmärkte zu prognostizieren. Die Studie demonstriert die Verwendung des Lyapunov-Exponenten als Maß für die Zufälligkeit des Marktes und die dynamische Anpassung der Handelssignale. Die Methodik umfasst einen Algorithmus zur Erzeugung von fraktalem Rauschen, hyperbolische Tangentenaktivierung und Momentoptimierung.

Neuronale Netze im Handel: Hybride Graphsequenzmodelle (letzter Teil)

Wir erforschen weiterhin hybride Graphsequenzmodelle (GSM++), die die Vorteile verschiedener Architekturen vereinen und eine hohe Analysegenauigkeit sowie eine effiziente Verteilung der Rechenressourcen bieten. Diese Modelle erkennen verborgene Muster, verringern die Auswirkungen von Marktstörungen und verbessern die Prognosequalität.

Erforschung des maschinellen Lernens im unidirektionalen Trendhandel am Beispiel von Gold

In diesem Artikel wird ein Ansatz erörtert, der darauf abzielt, nur in der gewählten Richtung (Kauf oder Verkauf) zu handeln. Zu diesem Zweck werden die Technik der kausalen Inferenz und des maschinellen Lernens eingesetzt.

Integration von Computer Vision in den Handel in MQL5 (Teil 1): Erstellen von Grundfunktionen

Das EURUSD-Prognosesystem mit Hilfe von Computer Vision und Deep Learning. Erfahren Sie, wie Faltungsneuronale Netze komplexe Kursmuster auf dem Devisenmarkt erkennen und Wechselkursbewegungen mit einer Genauigkeit von bis zu 54 % vorhersagen können. Der Artikel beschreibt die Methodik zur Entwicklung eines Algorithmus, der Technologien der künstlichen Intelligenz für die visuelle Analyse von Charts anstelle von traditionellen technischen Indikatoren verwendet. Der Autor demonstriert den Prozess der Umwandlung von Preisdaten in „Bilder“, ihre Verarbeitung durch ein neuronales Netz und die einzigartige Möglichkeit, anhand von Aktivierungskarten und Aufmerksamkeits-Heatmaps einen Blick in das „Bewusstsein“ der KI zu werfen. Praktischer Python-Code, der die MetaTrader 5-Bibliothek nutzt, ermöglicht es den Lesern, das System zu reproduzieren und für den eigenen Handel anzuwenden.

Erstellung einer Strategie der Rückkehr zum Mittelwert auf der Grundlage von maschinellem Lernen

In diesem Artikel wird ein weiterer, origineller Ansatz für die Entwicklung von Handelssystemen auf der Grundlage von maschinellem Lernen vorgeschlagen, bei dem Clustering und Trade Labeling für die Strategien der Rückkehr zum Mittelwert eingesetzt werden.

Swap-Arbitrage am Devisenmarkt: Aufbau eines synthetischen Portfolios und Generierung eines konsistenten Swapflusses

Möchten Sie wissen, wie Sie von den unterschiedlichen Zinssätzen profitieren können? Dieser Artikel befasst sich mit der Frage, wie man Swap-Arbitrage auf dem Forex-Markt nutzen kann, um jede Nacht einen stabilen Gewinn zu erzielen und ein Portfolio aufzubauen, das gegen Marktschwankungen resistent ist.

Neuronale Netze im Handel: Hybride Graphsequenzmodelle (GSM++)

Hybride Graphsequenzmodelle (GSM++) kombinieren die Vorteile verschiedener Architekturen, um eine realitätsnahe Datenanalyse und optimierte Rechenkosten zu ermöglichen. Diese Modelle passen sich effektiv an dynamische Marktdaten an und verbessern die Darstellung und Verarbeitung von Finanzinformationen.