Automatisieren von Handelsstrategien in MQL5 (Teil 21): Verbesserung des Handels mit neuronalen Netzen durch adaptive Lernraten

In diesem Artikel verbessern wir eine Handelsstrategie mit neuronalen Netzen in MQL5 mit einer adaptiven Lernrate, um die Genauigkeit zu erhöhen. Wir entwerfen und implementieren diesen Mechanismus und testen anschließend seine Leistungsfähigkeit. Der Artikel schließt mit Optimierungserkenntnissen für den algorithmischen Handel.

Algorithmen zur Optimierung mit Populationen: Widerstand gegen das Steckenbleiben in lokalen Extremen (Teil II)

Wir setzen unser Experiment fort, das darauf abzielt, das Verhalten von Populationsoptimierungsalgorithmen im Zusammenhang mit ihrer Fähigkeit zu untersuchen, lokale Minima bei geringer Populationsvielfalt effizient zu umgehen und globale Maxima zu erreichen. Forschungsergebnisse werden vorgelegt.

Kategorientheorie (Teil 9): Monoid-Aktionen

Dieser Artikel setzt die Serie über die Implementierung der Kategorientheorie in MQL5 fort. Hier setzen wir Monoid-Aktionen als Mittel zur Transformation von Monoiden fort, die im vorigen Artikel behandelt wurden und zu mehr Anwendungen führen.

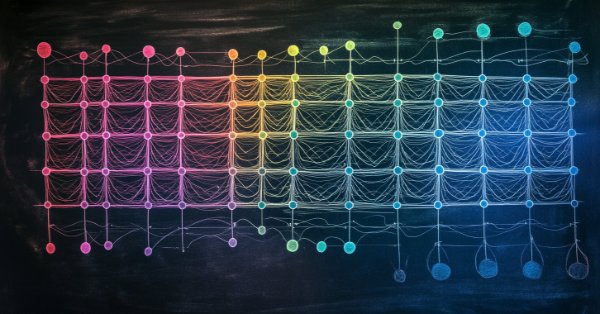

Neuronale Netze leicht gemacht (Teil 76): Erforschung verschiedener Interaktionsmuster mit Multi-Future Transformer

Dieser Artikel setzt das Thema der Vorhersage der kommenden Kursentwicklung fort. Ich lade Sie ein, sich mit der Architektur eines Multi-Future Transformers vertraut zu machen. Die Hauptidee besteht darin, die multimodale Verteilung der Zukunft in mehrere unimodale Verteilungen zu zerlegen, was es ermöglicht, verschiedene Modelle der Interaktion zwischen Agenten auf der Szene effektiv zu simulieren.

Neuronale Netze leicht gemacht (Teil 83): Der „Conformer“-Algorithmus für räumlich-zeitliche kontinuierliche Aufmerksamkeitstransformation

In diesem Artikel wird der Conformer-Algorithmus vorgestellt, der ursprünglich für die Wettervorhersage entwickelt wurde, die in Bezug auf Variabilität und Launenhaftigkeit mit den Finanzmärkten verglichen werden kann. Conformer ist eine komplexe Methode. Es kombiniert die Vorteile von Aufmerksamkeitsmodellen und gewöhnlichen Differentialgleichungen.

Neuronale Netze im Handel: Einspeisung globaler Informationen in unabhängige Kanäle (InjectTST)

Die meisten modernen Methoden zur multimodalen Zeitreihenprognose verwenden den Ansatz unabhängiger Kanäle. Dabei wird die natürliche Abhängigkeit verschiedener Kanäle derselben Zeitreihe ignoriert. Der intelligente Einsatz zweier Ansätze (unabhängige und gemischte Kanäle) ist der Schlüssel zur Verbesserung der Leistung der Modelle.

MQL5-Assistent - Techniken, die Sie kennen sollten (14): Zeitreihenvorhersage mit mehreren Zielvorgaben durch STF

Die räumlich-zeitliche Fusion, bei der sowohl räumliche als auch zeitliche Metriken zur Modellierung von Daten verwendet werden, ist vor allem bei der Fernerkundung und einer Vielzahl anderer visueller Aktivitäten nützlich, um ein besseres Verständnis unserer Umgebung zu erlangen. Dank eines veröffentlichten Artikels verfolgen wir einen neuen Ansatz, indem wir sein Potenzial für Händler untersuchen.

MQL5-Assistenten-Techniken, die Sie kennen sollten (Teil 15): Support-Vektor-Maschinen mit dem Newtonschen Polynom

Support-Vektor-Maschinen klassifizieren Daten auf der Grundlage vordefinierter Klassen, indem sie die Auswirkungen einer Erhöhung der Dimensionalität untersuchen. Es handelt sich um eine überwachte Lernmethode, die angesichts ihres Potenzials, mit mehrdimensionalen Daten umzugehen, ziemlich komplex ist. In diesem Artikel wird untersucht, wie die sehr einfache Implementierung von 2-dimensionalen Daten mit dem Newton'schen Polynom bei der Klassifizierung von Preis-Aktionen effizienter durchgeführt werden kann.

Neuronale Netze im Handel: Ein selbstanpassendes Multi-Agenten-Modell (MASA)

Ich lade Sie ein, sich mit dem Multi-Agent Self-Adaptive (MASA) Framework vertraut zu machen, das Reinforcement Learning und adaptive Strategien kombiniert und ein harmonisches Gleichgewicht zwischen Rentabilität und Risikomanagement unter turbulenten Marktbedingungen bietet.

Neuronale Netze leicht gemacht (Teil 79): Feature Aggregated Queries (FAQ) im Kontext des Staates

Im vorigen Artikel haben wir eine der Methoden zur Erkennung von Objekten in einem Bild kennengelernt. Die Verarbeitung eines statischen Bildes ist jedoch etwas anderes als die Arbeit mit dynamischen Zeitreihen, wie z. B. die Dynamik der von uns analysierten Preise. In diesem Artikel werden wir uns mit der Methode der Objekterkennung in Videos befassen, die dem Problem, das wir lösen wollen, etwas näher kommt.

Brain Storm Optimierungsalgorithmus (Teil I): Clustering

In diesem Artikel befassen wir uns mit einer innovativen Optimierungsmethode namens BSO (Brain Storm Optimization), die von einem natürlichen Phänomen namens „Brainstorming“ inspiriert ist. Wir werden auch einen neuen Ansatz zur Lösung von multimodalen Optimierungsproblemen diskutieren, den die BSO-Methode anwendet. Es ermöglicht die Suche nach mehreren optimalen Lösungen, ohne dass die Anzahl der Teilpopulationen vorher festgelegt werden muss. Wir werden auch die Clustermethoden K-Means und K-Means++ betrachten.

Handelseinblicke über das Volumen: Trendbestätigung

Die Enhanced Trend Confirmation Technique kombiniert Preisaktionen, Volumenanalysen und maschinelles Lernen, um echte Marktbewegungen zu identifizieren. Für die Handelsvalidierung sind sowohl Preisausbrüche als auch Volumensprünge (50 % über dem Durchschnitt) erforderlich, während ein neuronales LSTM-Netzwerk für zusätzliche Bestätigung sorgt. Das System verwendet eine ATR-basierte Positionsgröße und ein dynamisches Risikomanagement, wodurch es an verschiedene Marktbedingungen angepasst werden kann und gleichzeitig falsche Signale herausfiltert.

Neuronale Netze leicht gemacht (Teil 69): Dichte-basierte Unterstützungsbedingung für die Verhaltenspolitik (SPOT)

Beim Offline-Lernen verwenden wir einen festen Datensatz, der die Umweltvielfalt nur begrenzt abdeckt. Während des Lernprozesses kann unser Agent Aktionen generieren, die über diesen Datensatz hinausgehen. Wenn es keine Rückmeldungen aus der Umwelt gibt, wie können wir dann sicher sein, dass die Bewertungen solcher Maßnahmen korrekt sind? Die Beibehaltung der Agentenpolitik innerhalb des Trainingsdatensatzes ist ein wichtiger Aspekt, um die Zuverlässigkeit des Trainings zu gewährleisten. Darüber werden wir in diesem Artikel sprechen.

Neuronale Netze leicht gemacht (Teil 89): Transformer zur Frequenzzerlegung (FEDformer)

Alle Modelle, die wir bisher betrachtet haben, analysieren den Zustand der Umwelt als Zeitfolge. Die Zeitreihen können aber auch in Form von Häufigkeitsmerkmalen dargestellt werden. In diesem Artikel stelle ich Ihnen einen Algorithmus vor, der Frequenzkomponenten einer Zeitsequenz zur Vorhersage zukünftiger Zustände verwendet.

Datenwissenschaft und ML (Teil 41): Mustererkennung mit YOLOv8 im Forex und den Aktienmärkten

Die Erkennung von Mustern auf den Finanzmärkten ist eine Herausforderung, denn dazu muss man sehen, was auf dem Chart zu sehen ist, und das ist in MQL5 aufgrund der Bildbeschränkungen schwierig zu bewerkstelligen. In diesem Artikel werden wir ein anständiges Modell in Python besprechen, das uns hilft, mit minimalem Aufwand Muster im Chart zu erkennen.

Neuronale Netze leicht gemacht (Teil 71): Zielkonditionierte prädiktive Kodierung (Goal-Conditioned Predictive Coding, GCPC)

In früheren Artikeln haben wir die Decision-Transformer-Methode und mehrere davon abgeleitete Algorithmen besprochen. Wir haben mit verschiedenen Zielsetzungsmethoden experimentiert. Während der Experimente haben wir mit verschiedenen Arten der Zielsetzung gearbeitet. Die Studie des Modells über die frühere Trajektorie blieb jedoch immer außerhalb unserer Aufmerksamkeit. In diesem Artikel. Ich möchte Ihnen eine Methode vorstellen, die diese Lücke füllt.

Neuronale Netze leicht gemacht (Teil 74): Trajektorienvorhersage mit Anpassung

In diesem Artikel wird eine recht effektive Methode zur Vorhersage der Trajektorie von Multi-Agenten vorgestellt, die sich an verschiedene Umweltbedingungen anpassen kann.

Die Gruppenmethode der Datenverarbeitung: Implementierung des Kombinatorischen Algorithmus in MQL5

In diesem Artikel setzen wir unsere Untersuchung der Algorithmenfamilie Group Method of Data Handling mit der Implementierung des Kombinatorischen Algorithmus und seiner verfeinerten Variante, dem Kombinatorischen Selektiven Algorithmus in MQL5 fort.

Neuronale Netze leicht gemacht (Teil 84): Umkehrbare Normalisierung (RevIN)

Wir wissen bereits, dass die Vorverarbeitung der Eingabedaten eine wichtige Rolle für die Stabilität der Modellbildung spielt. Für die Online-Verarbeitung von „rohen“ Eingabedaten verwenden wir häufig eine Batch-Normalisierungsschicht. Aber manchmal brauchen wir ein umgekehrtes Verfahren. In diesem Artikel wird einer der möglichen Ansätze zur Lösung dieses Problems erörtert.

MQL5-Assistenten-Techniken, die Sie kennen sollten (Teil 30): Spotlight auf Batch-Normalisierung beim maschinellen Lernen

Die Batch-Normalisierung ist die Vorverarbeitung von Daten, bevor sie in einen Algorithmus für maschinelles Lernen, z. B. ein neuronales Netz, eingespeist werden. Dies geschieht immer unter Berücksichtigung der Art der Aktivierung, die der Algorithmus verwenden soll. Wir untersuchen daher die verschiedenen Ansätze, die man mit Hilfe eines von einem Assistenten zusammengestellten Expert Advisors verfolgen kann, um die Vorteile dieses Ansatzes zu nutzen.

Hidden Markov Modelle für trendfolgende Volatilitätsprognosen

Hidden Markov Modelle (HMM) sind leistungsstarke statistische Instrumente, die durch die Analyse beobachtbarer Kursbewegungen die zugrunde liegenden Marktzustände identifizieren. Im Handel verbessern HMM die Volatilitätsprognose und liefern Informationen für Trendfolgestrategien, indem sie Marktverschiebungen modellieren und antizipieren. In diesem Artikel stellen wir das vollständige Verfahren zur Entwicklung einer Trendfolgestrategie vor, die HMM zur Prognose der Volatilität als Filter einsetzt.

Neuronale Netze leicht gemacht (Teil 92): Adaptive Vorhersage im Frequenz- und Zeitbereich

Die Autoren der FreDF-Methode haben den Vorteil der kombinierten Vorhersage im Frequenz- und Zeitbereich experimentell bestätigt. Die Verwendung von gewichteten Hyperparameter ist jedoch für nicht-stationäre Zeitreihen nicht optimal. In diesem Artikel werden wir uns mit der Methode der adaptiven Kombination von Vorhersagen im Frequenz- und Zeitbereich vertraut machen.

Neuronale Netze leicht gemacht (Teil 91): Vorhersage durch Frequenzbereiche (Frequency Domain Forecasting, FreDF)

Wir fahren fort mit der Analyse und Vorhersage von Zeitreihen im Frequenzbereich. In diesem Artikel machen wir uns mit einer neuen Methode zur Vorhersage von Daten im Frequenzbereich vertraut, die zu vielen der bisher untersuchten Algorithmen hinzugefügt werden kann.

Neuronale Netze im Handel: Zustandsraummodelle

Ein Großteil der bisher untersuchten Modelle basiert auf der Transformer-Architektur. Bei langen Sequenzen können sie jedoch ineffizient sein. In diesem Artikel werden wir uns mit einer alternativen Richtung der Zeitreihenprognose auf der Grundlage von Zustandsraummodellen vertraut machen.

Nutzung des CatBoost Machine Learning Modells als Filter für Trendfolgestrategien

CatBoost ist ein leistungsfähiges, baumbasiertes, maschinelles Lernmodell, das auf die Entscheidungsfindung auf der Grundlage stationärer Merkmale spezialisiert ist. Andere baumbasierte Modelle wie XGBoost und Random Forest haben ähnliche Eigenschaften in Bezug auf ihre Robustheit, ihre Fähigkeit, komplexe Muster zu verarbeiten, und ihre Interpretierbarkeit. Diese Modelle haben ein breites Anwendungsspektrum, das von der Merkmalsanalyse bis zum Risikomanagement reicht.

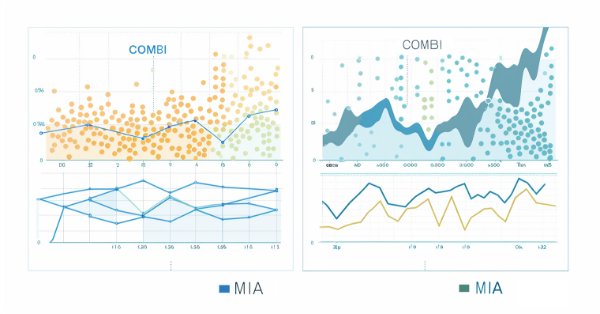

Erstellen von selbstoptimierenden Expert Advisor in MQL5 (Teil 8): Analyse mehrerer Strategien

Wie können wir mehrere Strategien am besten kombinieren, um eine leistungsfähige Gesamtstrategie zu schaffen? Nehmen Sie an dieser Diskussion teil, in der wir drei verschiedene Strategien in unsere Handelsanwendung einbauen wollen. Händler verwenden oft spezielle Strategien für die Eröffnung und Schließung von Positionen, und wir wollen wissen, ob unsere Maschinen diese Aufgabe besser erfüllen können. In unserer einleitenden Diskussion machen wir uns mit den Fähigkeiten des Strategietesters und den Prinzipien der OOP vertraut, die wir für diese Aufgabe benötigen.

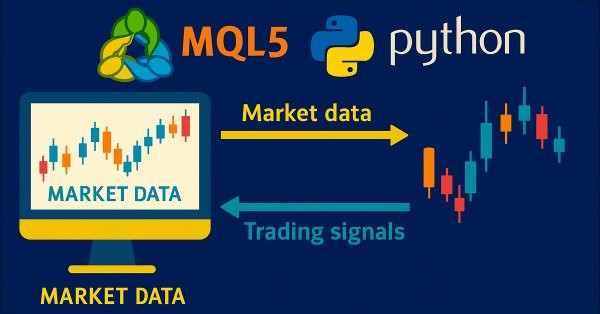

Entwicklung des Price Action Analysis Toolkit (Teil 36): Direkter Python-Zugang zu MetaTrader 5 Market Streams freischalten

Schöpfen Sie das volle Potenzial Ihres MetaTrader 5 Terminals aus, indem Sie das datenwissenschaftliche Ökosystem von Python und die offizielle MetaTrader 5 Client-Bibliothek nutzen. Dieser Artikel zeigt, wie man Live-Tick- und Minutenbalken-Daten direkt in den Parquet-Speicher authentifiziert und streamt, mit Ta und Prophet ein ausgefeiltes Feature-Engineering durchführt und ein zeitabhängiges Gradient-Boosting-Modell trainiert. Anschließend setzen wir einen leichtgewichtigen Flask-Dienst ein, um Handelssignale in Echtzeit zu liefern. Egal, ob Sie ein hybrides Quant-Framework aufbauen oder Ihren EA mit maschinellem Lernen erweitern, Sie erhalten eine robuste Ende-zu-Ende-Pipeline für den datengesteuerten algorithmischen Handel an die Hand.

Entwicklung eines MQL5 RL-Agenten mit Integration von RestAPI (Teil 3): Erstellen von automatischen Bewegungen und Testskripten in MQL5

Dieser Artikel beschreibt die Implementierung von automatischen Zügen im Tic-Tac-Toe-Spiel in Python, integriert mit MQL5-Funktionen und Unit-Tests. Das Ziel ist es, die Interaktivität des Spiels zu verbessern und die Zuverlässigkeit des Systems durch Tests in MQL5 zu gewährleisten. Die Präsentation umfasst die Entwicklung der Spiellogik, die Integration und praktische Tests und schließt mit der Erstellung einer dynamischen Spielumgebung und eines robusten integrierten Systems.

Ein Algorithmus zur Auswahl von Merkmalen, der energiebasiertes Lernen in reinem MQL5 verwendet

In diesem Artikel stellen wir die Implementierung eines Algorithmus zur Auswahl von Merkmalen vor, der in einer wissenschaftlichen Arbeit mit dem Titel „FREL: A stable feature selection algorithm“ vorgestellt wurde und auch als Merkmalsgewichtung als reguliertes energiebasiertes Lernen bezeichnet werden kann.

Neuronale Netze leicht gemacht (Teil 70): Operatoren der Closed-Form Policy Improvement (CFPI)

In diesem Artikel werden wir uns mit einem Algorithmus vertraut machen, der geschlossene Operatoren zur Verbesserung der Politik verwendet, um die Aktionen des Agenten im Offline-Modus zu optimieren.

Schneller Handelsstrategie-Tester in Python mit Numba

Der Artikel implementiert einen schnellen Strategietester für maschinelle Lernmodelle unter Verwendung von Numba. Das ist 50 Mal schneller als der reine Python-Strategie-Tester. Der Autor empfiehlt die Verwendung dieser Bibliothek, um mathematische Berechnungen zu beschleunigen, insbesondere solche, die Schleifen beinhalten.

MQL5-Assistent-Techniken, die Sie kennen sollten (Teil 31): Auswahl der Verlustfunktion

Die Verlustfunktion ist die wichtigste Kennzahl für Algorithmen des maschinellen Lernens, die eine Rückmeldung für den Trainingsprozess liefert, indem sie angibt, wie gut ein bestimmter Satz von Parametern im Vergleich zum beabsichtigten Ziel funktioniert. Wir untersuchen die verschiedenen Formate dieser Funktion in einer nutzerdefinierten MQL5-Assistenten-Klasse.

Verschaffen Sie sich einen Vorteil auf jedem Markt (Teil IV): CBOE: Volatilitätsindizes von Euro und Gold

Wir werden alternative, von der Chicago Board Of Options Exchange (CBOE) kuratierte Daten analysieren, um die Genauigkeit unserer tiefen neuronalen Netze bei der Vorhersage des XAUEUR-Symbols zu verbessern.

Algorithmus für eine auf künstlichen Ökosystemen basierende Optimierung (AEO)

Der Artikel befasst sich mit einem metaheuristischen AEO-Algorithmus (Artificial Ecosystem-based Optimization), der Interaktionen zwischen Ökosystemkomponenten simuliert, indem er eine anfängliche Lösungspopulation erstellt und adaptive Aktualisierungsstrategien anwendet, und beschreibt im Detail die Phasen des AEO-Betriebs, einschließlich der Verbrauchs- und Zersetzungsphasen, sowie verschiedene Agentenverhaltensstrategien. Der Artikel stellt die Merkmale und Vorteile dieses Algorithmus vor.

Selbstoptimierende Expert Advisors in MQL5 (Teil 12): Aufbau von linearen Klassifikatoren durch Matrixfaktorisierung

Dieser Artikel befasst sich mit der leistungsfähigen Rolle der Matrixfaktorisierung im algorithmischen Handel, insbesondere in MQL5-Anwendungen. Von Regressionsmodellen bis hin zu Multi-Target-Klassifikatoren gehen wir durch praktische Beispiele, die zeigen, wie einfach diese Techniken mit Hilfe von integrierten MQL5-Funktionen integriert werden können. Ganz gleich, ob Sie die Kursrichtung vorhersagen oder das Verhalten von Indikatoren modellieren wollen, dieser Leitfaden schafft eine solide Grundlage für den Aufbau intelligenter Handelssysteme mit Hilfe von Matrixmethoden.

Algorithmischer Handel auf der Grundlage von 3D-Umkehrmustern

Die Entdeckung einer neuen Welt des automatisierten Handels mit 3D-Bars. Wie sieht ein Handelsroboter auf mehrdimensionalen Preisbalken aus? Sind „gelbe“ Cluster von 3D-Balken in der Lage, Trendumkehrungen vorherzusagen? Wie sieht der multidimensionale Handel aus?

Die Basisklasse der Populationsalgorithmen als Rückgrat einer effizienten Optimierung

Der Artikel präsentiert einen einzigartigen Forschungsversuch, eine Vielzahl von Populationsalgorithmen in einer einzigen Klasse zu kombinieren, um die Anwendung von Optimierungsmethoden zu vereinfachen. Dieser Ansatz eröffnet nicht nur Möglichkeiten für die Entwicklung neuer Algorithmen, einschließlich hybrider Varianten, sondern schafft auch eine universelle Basis-Testumgebung. Dieser Stand wird zu einem wichtigen Instrument für die Auswahl des optimalen Algorithmus für eine bestimmte Aufgabe.

Algorithmus einer chemischen Reaktionsoptimierung (CRO) (Teil I): Prozesschemie in der Optimierung

Im ersten Teil dieses Artikels werden wir in die Welt der chemischen Reaktionen eintauchen und einen neuen Ansatz zur Optimierung entdecken! Die chemische Reaktionsoptimierung (CRO) nutzt Prinzipien, die sich aus den Gesetzen der Thermodynamik ableiten, um effiziente Ergebnisse zu erzielen. Wir werden die Geheimnisse der Zersetzung, der Synthese und anderer chemischer Prozesse lüften, die die Grundlage für diese innovative Methode bilden.

MQL5-Assistenten-Techniken, die Sie kennen sollten (Teil 28): GANs überarbeitet mit einer Anleitung zu Lernraten

Die Lernrate ist eine Schrittgröße in Richtung eines Trainingsziels in den Trainingsprozessen vieler maschineller Lernalgorithmen. Wir untersuchen die Auswirkungen, die die vielen Zeitpläne und Formate auf die Leistung eines Generative Adversarial Network haben können, eine Art neuronales Netz, das wir in einem früheren Artikel untersucht haben.

African Buffalo Optimierung (ABO)

Der Artikel stellt den Algorithmus der Afrikanische Büffel-Optimierung (ABO) vor, einen metaheuristischen Ansatz, der 2015 auf der Grundlage des einzigartigen Verhaltens dieser Tiere entwickelt wurde. Der Artikel beschreibt im Detail die Phasen der Implementierung des Algorithmus und seine Effizienz bei der Lösung komplexer Probleme, was ihn zu einem wertvollen Werkzeug im Bereich der Optimierung macht.