Неопределенность как модель (Часть 1): Случайные величины — язык неопределенности

Оглавление

- Предисловие

- Введение

- Общее определение

- Простые примеры

- Функция распределения

- Аналогия вероятности с массой

- Типы распределений

- Дискретные

- Непрерывные

- Смешанные

- Основные характеристики

- Среднее по распределению

- Квантили

- Заключение

- Приложение

- Распределения в стандартной библиотеке MQL5

- Сравнение распределений по графикам CDF

- Сравнение распределений по графикам PDF

- Сравнение распределений на графике QQ-Plot

- Список приложенных файлов

Предисловие

Теория вероятностей и математическая статистика — это не просто «академический багаж», а фундаментальный рабочий инструмент трейдера. Без этого аппарата невозможно адекватно моделировать рыночную неопределенность: любая аналитика, от элементарного расчета прибыльности торговой стратегии до построения сложных риск-моделей, целиком опирается на вероятностную логику.

Несмотря на почтенную историю, классическая статистика остается на острие прогресса. Показательным примером служат большие языковые модели (LLM). В своей архитектурной основе нейросети являются сложными вероятностными моделями, обучение которых базируется на классическом принципе максимума правдоподобия. Системное понимание этого фундамента необходимо не только для анализа рыночных данных, но и для осознания механизмов работы современных ИИ-технологий, оценки их эффективности и понимания их принципиальных ограничений.

Дисклеймер. В рамках одной статьи невозможно исчерпывающе изложить теорию случайных величин. Мы затронем лишь ключевые аспекты, сохраняя баланс между математической строгостью и прикладной пользой.

Введение

В математической среде существует известная шутка: «В случайных величинах нет ничего случайного». Несмотря на иронию, этот тезис несет глубокий прикладной смысл. В научном контексте термин «случайный» не имеет почти ничего общего с его бытовым значением — как нечто капризное, зыбкое или необоснованное.

Случайная величина, событие или процесс — это абсолютно детерминированные математические объекты (функции или множества). Они не склонны к внезапному исчезновению или хаотичному изменению по неизвестным причинам. По сути, эпитет «случайный» здесь — не более чем исторически сложившееся соглашение, которое проще всего расшифровать как «объект, изучаемый методами теории вероятностей». Перед нами типичный пример не самого удачного термина, который прижился лишь благодаря многовековой привычке.

Но здесь возникает резонный вопрос: если всё так жестко определено, то где же спрятана сама случайность? Важно понимать: теория вероятностей не претендует на роль оракула, предсказывающего результат каждого отдельного опыта. Это не магия и не предвидение. Её фокус направлен на другое:

- Мы не знаем, какой именно исход ω выпадет из вероятностного пространства Ω. Однако мы обладаем «картой местности» — нам известны вероятности событий и математические характеристики случайных величин.

- Вместо предсказания конкретного будущего, теория вероятностей дает нам описание всей совокупности возможных результатов. Мы рассчитываем параметры, которые говорят не о том, что конкретно случится сейчас, а о том, как в принципе ведет себя система при многократном повторении эксперимента.

Таким образом, математика описывает не хаос и не конкретную судьбу одного броска монеты. Мы работаем с характеристиками (средним значением, разбросом, распределением), которые описывают весь океан возможных исходов, оставляя конкретный результат каждого отдельного эксперимента в статусе непредсказуемого «черного ящика». Именно поэтому наука называется теория "вероятностей", а не теория "случайностей".

Общее определение

В основе наших рассуждений лежит концепция вероятностного пространства Ω, о котором мы говорили в прошлой статье. В реальных задачах мы почти никогда не знаем, как оно устроено «на самом деле» — его структура слишком сложна для прямого описания. Поэтому в прикладной науке мы просто постулируем его существование. На практике нам достаточно той информации, которую транслируют через себя случайные величины.

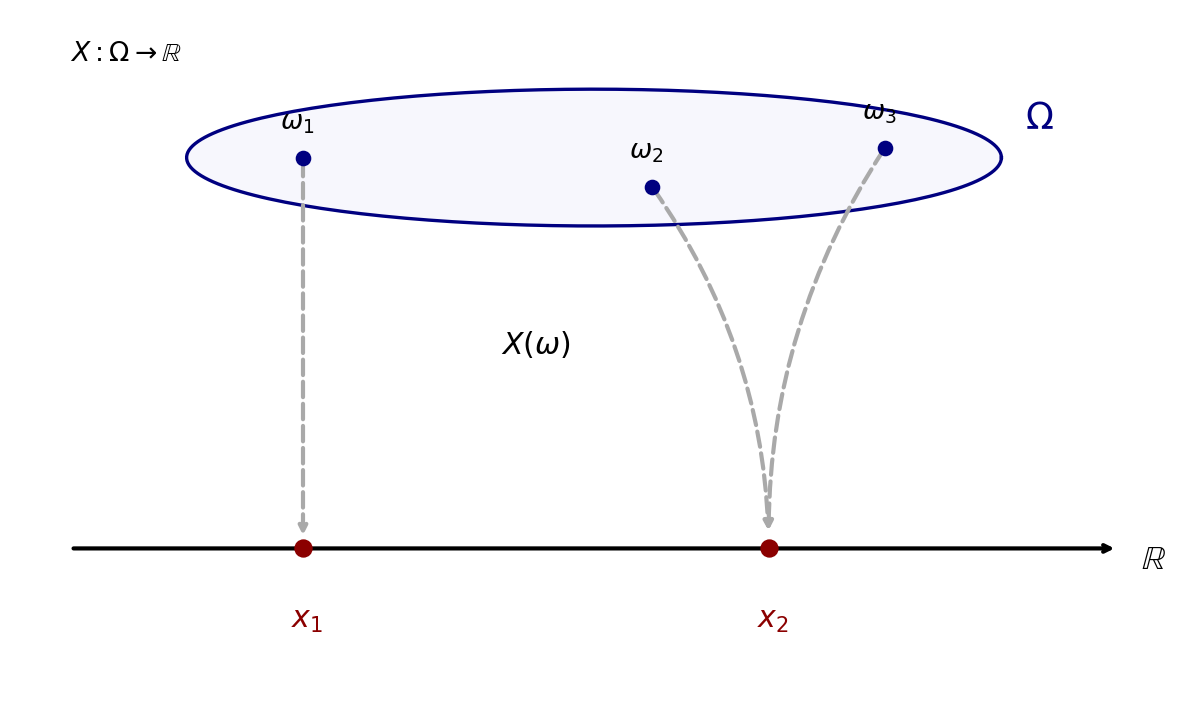

Случайная величина (random variable) — это функция X=X(ω), которая назначает каждому элементарному событию ω из пространства Ω строго определенное число. Если речь идёт о конкретном числовом значении этой функции в точке ω, то используется маленькая буква: x=X(ω). На рисунке ниже приведена попытка изобразить это графически: точка ω₁ отображается в число x₁ (точку на числовой прямой ℝ), а точки ω₂ и ω₃ — в одно и то же число x₂.

Функция распределения

Каждая случайная величина X — это не просто функция, это мост, который переносит вероятности из абстрактного пространства Ω на нашу привычную числовую прямую ℝ. Механика этого переноса проста: вероятность того, что значение величины попадет в некий отрезок на прямой, в точности равна вероятности тех элементарных событий ω, которые в этот отрезок «приземлились». Для решения подавляющего большинства прикладных задач в статистике нам вполне достаточно уметь работать с такими интервалами и их объединениями.

Почему это важно? Работать с «чистым» пространством Ω практически невозможно — оно слишком аморфно. Но как только мы переходим к распределению на числовой прямой, у нас в руках оказывается мощнейший инструмент. Любое такое распределение однозначно описывается обычной числовой функцией F(x), известной как функция распределения случайной величины X. Математически это записывается так: значение функции в точке x — это вероятность того, что случайная величина примет значение, не превышающее x. Иными словами, функция распределения — это «накопительная» вероятность. Она аккумулирует в себе все шансы появления событий от глубокого минуса до выбранной нами границы. Именно с этой функцией (и её производной — плотностью) мы и будем иметь дело в 99% случаев при анализе данных.

Тонкости терминологии: вероятностное распределение vs функция распределения случайной величины.

- Вероятностное распределение — это «правило», которое сопоставляет вероятность множеству (событию). Это более общее и абстрактное понятие.

- Функция распределения — это конкретная числовая функция, которая сопоставляет число числу. Это наш рабочий инструмент, который переводит абстрактное распределение на язык графиков и формул.

В международной практике и профессиональной литературе для функции распределения закрепилось название CDF (Cumulative Distribution Function — кумулятивная функция распределения). Слово «кумулятивная» здесь ключевое.

Аналогия вероятности с массой

Аналогия полезная для понимания сути: вероятность как масса. Представьте, что общая вероятность, равная единице (или 100%), — это физическая масса, распределенная (размазанная или сосредоточенная в отдельных точках) вдоль числовой прямой. В этой логике CDF в точке x показывает накопленную массу на всём интервале от -Inf до x. Чем дальше мы движемся вправо по оси, тем больше «веса» собираем, пока к плюс бесконечности не заберем всё целиком (т.е. 1). Эта «физика процесса» — не просто метафора. Она глубоко зашита в логику статистических пакетов и языков программирования (таких, как R, Python или MQL5). Понимая вероятность как массу, вы легко разберетесь, почему функцию плотности называют density (плотность массы), а математическое ожидание — center of mass (центр масс).

В рамках этой «массовой» аналогии вырожденная случайная величина (которую мы упоминали ранее как аналог обычного числа) обретает наглядный физический смысл. Если обычная случайная величина «размазывает» вероятность по числовой прямой, то в вырожденном случае все 100% массы (единичная вероятность) спрессованы в одну-единственную бесконечно малую точку. Представьте это как гирю, стоящую на весах в конкретной координате:

- Слева от этой точки накопленная масса равна нулю.

- Как только мы проходим точку расположения «гири», значение CDF мгновенно прыгает до единицы.

Такой взгляд позволяет воспринимать обычные числа не как нечто чужеродное случайности, а как предельный, частный случай вероятностного распределения. Это понимание крайне полезно, когда мы переходим к изучению сходимости случайных процессов: хаос постепенно «стягивается» в одну точку, превращаясь в предсказуемую константу.

Простые примеры

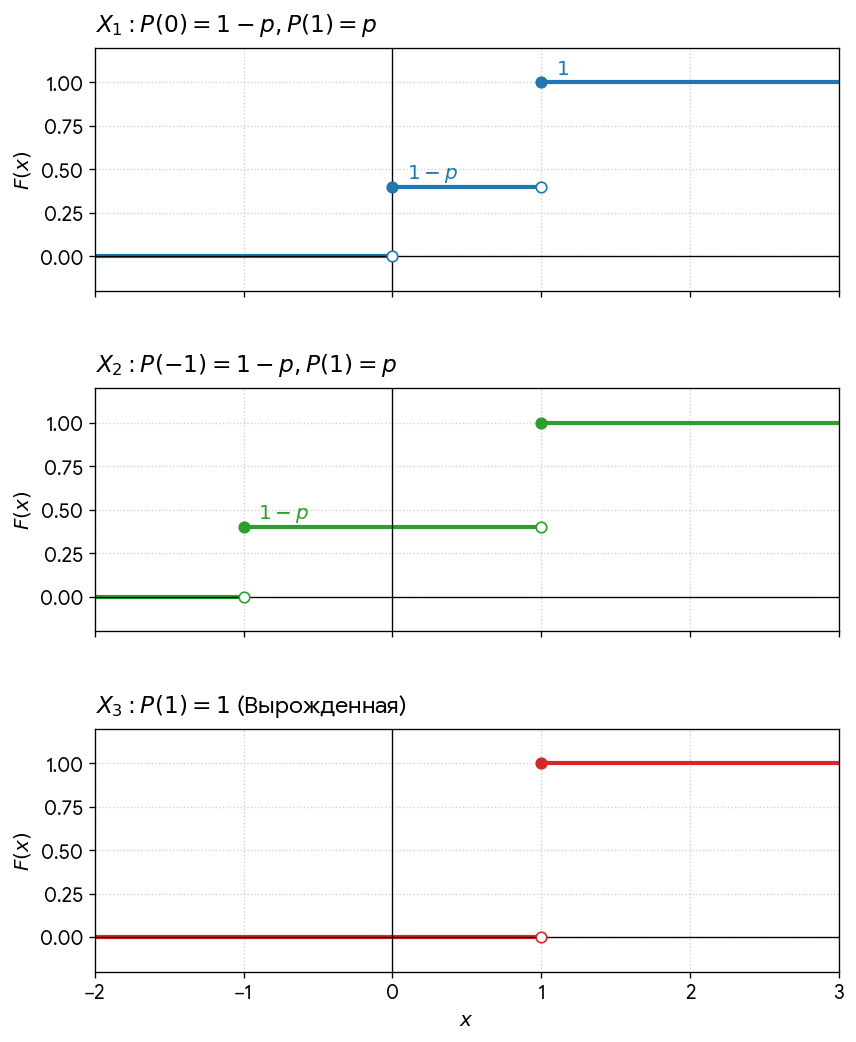

Рассмотрим простейший пример — схема Бернулли длины n=1 (однократный бросок монеты). Здесь у нас всего два элементарных события, поэтому функции на них можно задать таблицей. Приведём три возможных варианта — X1, X2 и X3:

| X1 | X2 | X3 | |

| ω1 = H | 1 | 1 | 1 |

| ω2 = T | 0 | -1 | 1 |

Возможно, третий вариант вызовет некоторое недоумение. Казалось бы, в чём смысл случайной величины, которая при любом исходе случайного эксперимента принимает одно и то же значение? Тем не менее подобные случайные величины, называемые вырожденными, достаточно важны для теории. Многие важнейшие теоремы, такие, например, как Закон больших чисел (ЗБЧ), заключаются в утверждении о сходимости последовательности случайных величин к вырожденной случайной величине. Также для интуитивного понимания можно представлять вырожденные случайные величины как аналог обычных (детерминированных) величин — просто привычные числа.

Теперь построим функции распределений для этих трёх примеров. Ниже приведены графики этих функций. Все они разрывны и в точках разрыва их значение равно пределу справа, что обозначено на графиках маленькими кружками, заполненными цветом. Разрывы происходят в точках, которые соответствуют значениям, принимаемым случайными величинами. Величины перепадов при разрывах (высоты ступенек) равны вероятностям, с которыми принимаются данные значения (на первых двух графиках они равны q и p, q=1-p и единице на третьем).

Типы распределений

Дискретные распределения

Выше были приведены примеры дискретных случайных величин, в которых вероятность сосредоточена в конечном (или счётном) числе точек. Помимо функции распределения, для таких величин вводится понятие функции вероятности (PMF — probability mass function). Значение этой функции равно вероятности, сосредоточенной в заданной точке. То есть, она не равна нулю только в конечном (или счётном) числе точек.

Во второй таблице первого приложения к статье можно увидеть примеры дискретных распределений с конечным числом точек (биномиальное и гипергеометрическое). Также там есть и пример дискретного распределения с бесконечным (счётным) числом точек с ненулевой вероятностью (Пуассона).

Расчёт вероятности для случайной величины с дискретным распределением попасть в заданный интервал:

- Если известна PMF, то нужно посчитать сумму вероятностей для всех точек с ненулевой вероятностью, попавших в интервал. Если некоторые точки попадают на конец интервала, то нужно внимательно смотреть, входят ли они в интервал.

- Если известна CDF, то нужно взять разницу между её значениями на правом и левом концах интервала. Здесь тоже нужно следить за включением точек ненулевой вероятности, в зависимости от типа интервала. Ещё важно знать, как конкретно определена CDF в данном конкретном статистическом пакете — попадаются варианты, когда в её определении используется строгое неравенство.

Непрерывные распределения

Функция распределения не обязательно имеет разрывы и вполне может быть непрерывной. Простейший пример — равномерное распределение на отрезке от нуля до единицы. Вероятность точки попасть в любой отрезок равна длине его пересечения с отрезком [0;1]. Распределение случайной величины X (координаты случайной точки) задаётся функцией распределения F(x), такой что F(x)=0 при x<0, F(x)=x при 0≤x<1 и F(x)=1 при x≥1. Ниже приведён график этой функции.

![F(x) для равномерного распределения на отрезке [0; 1] F(x) для равномерного распределения на отрезке [0; 1]](https://c.mql5.com/2/196/Untiform_F8xg.png)

Для непрерывных случайных величин вводится ещё один важнейший инструмент — плотность распределения (она же PDF — Probability Density Function). Математически плотность — это производная от функции распределения F(x). Если продолжать нашу физическую аналогию, то если F(x) — это суммарная масса на отрезке, то PDF — это интенсивность, с которой эта масса «размазана» по числовой прямой. Возьмем наш пример (равномерное распределение на отрезке [0;1]): Вне этого отрезка плотность равна нулю (там «пустота», массы нет). Внутри отрезка плотность равна единице (масса распределена идеально ровным слоем). Ниже приведён график этой функции.

![p(x) для равномерного распределения на отрезке[0; 1] p(x) для равномерного распределения на отрезке[0; 1]](https://c.mql5.com/2/196/Untiform_p6xj.png)

Здесь часто возникает резонный вопрос: как быть с точками разрыва? В нашем примере плотность мгновенно прыгает от 0 к 1 на границах отрезка. Какое значение PDF там выбрать — 0, 1 или 0.5? Математический ответ освобождает от выбора: для непрерывных распределений это не имеет никакого значения. В отличие от дискретных величин, где вероятность может «кучковаться» в одной точке, в непрерывном мире вероятность в каждой отдельно взятой точке всегда равна нулю. Вероятность здесь обретает смысл только для интервалов. Представьте это как попытку измерить вес геометрической точки на линии: сколько бы точек вы ни взяли, их суммарный вес проявится только тогда, когда они сложатся в отрезок. Поэтому в точках разрыва мы можем ставить любое значение — на итоговый расчет вероятностей (интеграл) это никак не повлияет.

Чтобы лучше понять концепцию плотности, полезно использовать интуитивный прием, который превращает сложное непрерывное распределение в понятную дискретную модель. Этот метод — фундамент любого компьютерного моделирования (например, метода Монте-Карло). Представьте, что мы «нарезаем» непрерывную числовую прямую на крошечные отрезки длиной d. Теперь мы можем сделать допущение: В каждой такой точке x сосредоточена не нулевая, а приблизительная малая вероятность P. Эта вероятность рассчитывается как произведение плотности на ширину шага: P~p(x)*d. Почему это работает? Если плотность p(x) — это «высота» графика в данной точке, а d — его «ширина», то их произведение — это площадь тонкого столбика. Сумма всех таких столбиков (интегральная сумма) в пределе даст нам ту самую единичную вероятность (всю массу). В чем практическая польза этой модели?

- Для программиста: именно так работают алгоритмы численного интегрирования. Мы заменяем бесконечность на конечное число очень маленьких шагов.

- Для трейдера: рыночные котировки дискретны по своей природе (минимальный шаг цены — тик).

Рассматривая плотность вероятности через призму малых приращений d, мы переходим от чистой математики к реальности торгового терминала. Такой взгляд позволяет воспринимать плотность p(x) не просто как абстрактную производную, а как коэффициент, увеличивающий плотность вероятности в конкретной окрестности точки x. Чем выше плотность, тем больше «шансов» попасть в эту окрестность.

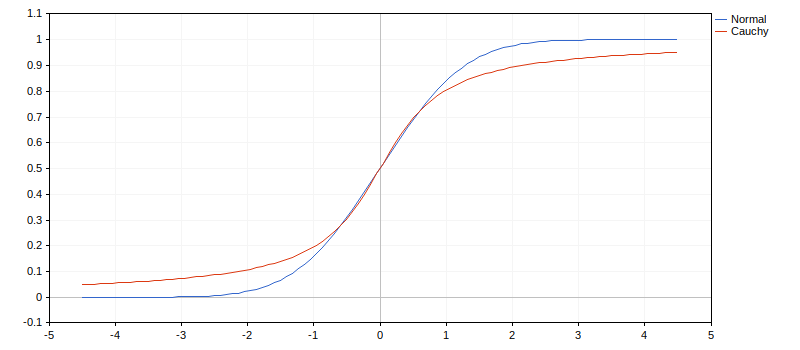

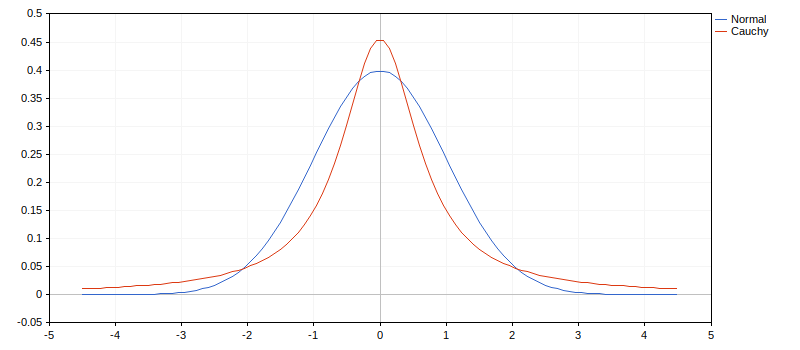

В приложении к статье приведены mql5-скрипты, выводящие графики для CDF и PDF. Для наглядности представлены графики для разных законов распределений (нормальное и Коши).

Расчёт вероятности для случайной величины с непрерывным распределением попасть в заданный интервал:

- Если известна PDF, то нужно посчитать интеграл от этой функции по интервалу. На значения плотности в отдельных точках внимание не обращаем.

- Если известна CDF, то нужно взять разницу между её значениями на правом и левом концах интервала. Здесь разрывы отсутствуют (ступенек нет). В приложении к статье приведён mql5-скрипт для расчёта вероятности в подобном случае (для примера взято нормальное распределение).

Смешанные распределения

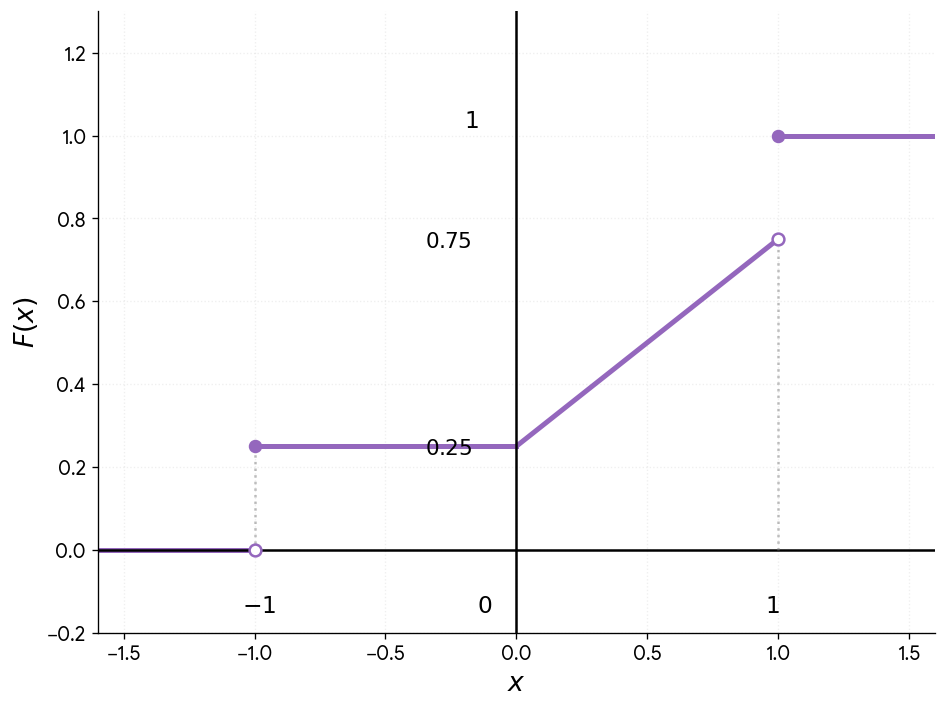

В учебниках случайные величины часто делят на два строгих лагеря: дискретные (с четкими прыжками) и непрерывные (с плавными линиями). Однако реальность — и трейдинг здесь хороший пример — не всегда бывает столь однозначной. Существуют смешанные распределения, которые ведут себя как гибриды. Математически это выглядит как создание «коктейля» из двух разных функций распределения F1(x) и F2(x). Мы можем смешать их в любых пропорциях k1 и k2 (главное, чтобы они были положительны и их сумма давала 1): F(x)=k1*F1(x)+k2*F2(x).

Верно и обратное: практически любую «осмысленную» (применимую на практике) функцию распределения можно разложить на непрерывную и дискретную составляющие. Это не просто математический трюк. Смешанные модели — стандарт, например, в теории надежности (survival analysis). Пример «из жизни»: представьте страховой случай или исполнение ордера. Есть непрерывное распределение возможной прибыли/убытка, но при этом существует ненулевая (дискретная) вероятность того, что событие вообще не произойдет (убыток равен ровно нулю) или сработает фиксированный лимит убытка.

Ниже на графике представлена такая «смесь» в пропорции 50/50 (k1=k2=0.5). Мы взяли плавное равномерное распределение и добавили к нему дискретные «уколы» из нашего примера с монетой (взят вариант, когда принимаются значения -1 и 1 с равной вероятностью p=0.5). Там, где график идет под наклоном — работает непрерывная часть. Там, где виден вертикальный скачок — «всплывает» дискретная вероятность конкретного значения. Понимание таких гибридов критически важно для работы с рыночными данными, где «плавные» движения цены постоянно прерываются дискретными событиями — гэпами, клирингами или исполнением крупных заявок по одной цене.

Расчёт вероятности для случайной величины со смешанным распределением попасть в заданный интервал: для каждого элемента смеси по отдельности считаем вероятность подходящим способом. Потом эти промежуточные вероятности суммируем в результирующую вероятность с соответствующими весами.

Основные характеристики одномерных распределений

Среднее по распределению

Чтобы не описывать случайную величину бесконечным набором точек или сложным графиком функции, математики используют компактные «сводки» — числовые характеристики. Главная из них — среднее для некоторой функции f(x) по распределению.

Для любой функции распределения можно определить интеграл Стилтьеса. За этим грозным названием скрывается мощный математический аппарат (интегралы Римана-Стилтьеса или Лебега-Стилтьеса), позволяющий единообразно работать с любыми типами величин. Интеграл от некоторой числовой функции f(x) по заданному распределению P (если он существует) и называется средним от этой функции.

Несмотря на сложность «под капотом», для прикладных задач нам достаточно понимать, во что этот интеграл превращается на практике:

- Дискретный случай: интеграл превращается в обычную сумму. Мы просто умножаем значение функции в каждой точке на вероятность этой точки и складываем результаты.

- Непрерывный случай: интеграл Стилтьеса превращается в классический определенный интеграл от произведения нашей функции на плотность вероятности p(x).

- Смешанный случай: здесь работает принцип линейности. Среднее считается как взвешенная сумма средних для каждой компоненты (непрерывной и дискретной) с учетом их весов.

Рассмотрим несколько примеров, какие физические и статистические смыслы принимают средние значения в зависимости от вида функции f(x), для которой считается среднее:

- Среднее от единичной константы: f(x)=1. Оно всегда равно единице. Это фундаментальное свойство «нормировки»: суммарная масса всей вероятности (площади под графиком) обязана составлять 100%. Если это не так, значит, мы имеем дело не с вероятностью.

- Математическое ожидание: f(x)=x. Это «центр масс» распределения. Однако важно помнить: в теории вероятностей есть коварные исключения. Существуют распределения (например, распределение Коши), у которых хвосты настолько тяжелы, что интеграл расходится. В таких случаях математическое ожидание попросту не определено — у системы нет единого «центра», вокруг которого она стабилизируется.

- Дисперсия: f(x)=(x-m)^2. Где m — математическое ожидание. Дисперсия (или вариация) — это мера «разбросанности» данных. Она показывает, насколько сильно значения отклоняются от центра. У вырожденной величины (константы) дисперсия равна нулю (разброса нет). В трейдинге дисперсия — это база для понимания волатильности и риска.

- Центральные моменты: f(x)=(x-m)^n. При n>2 мы получаем характеристики высших порядков. Например, третий момент отвечает за асимметрию (скос графика), а четвертый — за эксцесс (остроту пика и «тяжесть» хвостов). В приложении к статье приведён пример mql5-скрипта для расчёта математического ожидания, дисперсии и центральных моментов третьего и четвёртого порядка.

- Характеристическая функция: f(x)=exp(i*t*x), где i — мнимая единица. Здесь мы входим в область комплексных чисел. Для непрерывных величин это не что иное, как преобразование Фурье плотности вероятности. Хотя в прикладной статистике характеристическая функция встречается редко, для теории вероятностей это «святой грааль». Именно через них доказывается Центральная предельная теорема (ЦПТ) — фундамент, объясняющий, почему в мире так много нормальных распределений.

- Для расчета математического ожидания производной величины Y=g(X) формально требуется сначала найти её собственную плотность распределения. Однако на практике используют более простой путь: вычисляют среднее от g(x) по исходному распределению X. Справедливость такого подхода не является самоочевидной и вытекает из математической теоремы с довольно сложным доказательством. В западной литературе это утверждение получило ироничное название «Закон ленивого статистика» (LOTUS).

Квантили

Если математическое ожидание указывает на «центр тяжести», то квантили помогают понять, как именно распределена масса вдоль числовой прямой.

В случае непрерывного распределения с функцией распределения F(x)q-квантиль определяется довольно просто: мы решаем уравнение F(x)=q, где q — заданный уровень вероятности (от 0 до 1). Полученное значение x=x(q) и будет q-квантилем. В статистических пакетах эту функцию часто называют PPF (Percent Point Function) или обратной функцией распределения.

Интуитивный смысл: q-квантиль — это точка на числовой прямой, которая «отсекает» долю q всей вероятностной массы слева от себя.

Пример для ясности: представим, что мы анализируем дневную волатильность актива в пунктах. Если 0.9-квантиль равен 150 пунктам, это означает:

- В 90% торговых дней волатильность не превысит 150 пунктов.

- В оставшихся 10% случаев рынок будет «летать» на расстояния свыше 150 пунктов.

С дискретными распределениями (где функция F(x) состоит из «ступенек») всё немного сложнее. Уравнение F(x)=q может в этом случае либо не иметь корней вовсе (если q попало на «вертикальный прыжок»), либо иметь их бесконечно много (на плоских участках). Тем не менее квантили определяют и здесь, используя специальные правила округления или интерполяции.

Некоторые значения q настолько важны, что получили свои названия:

- При q=0.5 — медиана. Точка, делящая распределение пополам. В отличие от среднего, медиана устойчива к «выбросам» и аномальным хвостам и потому часто используется как её робастный аналог.

- При q=0.25 и q=0.75 — квартили. Они отсекают четверти распределения (левый и правый квартили). Разница между ними называется интерквартильным размахом и (по аналогии с медианой) часто используется как устойчивый аналог дисперсии.

- Кратные 0.1 — децили.

- Кратные 0.01 — Перцентили (процентили). Именно в перцентилях чаще всего измеряются рыночные риски (например, пресловутый Value-at-Risk или VaR).

В приложении к статье приведён mql5-скрипт для расчёта квантиля (для нормального распределения).

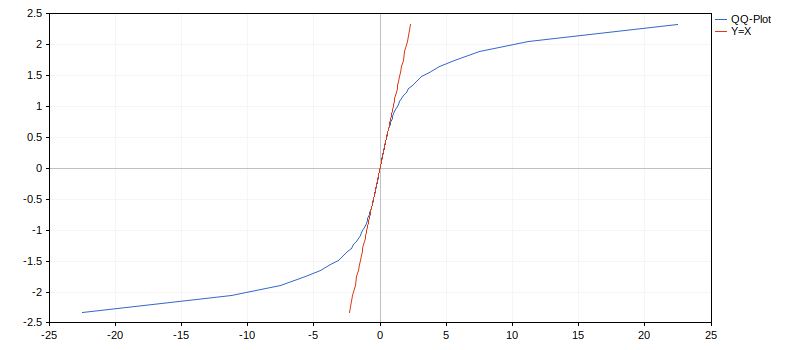

Для визуального сравнения двух распределений часто используется основанный на квантилях QQ-Plot (Quantile-Quantile Plot). Это двумерный график, каждая точка которого соответствует q-квантилям распределений. При идеальном совпадении распределений этот график совпадает с прямой y=x. QQ-Plot помогает визуально различать распределения гораздо лучше, чем их совместные графики PDF или CDF. В приложении к статье приведён mql5-скрипт, строящий такой график для распределений Коши и Гаусса.

Заключение

Случайные величины — это фундаментальный язык, с помощью которого описывается неопределенность в реальных системах. Для трейдера, аналитика или разработчика торговых алгоритмов этот аппарат — не абстрактная теория, а рабочий инструмент. Через функции распределения, плотности, моменты и квантили мы можем перейти от хаотичных наблюдений рынка к количественным характеристикам: оценке риска, вероятности экстремальных движений, устойчивости стратегий и статистических свойств данных.

Практическая ценность такого подхода заключается в том, что большинство задач анализа рынка сводится именно к работе с распределениями. Понимание того, как устроены CDF, PDF и квантили, позволяет корректно вычислять вероятности, строить риск-метрики, сравнивать модели и анализировать структуру данных. Использование встроенных статистических функций стандартной библиотеки MQL5 делает эти инструменты доступными непосредственно внутри торговых приложений и исследовательских скриптов.

Однако в реальных задачах одной случайной величины почти никогда не достаточно. Нас интересуют взаимосвязи между ними: совместное поведение цен, доходностей, волатильности и других факторов. Поэтому следующим шагом станет изучение многомерных случайных величин, где ключевую роль играют совместные распределения и структура зависимостей между переменными.

Приложения: практическая реализация в коде

В этом разделе собраны примеры кода, иллюстрирующие ключевые концепции статьи. Мы намеренно вынесли их за скобки основного повествования, чтобы технические детали реализации не отвлекали от математической логики повествования.

Приложение 1

Таблица с некоторыми непрерывными распределениями и ссылками на связанные с ними функции в разделе статистики стандартной библиотеки mql5. Удобно, что для функций распределения, плотностей и квантильных функций есть векторные аналоги. Для использования каждого распределения нужно подключать соответствующие заголовочные файлы. Например, для нормального распределения:

//--- Подключаем функции нормального распределения #include <Math\Stat\Normal.mqh>

| Название семейства распределений | Функция распределения (CDF) | Плотность распределения (PDF) | Обратная функция распределения (Квантильная функция, Процентная функция, PPF) | Комментарий |

|---|---|---|---|---|

| Гауссовское (нормальное) | MathCumulativeDistributionNormal() | MathProbabilityDensityNormal() | MathQuantileNormal() | Часто используется как эталон для сравнения с распределениями приращений (или логарифмических доходностей) цен |

| Логнормальное | MathCumulativeDistributionLognormal() | MathProbabilityDensityLognormal() | MathQuantileLognormal() | Распределение величины, логарифм которой имеет нормальное распределение. Часто используется как эталон для сравнения с распределениями доходностей цен |

| Т-распределение (распределение Стьюдента) | MathCumulativeDistributionT() | MathProbabilityDensityT() | MathQuantileT() | Самое известное применение — интервальная оценка математического ожидания нормально распределённой выборки. |

| Распределение Хи-квадрат (Распределение Пирсона) | MathCumulativeDistributionChiSquare() | MathProbabilityDensityChiSquare() | MathQuantileChiSquare() | Самое известное применение — одноимённый критерий согласия. |

| F-распределение (распределение Фишера) | MathCumulativeDistributionF() | MathProbabilityDensityF() | MathQuantileF() | Используется в F-критерии (F-test) |

| Распределение Коши | MathCumulativeDistributionCauchy() | MathProbabilityDensityCauchy() | MathQuantileCauchy() | Известно отсутствием (в обычном смысле) математического ожидания и моментов |

| Название семейства распределений | Функция распределения (CDF) | Функция вероятности (PMF) | Комментарий |

|---|---|---|---|

| Биномиальное | MathCumulativeDistributionBinomial() | MathProbabilityDensityBinomial() | Применяется для проверки гипотез о вероятности события |

| Гипергеометрическое | MathCumulativeDistributionHypergeometric() | MathProbabilityDensityHypergeometric() | Применяется в Точном тесте Фишера |

| Распределение Пуассона | MathCumulativeDistributionPoisson() | MathProbabilityDensityPoisson() | Может моделировать, например, распределение числа тиков цены в единицу времени (параметр — средняя интенсивность) |

Приложение 2

Скрипт p_calc.mq5 для расчёта вероятности попадания случайной величины с Нормальным распределением в заданный интервал. В качестве входных данных задаются параметры распределения и границы интервала. Результат расчёта:

Для нормального распределения со средним 0.50 и СКО 1.60 вероятность попадания в интервал от 0.20 до 1.70 равна 0.35

Приложение 3

Скрипт moments.mq5 для расчёта первых четырёх моментов экспоненциального распределения. Необходимо уточнить, что с формальной точки зрения коэффициенты асимметрии и эксцесса — это не сами центральные моменты, а их безразмерные аналоги (нормированные через СКО). В качестве входного параметра задаётся среднее экспоненциального распределения. Результат расчёта:

Для Экспоненциального распределения со средним 0.50:

Математическое ожидание 0.50

Дисперсия 0.25

Коэффициент асимметрии 2.00

Коэффициент эксцесса 6.00

Приложение 4

Скрипт q_calc.mq5 для расчёта квантиля случайной величины с Нормальным распределением. В качестве входных данных задаются параметры распределения и вероятность, для которой необходимо посчитать квантиль. Результат расчёта:

Для нормального распределения со средним 0.50 и СКО 1.60, для вероятности 0.20 квантиль равен -0.85

Приложение 5

Скрипт two_cdf.mq5 строит графики функций распределения для законов Гаусса и Коши на одних координатных осях. Для нормального распределения взяты стандартные параметры (0, 1), а для распределения Коши (0, 0.7), чтобы они лучше соответствовали друг другу (совпадают центры и почти равны их интерквартильные размахи). Разница графиков заметна, но не очевидна её суть. Например, мы можем ошибочно предположить, что просто взяты два распределения с разными параметрами из одного семейства.

Приложение 6

Скрипт two_pdf.mq5 строит для тех же двух распределений (что и в предыдущем приложении) графики плотностей. Разница немного более очевидна, но по-прежнему её сложно интерпретировать (особенно в хвостах).

Приложение 7

Скрипт qqplot_theoretical.mq5 строит для тех же двух распределений (что и в двух предыдущих приложениях) график QQ-Plot. Для сравнения приведён график прямой y=x. Теперь нет ни малейших сомнений, что это совершенно разные распределения, сильно отличающиеся поведением в хвостах. Предположение, что это два нормальных распределения с разными параметрами можно отбросить — в этом случае график представлял бы собой отрезок прямой y=ax+b (что очевидно не наблюдается).

Приложенные файлы

| # | имя | описание |

|---|---|---|

| 1 | p_calc.mq5 | Скрипт для расчёта вероятности попадания случайной величины с Нормальным распределением в заданный интервал |

| 2 | moments.mq5 | Скрипт для расчёта первых четырёх моментов экспоненциального распределения |

| 3 | q_calc.mq5 | Скрипт для расчёта квантиля случайной величины с Нормальным распределением |

| 4 | two_cdf.mq5 | Скрипт, строящий на одних осях графики функций распределения для законов Коши и Гаусса. |

| 5 | two_pdf.mq5 | Скрипт, строящий на одних осях графики плотностей распределения для законов Коши и Гаусса. |

| 6 | qqplot_theoretical.mq5 | Скрипт, строящий график QQ-Plot для распределений Коши и Гаусса. |

Предупреждение: все права на данные материалы принадлежат MetaQuotes Ltd. Полная или частичная перепечатка запрещена.

Данная статья написана пользователем сайта и отражает его личную точку зрения. Компания MetaQuotes Ltd не несет ответственности за достоверность представленной информации, а также за возможные последствия использования описанных решений, стратегий или рекомендаций.

Нейросети в трейдинге: Оптимизация Cross-Attention для анализа длинных последовательностей рынка (STCA)

Нейросети в трейдинге: Оптимизация Cross-Attention для анализа длинных последовательностей рынка (STCA)

Искусство работы с логами (Часть 10): Подавление повторяющихся логов (suppression)

Искусство работы с логами (Часть 10): Подавление повторяющихся логов (suppression)

Автоматизация торговых стратегий на MQL5 (Часть 20): Мультисимвольная стратегия с использованием CCI и AO

Автоматизация торговых стратегий на MQL5 (Часть 20): Мультисимвольная стратегия с использованием CCI и AO

Знакомство с языком MQL5 (Часть 40): Руководство для начинающих по работе с файлами в MQL5 (II)

Знакомство с языком MQL5 (Часть 40): Руководство для начинающих по работе с файлами в MQL5 (II)

- Бесплатные приложения для трейдинга

- 8 000+ сигналов для копирования

- Экономические новости для анализа финансовых рынков

Вы принимаете политику сайта и условия использования