Архитектура машинного обучения в MetaTrader 5 (Часть 6): Проектирование системы кэширования промышленного уровня

- Введение

- Часть I: Основы архитектуры

- Часть II: Надежный декоратор с поддержкой кэширования

- Часть III: Расширенные шаблоны кэширования

- Часть IV: Мониторинг и оптимизация производительности

- Часть V: Интеграция с существующими проектами

- Заключение: От скорости исследований к скорости реализации

- Репозиторий кода

- Файлы модулей

Введение

В предыдущих частях серии «Machine Learning Blueprint» мы создали надежный конвейер для машинного обучения в сфере финансов — от обеспечения целостности данных с учетом смещения look-ahead, до внедрения сложных методов разметки, таких как «Triple-Barrier и «Trend-Scanning». Однако по мере того, как наши стратегии или модели машинного обучения — например, случайные лесас последовательным бутстрап-обобщением — становятся все более сложными, мы сталкиваемся с серьезной проблемой: вычислительными «узкими местами», которые препятствуют быстрой итерации.

Вы разработали многообещающую стратегию возврата к среднему значению. Ваш бэктест показывает коэффициент Шарпа равный 1,8, стабильную прибыль в различных рыночных условиях и четкие кривые капитала. Вы готовы оптимизировать параметры, протестировать различные периоды ретроспективы и проверить результаты с помощью walk-forward-анализа.

И тут реальность даёт о себе знать.

Вычисление каждой комбинации параметров занимает 6 минут. Вы хотите протестировать 50 вариантов. Это 5 часов ожидания. Изменить подход к подготовке данных? Ещё 5 часов. Добавить новый индикатор? Вы поняли, о чем я.

Настоящая стоимость заключается не только во времени — это упущенные возможности. Пока вы ждете результатов вычислений, вы не можете проводить итерации, не можете проверять новые идеи и не можете укреплять своё преимущество. Темпы разработки постепенно сходят на нет.

Именно эта проблема стала причиной провала моих ранних торговых стратегий. Я проводил целые выходные, запуская бэктесты, только для того, чтобы в понедельник утром обнаружить, что допустил простую ошибку в коде. Ещё ожидание. Ещё больше разочарования.

Должен был быть лучший способ.

В этой статье рассказывается, как устранить это узкое место с помощью интеллектуального кэширования. К концу статьи вы поймёте, как:

- Сократить время оптимизации стратегии с нескольких часов до нескольких минут

- Проверить более 50 комбинаций параметров за время, которое раньше уходило на 5

- Итерировать по признакам и моделям без пересчёта всего.

Давайте начнем с той проблемы, с которой вы сейчас столкнулись.

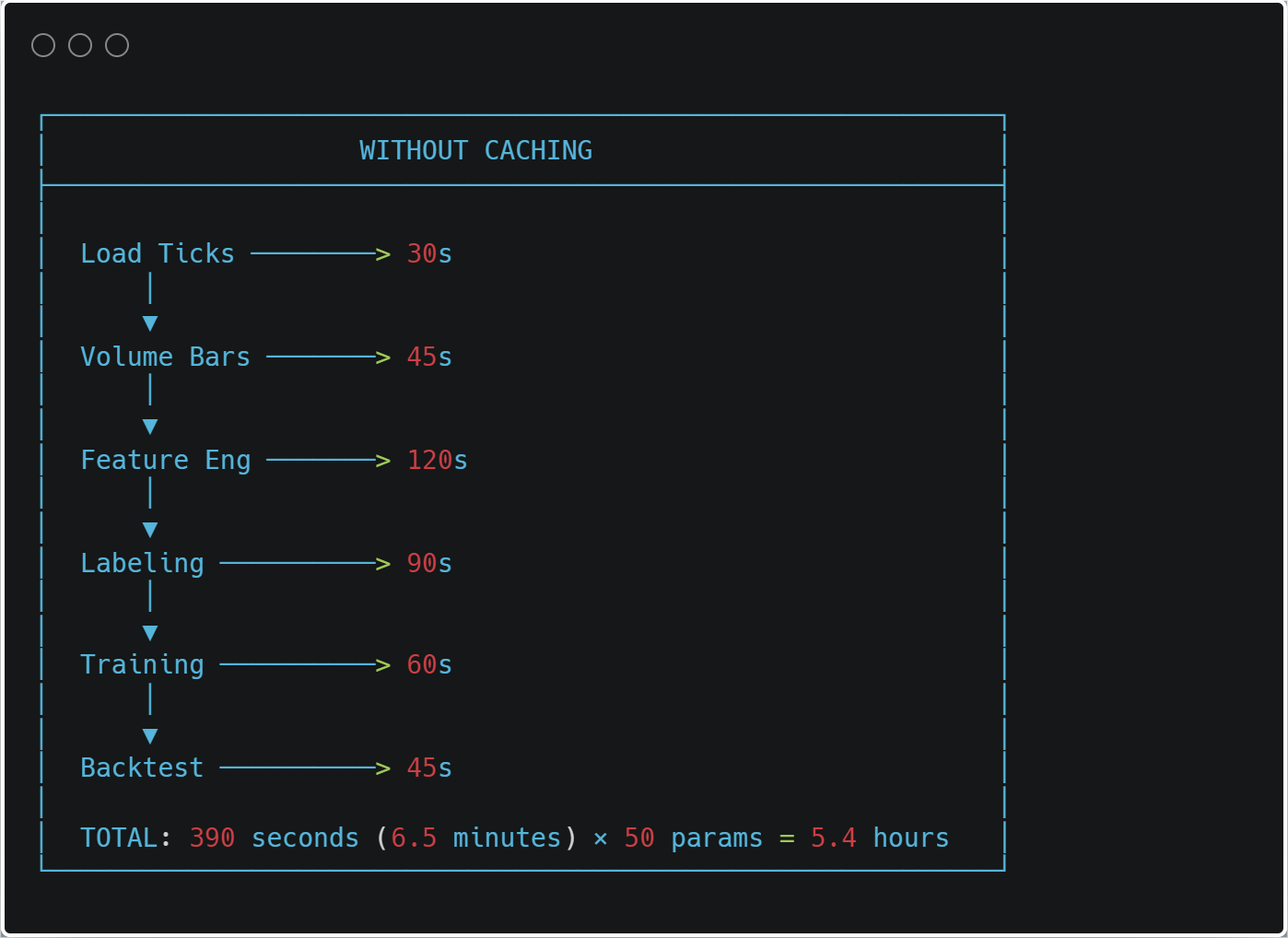

Визуализация вычислительного конвейера

Прежде чем внедрять кэширование, важно понять, сколько времени на самом деле занимает каждая операция в конвейере машинного обучения. На приведенной ниже схеме показан полный путь от загрузки тиков до окончательного бэктеста, а также количество секунд, затрачиваемое на каждый этап без использования кэширования.

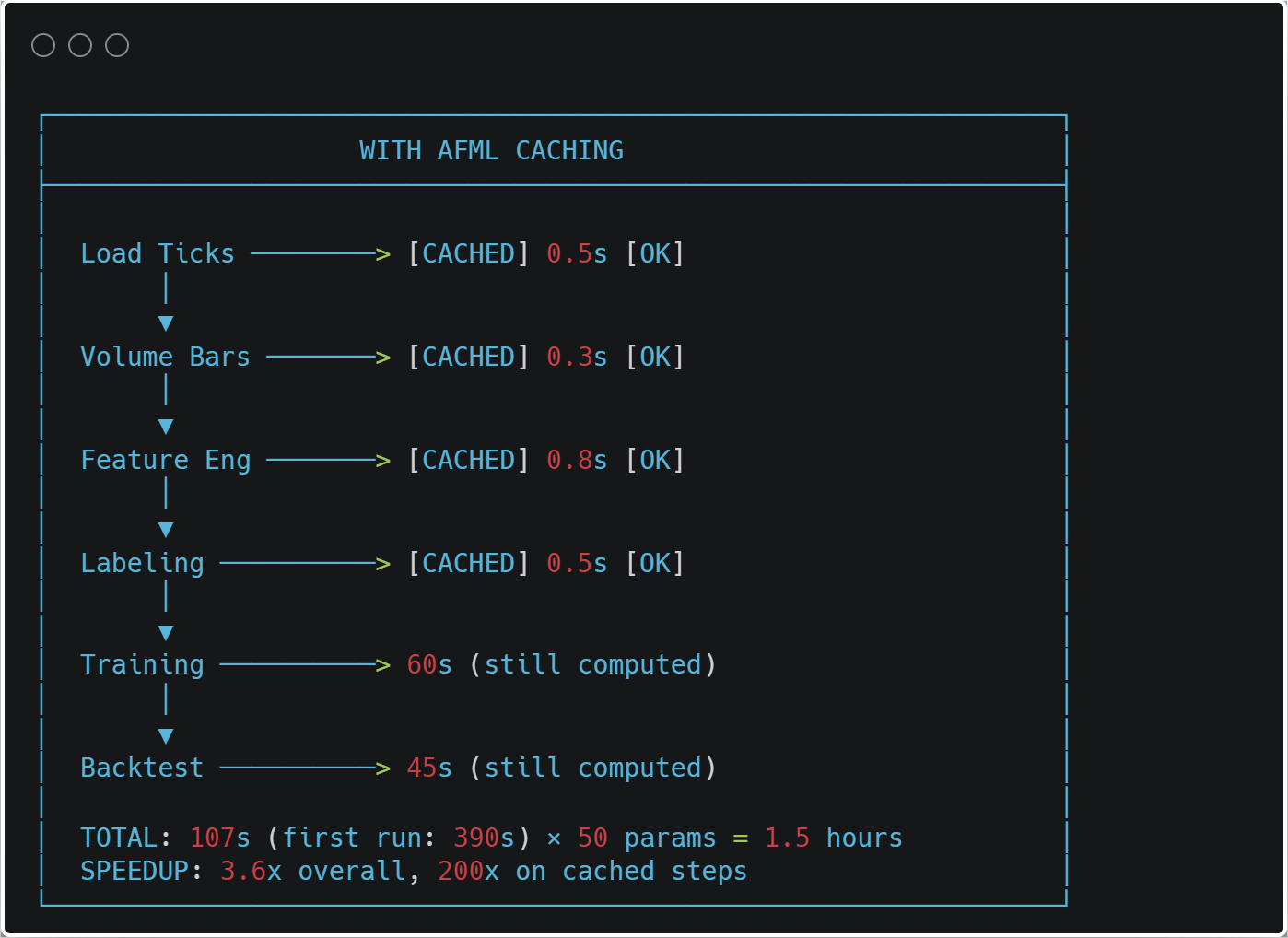

Теперь давайте посмотрим, как эта же последовательность операций работает при включенном кэшировании AFML. Обратите внимание, что большинство шагов больше не пересчитываются, а загружаются мгновенно. Разница в скорости хорошо видна на приведенном ниже графике.

Почему общее кэширование не подходит для машинного обучения в финансовой сфере

Давайте разберемся, почему очевидное решение не работает.

Может показаться, что нет ничего проще, чем просто использовать стандартный lru_cache. Ниже приведён простой пример, демонстрирующий, что встроенный кэш Python перестает работать корректно при работе с финансовыми структурами данных, такими как Pandas Series и DataFrame.

# This is USELESS for financial data. Don't do this. from functools import lru_cache @lru_cache(maxsize=128) def compute_rsi(prices, period=14): delta = prices.diff() gain = delta.where(delta > 0, 0) loss = -delta.where(delta < 0, 0) avg_gain = gain.ewm(alpha=1/period, adjust=False).mean() avg_loss = loss.ewm(alpha=1/period, adjust=False).mean() rs = avg_gain / avg_loss rsi = 100 - (100 / (1 + rs)) return rsi compute_rsi(bb_df.close, period=14) --------------------------------------------------------------------------- TypeError Traceback (most recent call last) Cell In[25], line 18 15 rsi = 100 - (100 / (1 + rs)) 16 return rsi ---> 18 compute_rsi(bb_df.close, period=14) TypeError: unhashable type: 'Series'

Хотя в Python есть модуль `functools.lru_cache`, он в принципе не подходит для финансового машинного обучения:

- Хранение только в памяти — кэш удаляется при завершении работы Python.

- Данные не сохраняются между сессиями — после каждого перезапуска необходимо запускать все заново.

- Автоматическая инвалидция отсутствует — при изменении кода используется устаревший кэш.

- Плохо работает с NumPy/Pandas — проблемы с хешированием массивов.

- Отсутствует распределенное кэширование — невозможно совместно использовать кэш между процессами.

- Отсутствие понимания финансовых данных — не распознает временные метки и не учитывает предвзятость прогнозов.

Часть I: Основы архитектуры

Основные принципы проектирования

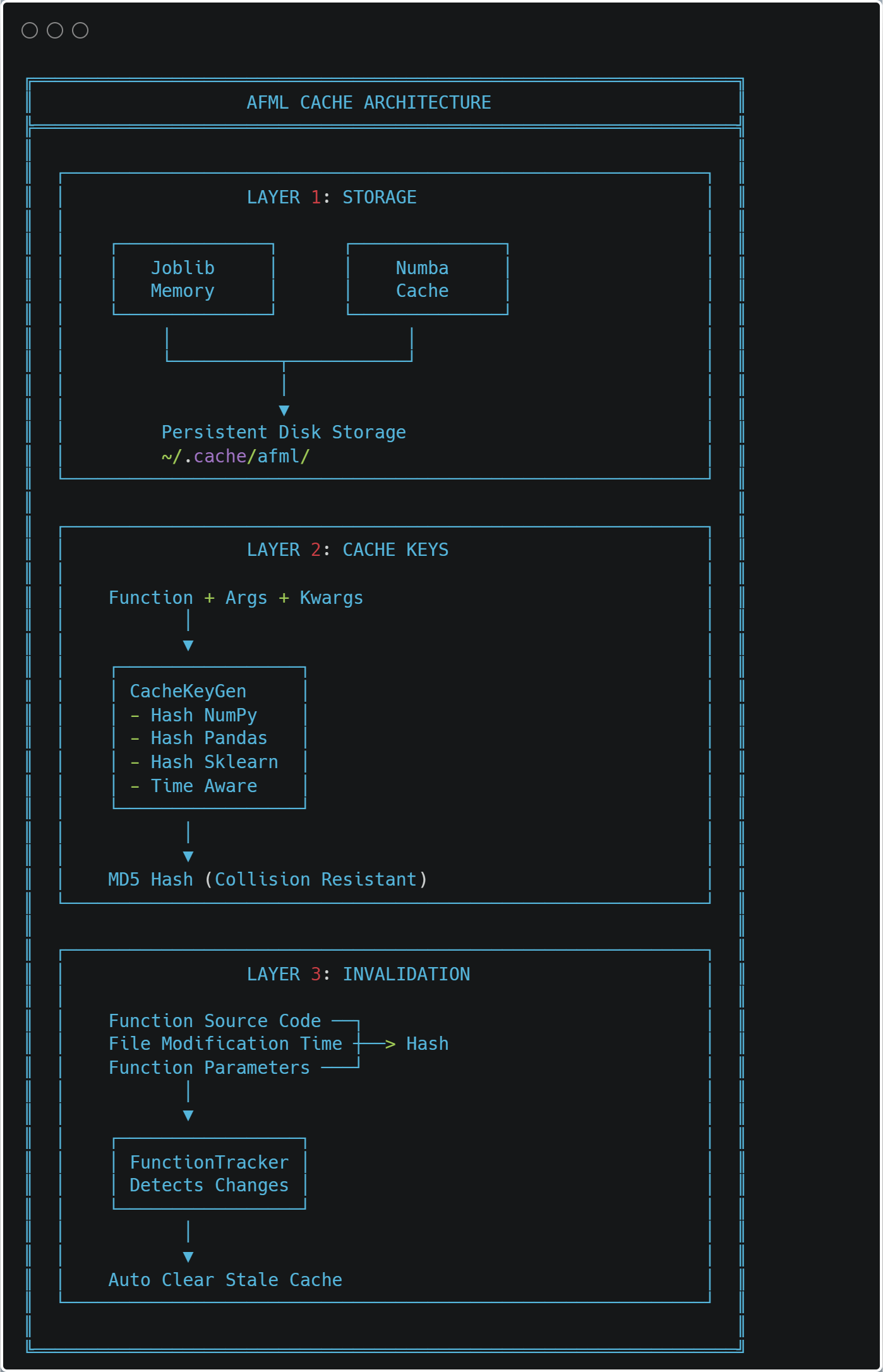

Наша система кэширования AFML основана на трёх основных принципах:

Давайте разберемся, для чего нужен каждый компонент и как они взаимодействуют друг с другом.

Задача № 1: Постоянное хранилище

Начнём с первого и самого очевидного ограничения — стандартный кэш хранится исключительно в оперативной памяти. Как только вы перезапустите Python, все результаты исчезнут. Вот краткая демонстрация того, как выглядит «обычный подход» и почему он бесполезен в реальных конвейерах машинного обучения.

# Traditional approach - memory only from functools import lru_cache @lru_cache(maxsize=128) def compute_features(data): # Expensive computation return features # Lost on restart!

AFML решает эту проблему простым способом: мы сохраняем кэш на диск. Joblib сохраняет результаты вычислений между запусками Python, поэтому даже после перезапуска вы сразу же получаете ранее вычисленные данные. Пример реализации приведен ниже.

# AFML approach - persistent from joblib import Memory from appdirs import user_cache_dir memory = Memory(location=user_cache_dir("afml"), verbose=0) @memory.cache def compute_features(data): # Expensive computation return features # Saved to disk automatically!

Задача № 2: Хеширование сложных финансовых структур данных

А кроме того, есть ещё более серьезная проблема:финансовые данные невозможно хешировать с помощью стандартных методов. DataFrames в Pandas, массивы NumPy и даты — все это «нехешируемые» данные, и обычный кэш просто не подойдет. Вот пример того, как это работает.

# This fails! import pandas as pd from functools import lru_cache @lru_cache def bad_cache_example(df: pd.DataFrame): return df.mean() df = pd.DataFrame({'price': [100, 101, 102]}) bad_cache_example(df) # TypeError: unhashable type: 'DataFrame'

Чтобы обеспечить правильную работу кэша, AFML создает собственный генератор ключей. Он может «понимать» DataFrame: их структуру, типы данных, столбцы, индексы и, что наиболее важно, временной диапазон. Вот как выглядит пользовательская реализация хеширования.

# afml/cache/robust_cache_keys.py class CacheKeyGenerator: """Generate collision-resistant cache keys for ML data structures.""" @staticmethod def _hash_dataframe(df: pd.DataFrame, name: str) -> str: """ Hash DataFrame with attention to: 1. Shape and structure 2. Column names and types 3. Index (especially DatetimeIndex) 4. Actual data content """ parts = [ f"shape_{df.shape}", f"cols_{hashlib.md5(str(tuple(df.columns)).encode()).hexdigest()[:8]}", f"dtypes_{hashlib.md5(str(tuple(df.dtypes)).encode()).hexdigest()[:8]}", ] # Special handling for DatetimeIndex (critical for financial data!) if isinstance(df.index, pd.DatetimeIndex): # Hash: start date, end date, and length # This catches both data changes AND temporal shifts parts.append(f"idx_dt_{df.index[0]}_{df.index[-1]}_{len(df.index)}") else: idx_hash = hashlib.md5(str(tuple(df.index)).encode()).hexdigest()[:8] parts.append(f"idx_{idx_hash}") # For large DataFrames, sample for performance if df.size > 10000: # Sample ~100 rows evenly distributed sample_rows = df.iloc[::max(1, len(df) // 100)] content_hash = hashlib.md5(sample_rows.values.tobytes()).hexdigest()[:8] else: # Hash full content for small DataFrames content_hash = hashlib.md5(df.values.tobytes()).hexdigest()[:8] parts.append(f"data_{content_hash}") return f"{name}_df_{'_'.join(parts)}"

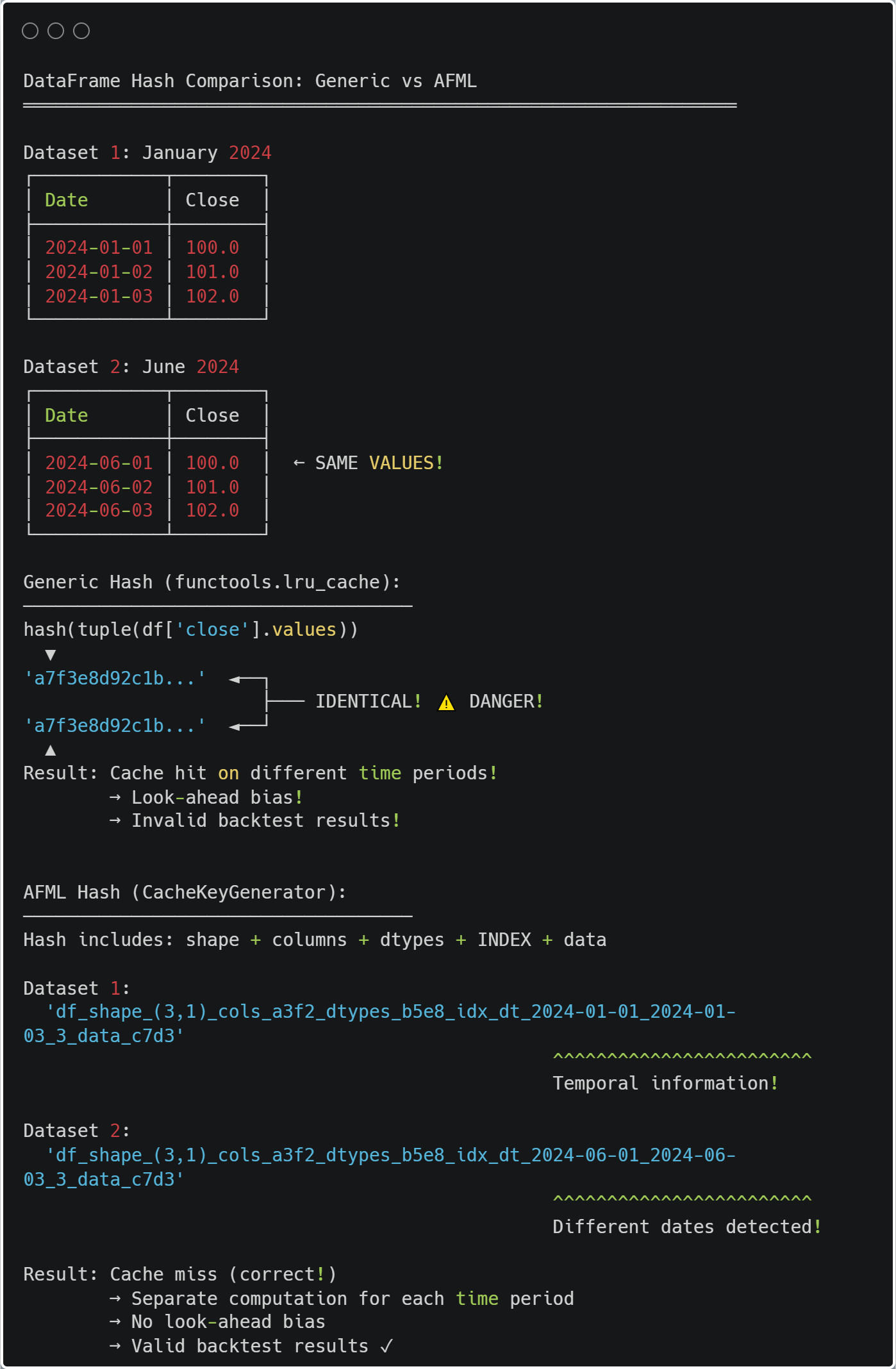

Чтобы понять преимущества пользовательского хеширования, давайте сравним, как стандартный Python кэширует данные, и как это делает AFML. Ниже приведена иллюстрация того, почему стандартный подход приводит к смещению look‑ahead, в то время как AFML — нет.

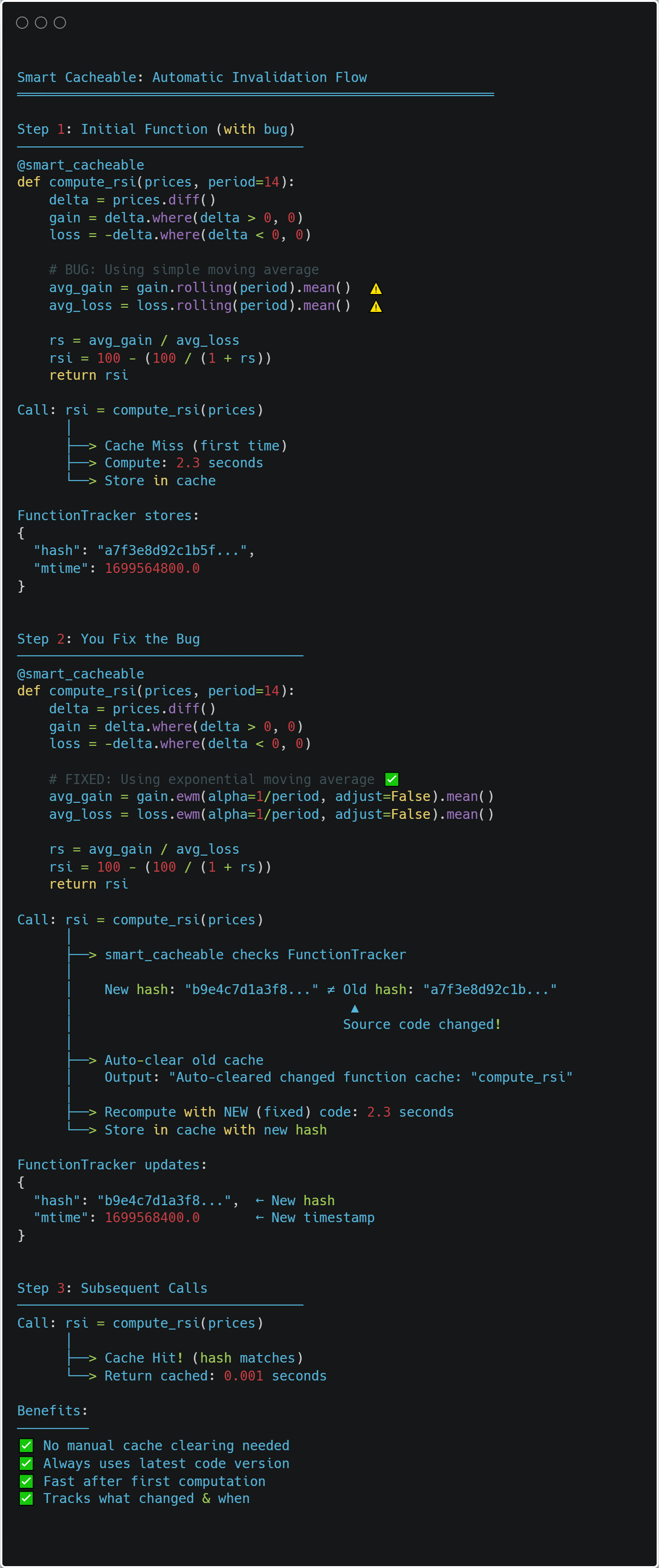

Задача № 3: Автоматическая очистка кэша при изменении кода

Даже идеальный кэш теряет всякую ценность, если вы вносите изменения в код, а в кэше остаются старые, устаревшие результаты. AFML автоматически отслеживает любые изменения в функциях и очищает только ту часть кэша, которая устарела. Давайте разберемся, как это реализовано.

AFML сохраняет хеш исходного кода функции и дату последнего изменения файла. Если что-либо изменится, кэш для этой функции автоматически сбрасывается. Вот как этот механизм работает изнутри.

# afml/cache/selective_cleaner.py class FunctionTracker: """ Tracks function signatures and source code hashes. Automatically detects when functions change. """ def track_function(self, func) -> bool: """ Returns True if function has changed since last tracking. """ func_name = f"{func.__module__}.{func.__qualname__}" # Get current function metadata current_hash = self._get_function_hash(func) # Hash source code current_mtime = self._get_file_mtime(func) # File modification time # Compare with stored metadata stored = self.tracked_functions.get(func_name, {}) stored_hash = stored.get("hash") stored_mtime = stored.get("mtime") # Function changed if EITHER hash or mtime differs has_changed = ( current_hash != stored_hash or current_mtime != stored_mtime or stored_hash is None # New function ) if has_changed: # Update tracking data self.tracked_functions[func_name] = { "hash": current_hash, "mtime": current_mtime, "module": func.__module__, } self._save_tracking_data() return has_changed def _get_function_hash(self, func) -> Optional[str]: """Hash function source code.""" try: source = inspect.getsource(func) return hashlib.md5(source.encode()).hexdigest() except (OSError, TypeError): return None

Чтобы увидеть это на практике, рассмотрим реальную ситуацию: функция изначально содержит ошибку, затем мы её исправляем — и AFML автоматически обнаруживает это изменение, очищая только соответствующую часть кэша.

Часть II: Надежный декоратор с поддержкой кэширования

Все возможности AFML объединены в одном мощном фабричном декораторе. Он создает нужный тип кэширования: обычный, временный, с отслеживанием данных, с отслеживанием кода и т. д. Вот исходный код для этого фабричного объекта.

# afml/cache/robust_cache_keys.py def create_robust_cacheable( track_data_access: bool = False, dataset_name: Optional[str] = None, purpose: Optional[str] = None, use_time_awareness: bool = False, ): """ Factory function to create robust cacheable decorators. This is where all the magic comes together. """ from functools import wraps from . import cache_stats, memory from .cache_monitoring import get_cache_monitor def decorator(func): func_name = f"{func.__module__}.{func.__qualname__}" cached_func = memory.cache(func) # Use joblib for persistence seen_signatures = set() # Track cache hits/misses monitor = get_cache_monitor() # Performance monitoring @wraps(func) def wrapper(*args, **kwargs): # Step 1: Generate cache key try: if use_time_awareness: cache_key = TimeSeriesCacheKey.generate_key_with_time_range( func, args, kwargs ) else: cache_key = CacheKeyGenerator.generate_key(func, args, kwargs) # Step 2: Track hit/miss if cache_key in seen_signatures: cache_stats.record_hit(func_name) is_hit = True else: cache_stats.record_miss(func_name) seen_signatures.add(cache_key) is_hit = False except Exception as e: logger.warning(f"Cache key generation failed: {e}") cache_stats.record_miss(func_name) cache_key = None is_hit = False # Step 3: Track data access if requested (prevent look-ahead bias) if track_data_access: try: from .data_access_tracker import get_data_tracker _track_dataframe_access( get_data_tracker(), args, kwargs, dataset_name, purpose ) except Exception as e: logger.warning(f"Data tracking failed: {e}") # Step 4: Track access time (for monitoring) monitor.track_access(func_name) # Step 5: Execute function with timing start_time = time.time() try: result = cached_func(*args, **kwargs) # Track computation time for misses if not is_hit: computation_time = time.time() - start_time monitor.track_computation_time(func_name, computation_time) return result except (EOFError, pickle.PickleError, OSError) as e: # Handle cache corruption gracefully logger.warning(f"Cache corruption: {type(e).__name__} - recomputing") # Clear corrupted cache if cache_key is not None: _clear_corrupted_cache(cached_func, cache_key) # Execute function directly return func(*args, **kwargs) wrapper._afml_cacheable = True return wrapper return decorator

# Standard decorators robust_cacheable = create_robust_cacheable(use_time_awareness=False) time_aware_cacheable = create_robust_cacheable(use_time_awareness=True) # Data tracking decorators data_tracking_cacheable = lambda dataset_name, purpose: create_robust_cacheable( track_data_access=True, dataset_name=dataset_name, purpose=purpose, use_time_awareness=False ) time_aware_data_tracking_cacheable = lambda dataset_name, purpose: create_robust_cacheable( track_data_access=True, dataset_name=dataset_name, purpose=purpose, use_time_awareness=True )

Часть III: Расширенные шаблоны кэширования

Шаблон № 1: Кэширование с учетом времени для walk‑forward анализа

При пошаговой валидации крайне важно, чтобы кэш различал различные временные интервалы. Без этого легко могут возникнуть конфликты и неверные результаты. На приведенной ниже схеме показано, как это работает на практике.

Time Series Data (2024): ───────────────────────────────────────────────────────────────────── Jan Feb Mar Apr May Jun Jul Aug Sep Oct Nov Dec ├────┼────┼────┼────┼────┼────┼────┼────┼────┼────┼────┼────┤ │ │ │ │ │ │ │ │ │ │ │ │ │ ▼────▼────▼────▼────▼────▼────▼────▼────▼────▼────▼────▼────▼ Walk-Forward Splits: ───────────────────────────────────────────────────────────────────── Split 1: Train Period: Jan-Mar Test Period: Apr ├─────────────────────────────┤ ├───────┤ Split 2: Train Period: Feb-Apr Test Period: May ├─────────────────────────────┤ ├───────┤ Split 3: Train Period: Mar-May Test Period: Jun ├─────────────────────────────┤ ├───────┤

Приведенный ниже пример показывает, как при использовании обычного кэширования с двумя разными временными интервалами может получиться один и тот же хеш. В результате модель обучается на неверных данных, и возникает смещение look-ahead.

@robust_cacheable # Generic caching def train_model(data, params): return model Split 1: data = data['2024-01':'2024-03'] Cache Key: hash(data.values) └──> "a7f3e8d92c1b..." ◄──┐ │ Split 2: data = data['2024-02':'2024-04'] │ Cache Key: hash(data.values) │ └──> "a7f3e8d92c1b..." ◄──┘ COLLISION! └──> Cache hit on DIFFERENT time period └──> Model trained on wrong data!

Кэш с учетом времени добавляет временной диапазон при генерации ключа, что полностью исключает подобные коллизии. Посмотрите, как кэш теперь корректно различает временные периоды.

@time_aware_cacheable # Includes temporal info def train_model(data, params): return model Split 1: data = data['2024-01':'2024-03'] Cache Key: hash(data.values + "2024-01_2024-03") └──> "a7f3_time_2024-01_2024-03" Split 2: data = data['2024-02':'2024-04'] Cache Key: hash(data.values + "2024-02_2024-04") └──> "b9e4_time_2024-02_2024-04" ← Different! └──> Cache miss (correct) └──> Train new model for this period ✓ Split 3: data = data['2024-03':'2024-05'] Cache Key: hash(data.values + "2024-03_2024-05") └──> "c7d1_time_2024-03_2024-05" ← Different! └──> Cache miss (correct) └──> Train new model for this period ✓

Ниже приведена реализация класса, который добавляет временные метки к ключам кэша.

class TimeSeriesCacheKey(CacheKeyGenerator): """Extended cache key generator with time-series awareness.""" @staticmethod def generate_key_with_time_range( func, args: tuple, kwargs: dict, time_range: Tuple[pd.Timestamp, pd.Timestamp] = None ) -> str: """ Generate cache key that includes time range information. Critical for preventing temporal data leakage. """ base_key = CacheKeyGenerator.generate_key(func, args, kwargs) if time_range is None: # Try to extract time range from data time_range = TimeSeriesCacheKey._extract_time_range(args, kwargs) if time_range: start, end = time_range time_hash = f"time_{start}_{end}" return f"{base_key}_{time_hash}" return base_key

# Usage in walk-forward validation @time_aware_cacheable def train_on_period(data: pd.DataFrame, params: dict) -> Model: """ Train model on specific time period. Cache is automatically keyed by time range! """ model = RandomForestClassifier(**params) model.fit(data.drop('target', axis=1), data['target']) return model # Walk-forward loop for train_start, train_end, test_start, test_end in walk_forward_splits: # Each period is cached independently train_data = data.loc[train_start:train_end] model = train_on_period(train_data, params) # Cached per period test_data = data.loc[test_start:test_end] predictions = model.predict(test_data)

Шаблон № 2: Кэширование с перекрестной проверкой при использовании оценщиков Sklearn

Кэширование при перекрестной проверке — это отдельная тема. Классификаторы Sklearn содержат внутреннее состояние, которое нельзя напрямую хешировать. AFML решает эту проблему, хешируя только тип модели и её параметры. Ниже приведена ключевая функция.

# afml/cache/cv_cache.py def _hash_classifier(clf: BaseEstimator) -> str: """ Generate stable hash for sklearn classifier. KEY INSIGHT: Hash the type + parameters, NOT the trained state! """ try: clf_type = type(clf).__name__ params = clf.get_params(deep=True) # Filter out non-serializable params serializable_params = {} for k, v in params.items(): try: json.dumps(v) # Test if JSON serializable serializable_params[k] = v except (TypeError, ValueError): # Use type name for non-serializable params serializable_params[k] = f"<{type(v).__name__}>" # Create stable hash param_str = json.dumps(serializable_params, sort_keys=True) combined = f"{clf_type}_{param_str}" return hashlib.md5(combined.encode()).hexdigest()[:12] except Exception as e: logger.debug(f"Failed to hash classifier: {e}") return f"clf_{type(clf).__name__}_{id(clf)}"

Вот как выглядит декоратор для кэширования результатов перекрестной проверки. Это позволяет сэкономить огромное количество времени при выборе гиперпараметров.

@cv_cacheable

def ml_cross_val_score(

classifier: BaseEstimator,

X: pd.DataFrame,

y: pd.Series,

cv_gen, # PurgedKFold, TimeSeriesSplit, etc.

sample_weight_train: Optional[np.ndarray] = None,

scoring: str = 'neg_log_loss'

) -> np.ndarray:

"""

Cross-validation with proper caching.

Caches based on:

- Classifier type and parameters (not trained state)

- Data content (X, y)

- CV generator configuration

- Sample weights

"""

scores = []

for train_idx, test_idx in cv_gen.split(X):

X_train, X_test = X.iloc[train_idx], X.iloc[test_idx]

y_train, y_test = y.iloc[train_idx], y.iloc[test_idx]

# Train fresh model (not from cache)

model = clone(classifier)

if sample_weight_train is not None:

model.fit(X_train, y_train,

sample_weight=sample_weight_train[train_idx])

else:

model.fit(X_train, y_train)

score = model.score(X_test, y_test)

scores.append(score)

return np.array(scores)

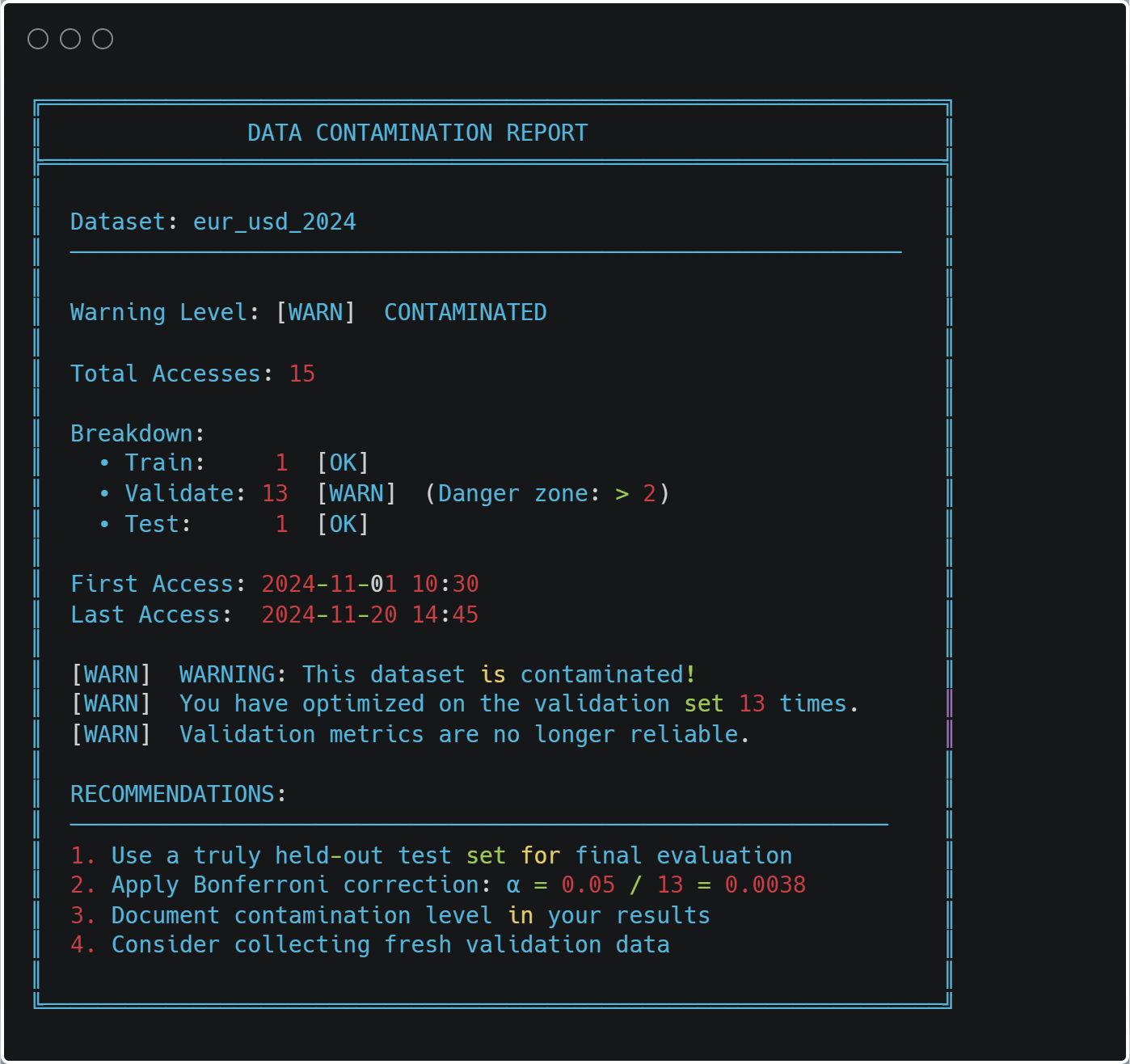

Шаблон № 3: Предотвращение контаминации тестового набора

При разработке моделей машинного обучения одной из самых незаметных ошибок является случайное использование тестовых данных во время обучения. AFML отслеживает каждый доступ к набору данных и уведомляет вас о любых утечках.

Вот как AFML регистрирует каждый доступ к данным, фиксируя временной интервал, цель (обучение, тестирование, проверка) и источник вызова. На основании этих журналов система затем формирует отчет о возможных утечках.

# afml/cache/data_access_tracker.py class DataAccessTracker: """ Track every data access to detect test set contamination. This is CRITICAL for preventing data snooping bias. """ def log_access( self, dataset_name: str, start_date: pd.Timestamp, end_date: pd.Timestamp, purpose: str, # 'train', 'test', 'validate', 'optimize' data_shape: Optional[Tuple[int, int]] = None, ): """Log a dataset access with full temporal metadata.""" entry = { "timestamp": datetime.now().isoformat(), "dataset": dataset_name, "start_date": str(start_date), "end_date": str(end_date), "purpose": purpose, "data_shape": str(data_shape) if data_shape else None, "caller": self._get_caller_info(), # Stack trace } self.access_log.append(entry) logger.debug( f"Logged access: {dataset_name} [{start_date} to {end_date}] " f"for {purpose}" )

# Usage with caching decorator @time_aware_data_tracking_cacheable(dataset_name="eur_usd_2024", purpose="test") def evaluate_on_test_set(test_data: pd.DataFrame, model) -> dict: """ Evaluate model on test set. Access is logged automatically! """ predictions = model.predict(test_data) metrics = calculate_metrics(predictions, test_data['target']) return metrics

Чтобы проверить наличие контаминаций в процессе разработки модели, мы вызываем функцию print_contamination_report(), как показано ниже:

# Later, check for contamination from afml.cache import print_contamination_report print_contamination_report()

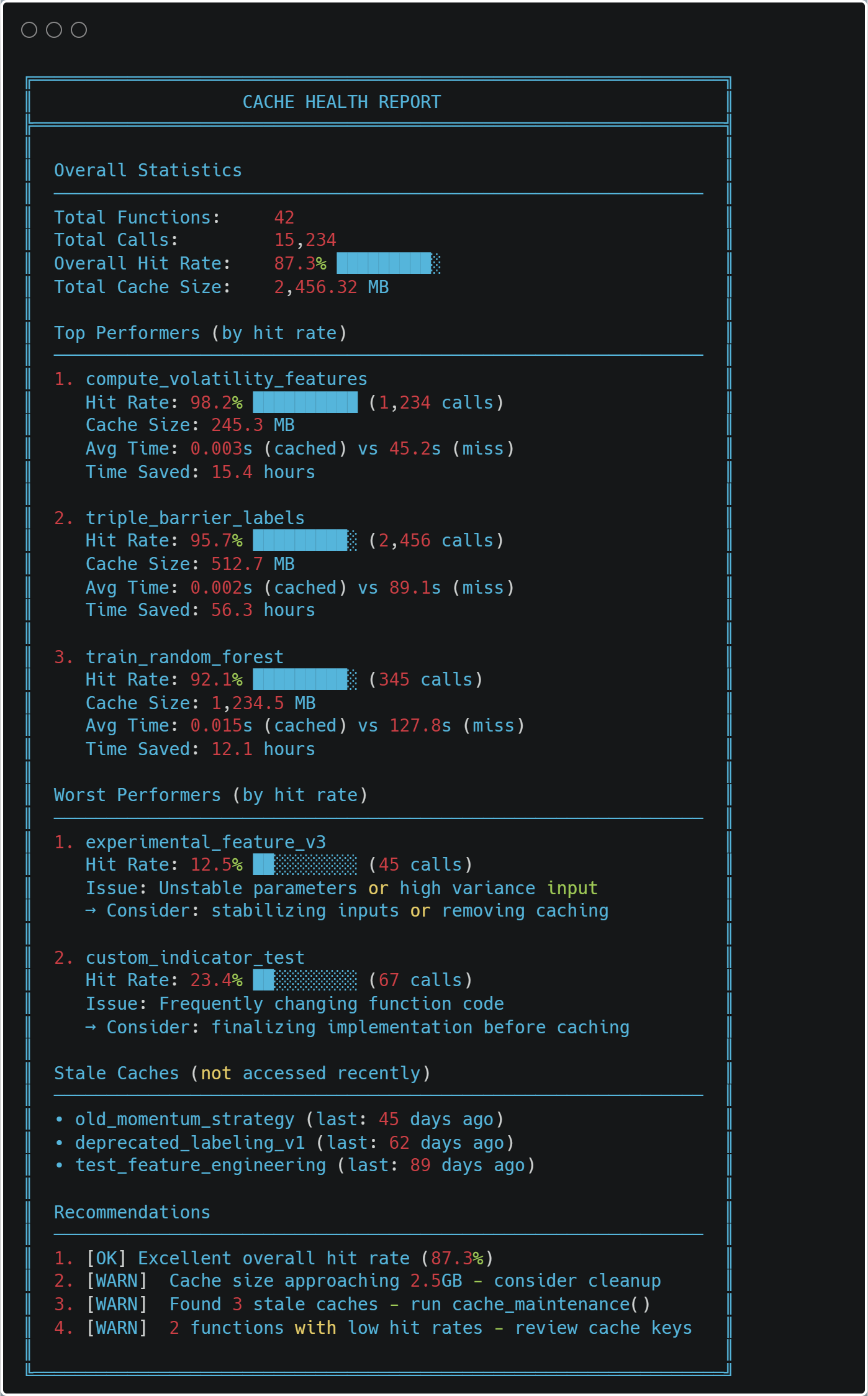

Часть IV: Мониторинг и оптимизация производительности

Мониторинг состояния и эффективности кэша

AFML также обеспечивает встроенный мониторинг состояния и эффективности кэша:

- какие функции чаще всего кэшируются

- где происходят промахи кэша

- каков размер кэша

- есть ли какие-либо подозрительные ситуации

from afml.cache import print_cache_health print_cache_health()

Часть V: Интеграция с существующими проектами

Чтобы начать пользоваться системой, просто импортируйте модуль и воспользуйтесь нужным декоратором. Сложной настройки не требуется — вот пример того, как это выглядит в реальном проекте.

Запустите приведенный ниже код в терминале, чтобы клонировать репозиторий, или скачайте файл cache.zip:

git clone https://github.com/pnjoroge54/Machine-Learning-Blueprint.git cd Machine-Learning-Blueprint/afml/cacheЗатем скопируйте модули кэша в свой собственный пакет:

my_package/ ├── cache/ │ ├── __init__.py │ ├── backtest_cache.py │ ├── cache_monitoring.py │ ├── cv_cache.py │ ├── data_access_tracker.py │ ├── robust_cache_keys.py │ ├── selective_cleaner.py │ └── mql5_bridge.py

Подробную информацию о внедрении этой системы кэширования в ваш проект см.. в файле user_guide.py.

Заключение: От скорости исследований к скорости реализации

Система кэширования AFML коренным образом преобразует процесс разработки финансовых моделей машинного обучения, устраняя два ключевых препятствия, отделяющих исследовательский этап от промышленного применения: скорость итераций и задержку выполнения.

Скорость исследований: основа генерации альфы

На этапе исследования наша архитектура кэширования открывает беспрецедентные возможности для исследования:

-

Быстрая подготовка признаков: Протестируйте десятки комбинаций технических индикаторов, периодов RSI и расчетов волатильности без повторного вычисления базовых преобразований. Система интеллектуально кэширует промежуточные результаты, что позволяет сосредоточиться на отборе признаков, а не ждать вычислений.

-

Всестороннее тестирование стратегии: Запустить перекрестную валидацию с использованием алгоритма PurgedKFold для сотен комбинаций параметров. Характеристики и метки каждого набора данных сохраняются в кэше, что позволяет проводить тщательное тестирование на исторических данных в больших масштабах без утечки временных данных, которая является серьезной проблемой традиционных подходов.

-

Анализ нескольких таймфреймов: Проведите эксперимент по изучению взаимодействия сложных характеристик на 1-минутных, 5-минутных и часовых таймфреймах. Кэширование с учетом времени гарантирует, что вычисления для каждого периода остаются независимыми и воспроизводимыми.

-

Оптимизация стратегии разметки: Сравните подходы «Triple-Barrier», «Trend-Scanning» и «Meta-Labeling» без повторного выполнения ресурсоемких операций выборки баров.

Полный цикл: От исследования до реализации

Наша архитектура кэширования обеспечивает плавный переход от экспериментальных исследований к реальной торговле:

- Этап исследования: Используйте богатую экосистему Python в сочетании с кэшированием AFML для быстрого проведения экспериментов и проверки результатов

- Экспорт модели: Преобразование проверенных моделей в формат ONNX для развертывания без зависимостей

- Миграция конвейера признаков: Реализовать вычисления критически важных характеристик непосредственно в MQL5 с использованием параллельного кэширования

- Развертывание в производственной среде: Реализуйте стратегии с задержкой в микросекунды, сохраняя при этом достоверность исследований

Целостность данных: Незаметное преимущество

Помимо производительности, функция автоматического отслеживания доступа к данным в системе предотвращает незаметное засорение данных, которое подрывает эффективность производственных систем машинного обучения. Полные журналы аудита гарантируют, что вы никогда случайно не будете оптимизировать на тестовых данных, а учет временных параметров обеспечивает целостность проверки методом walk-forward-анализа.

Взгляд в будущее: Последний рубеж

В следующей части мы завершим построение конвейера следующим образом:

- Развертывание модели ONNX: Экспорт scikit-learn и пользовательских моделей для запуска непосредственно в MQL5 без зависимости от Python

- Механизм вывода MQL5: Создавайте системы прогнозирования со сверхнизкой задержкой, работающие за доли микросекунд

- Управление гибридными функциями: Разрабатывайте интеллектуальные системы, в которых сложные функции сначала реализуются на языке Python на этапе исследований, а затем переносятся на язык MQL5 для использования в производственной среде

- Мониторинг моделей в режиме реального времени: Реализовать функцию обнаружения дрифта и отслеживания производительности в среде исполнения MQL5

В результате получается полноценная экосистема, в которой вы можете проводить исследования, пользуясь гибкостью Python, развертывать решения с высокой производительностью MQL5 и сохранять научную строгость на протяжении всего жизненного цикла. Речь идет не просто об ускорении вычислений — речь идет о создании платформы, на которой сложные стратегии машинного обучения смогут реально работать на реальных рынках.

Репозиторий кода

Весь код из этой статьи доступен в репозитории Machine-Learning-Blueprint. Запустите приведенный ниже код в терминале, чтобы клонировать репозиторий:

git clone https://github.com/pnjoroge54/Machine-Learning-Blueprint.git cd Machine-Learning-Blueprint/afml/cache

Файлы модулей

| Файл модуля | Цель | Основные особенности | Когда использовать |

|---|---|---|---|

| __init__.py | Центральный модуль инициализации и координации | • Инициализирует все подсистемы кэша • Настраивает кэширование Numba и Joblib • Предоставляет единый API для всех функций кэша • Экспортирует вспомогательные функции • Настраивает каталоги кэша | Импортируйте этот файл, чтобы получить доступ ко всем функциям кэша. Это единственная точка входа во всю систему. |

| robust_cache_keys.py | Усовершенствованная генерация ключей кэша для финансовых данных | • Правильно хеширует массивы NumPy • Работает с DataFrame-ами Pandas с DatetimeIndex • Генерация ключей с учетом временных рядов • Хеширование оценок Sklearn • Предотвращает утечку временных данных | Используйте для любых функций, обрабатывающих финансовые временные ряды, массивы данных (DataFrames) или модели машинного обучения. |

| selective_cleaner.py | Интеллектуальная система очистки кэша | • Отслеживание изменений в исходном коде • Автоматическая очистка кэша при изменении кода • Выборочная очистка по модулям • Очистка по размеру и сроку хранения • Декоратор `smart_cacheable` | Используйте во время активной разработки, чтобы избежать проблем с устаревшим содержимым кэша. Незаменимый инструмент для итеративных исследований. |

| data_access_tracker.py | Предотвращает засорение набора для тестирования | • Регистрирует каждый доступ к набору данных с указанием времени • Отслеживает использование наборов данных для обучения, тестирования и валидации • Создает отчеты о контаминации данных • Выявляет смещение из‑за неоднократного просмотра данных • Обеспечивает аудиторский след | Имеет решающее значение для обеспечения научной честности. Используйте для отслеживания всех операций доступа к данным в процессе разработки модели. |

| cv_cache.py | Кросс-валидация и специализированное кэширование | • Эффективно кэширует результаты кроссинговой проверки • Правильно обрабатывает оценщики sklearn • Поддерживает PurgedKFold и настраиваемую кроссинговую проверку • Разделяет параметры оценщика и состояние • Быстрые итерации кроссинговой проверки | Используйте при проведении ресурсоемких экспериментов по перекрестной валидации. Значительно ускоряет оптимизацию гиперпараметров. |

| backtest_cache.py | Оптимизация рабочего процесса бэктестинга | • Кэширование полных циклов бэктестинга • Поддержка анализа «walk-forward» • Отслеживание оптимизации параметров • Кэширование на уровне сделок • Инструменты для сравнения результатов | Необходимо для разработки стратегии. Сохраните результаты бэктеста в кэше, чтобы эффективно сравнивать различные варианты параметров. |

| cache_monitoring.py | Анализ производительности и диагностика | • Отслеживание частоты выполнения по функциям • Измерение времени выполнения • Мониторинг объёма кэша • Отчёты о работоспособности и рекомендации • Анализ эффективности | Используйте для анализа производительности кэша и выявления возможностей для оптимизации. |

| mlflow_integration.py | Интеграция отслеживания экспериментов | • Объединяет кэширование с MLflow • Автоматическая регистрация экспериментов • Управление версиями моделей • Отслеживание метрик • Сравнение результатов | Используйте в производственных исследовательских средах для отслеживания экспериментов, одновременно пользуясь преимуществами кэширования. |

| mql5_bridge.py | Мост связи между Python и MQL5 | • Запуск скриптов Python из MQL5 • Сигнализация на основе файлов для межъязыкового выполнения • Поддержка вывода результатов моделирования в реальном времени • Интеграция конвейеров машинного обучения с MetaTrader 5 | Используйте при развертывании моделей машинного обучения на базе Python в торговых средах MQL5 для автоматизации. |

| startup_script.py | Настройка среды и кэша | • Инициализирует каталоги кэша и ведение журналов • Загружает переменные среды • Обеспечивает воспроизводимый запуск • Может запускать настройку MLflow или мониторинга | Используйте в начале любого рабочего процесса машинного обучения или трейдинга, чтобы обеспечить единообразную и воспроизводимую настройку. |

| PythonBridgeEA.mq5 | Мост MQL5 с прилагаемым графиком для Python | • Выступает в качестве связующего звена между MQL5 и Python • Использует события графиков и обмен данными через файлы • Запускает скрипты Python из MetaTrader • Синхронизирует торговую логику с результатами работы Python | Подключите к графику, чтобы обеспечить связь с Python из MetaTrader 5. Необходимо для интеграции машинного обучения в режиме реального времени. |

Перевод с английского произведен MetaQuotes Ltd.

Оригинальная статья: https://www.mql5.com/en/articles/20302

Предупреждение: все права на данные материалы принадлежат MetaQuotes Ltd. Полная или частичная перепечатка запрещена.

Данная статья написана пользователем сайта и отражает его личную точку зрения. Компания MetaQuotes Ltd не несет ответственности за достоверность представленной информации, а также за возможные последствия использования описанных решений, стратегий или рекомендаций.

Особенности написания Пользовательских Индикаторов

Особенности написания Пользовательских Индикаторов

Dynamic Swing Architecture: Распознавание структуры рынка — от свингов до автоматического исполнения сделок

Dynamic Swing Architecture: Распознавание структуры рынка — от свингов до автоматического исполнения сделок

Алгоритм оптимизации грифов — Buzzard Optimization Algorithm (BUZOA)

Алгоритм оптимизации грифов — Buzzard Optimization Algorithm (BUZOA)

- Бесплатные приложения для трейдинга

- 8 000+ сигналов для копирования

- Экономические новости для анализа финансовых рынков

Вы принимаете политику сайта и условия использования