神经网络变得轻松(第五十五部分):对比内在控制(CIC)

概述

在之前的文章中,我们已讨论过使用层次化模型的益处。我们研究的训练模型的方法,能够提取和突出独立智能体的技能。获得的技能对于达成任务的终极目标很实用。此类算法的示例包括 DIAYN、DADS 和 EDL。这些算法以不同的方式处理技能训练过程,但它们都用于离散动作空间问题。今天,我们将讨论另一种研究智能体技能的方式,并考察其在解决连续动作空间问题领域的应用。

1. 主要 CIC 部件

强化学习积极使用算法对智能体进行初步训练,采用自我控制的内部奖励。这种算法可以分为 3 类别:基于竞争力、知识和数据。无监督强化学习基准测试中的测试表明,基于竞争力的算法不及其它类别。

运用竞争力的算法努力令观察到的状态和潜在的技能向量之间的互助信息最大化。这种互助信息是通过鉴别器模型估测的。典型情况下,分类器或回归器模型用作鉴别器。然而,若要达成分类和回归任务的准确性,需要海量的多样化训练数据。在潜在行为数量有限的简单环境中,基于竞争力的方法已经证明了它们的有效性。但在具有许多潜在行为选项的环境中,它们的有效性就会显著降低。

复杂的环境要求技能更加广泛多样。为了处理它们,我们需要一个具有高功率的鉴别器。这一要求与现有鉴别器的有限能力之间的矛盾促使了对比内在控制(CIC)方法的创生。

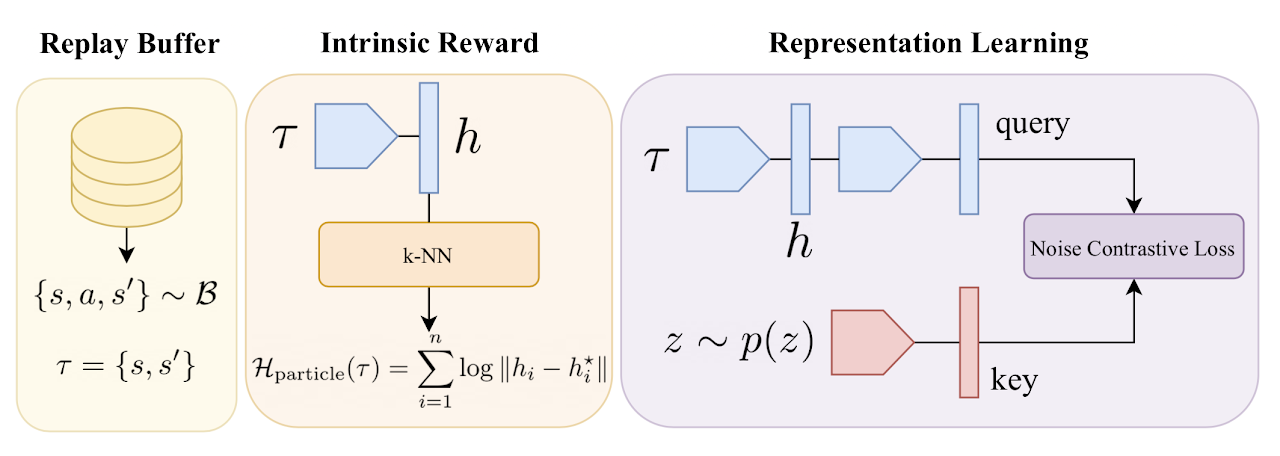

对比内在控制是一种对比密度估测的新方式,近似判别器的条件熵。该方法处理状态和技能向量之间的转换。这允许运用强力技术训练表象,从视觉处理到技能检测。所提议方法令训练智能体在各种环境提高稳定性和效率成为可能。

对比内在控制算法在环境中训练智能体时首先使用反馈,并获取状态和动作的轨迹。然后使用对比预测编码(CPC)执行表象训练,其会激励智能体从状态和动作中提取关键特征。表象的表示要考虑到连续状态之间的依赖关系。

内在奖励在判定哪些行为策略应该最大化方面扮演着重要角色。CIC 将状态之间转换的熵最大化,从而促进了智能体行为的多样性。这允许智能体探索和创建行为策略的多样化。

在生成各种技能和策略之后,CIC 算法使用鉴别器实例化技能表象。鉴别器的靶向是确保状态是可预测和稳定的。以这种方式,智能体学会了在可预测的状况下“使用”技能。

内在奖励激励的探索结合使用技能进行可预测动作,为打造多样化和有效的策略创建了一种平衡方式。

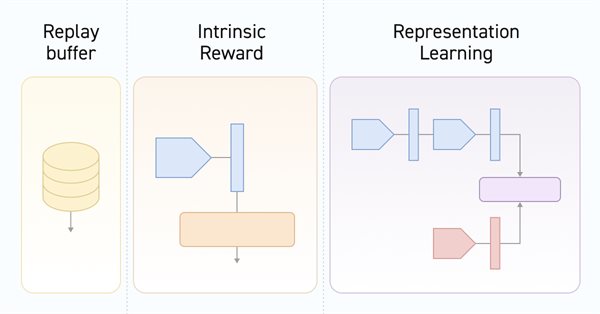

结果就是,对比预测编码算法鼓励智能体检测和学习更广范围的行为策略,同时确保稳定的学习。下面是自定义算法观想图。

在实现期间,我们将更详尽地熟悉该算法。

2. 以 MQL5 实现

在以 MQL5 实现对比预测编码算法之前,我们应该确定一些关键点。首先,将模型训练算法划分为两大阶段:

- 在没有环境外部奖励的情况下训练技能;

- 基于外部奖励训练政策解决给定任务。

其次,在训练过程中,鉴别器学习状态和技能之间转换的对应关系。请记住,我们正在进行的操作恰恰是状态变化,而非针对转换到新状态、或导致该状态的动作的外部奖励。如果我们拿前面讨论的依据相同数据运行的算法进行类比,那么 DIAYN 会基于初始和新模型状态判定技能。与之对比,在 DAD 中,鉴别器基于初始状态和技能预测下一个状态。在该方法中,我们检测转换(初始和后续状态)与智能体所用技能之间的对比误差。同时,形成了状态和技能的潜在表象。正是鉴别器影响了状态编码器的训练,随后由智能体和调度器使用。这反映在我们所用的模型架构当中。这就促使我们将环境状态编码器转移到一个单独模型之中。

2.1模型架构

我们逐渐接近描述所用模型架构的 CreateDescriptions 方法。在方法参数中,我们可以看到指向六个模型架构描述数组的指针。它们的目的稍后讲述。

bool CreateDescriptions(CArrayObj *state_encoder, CArrayObj *actor, CArrayObj *critic, CArrayObj *convolution, CArrayObj *descriminator, CArrayObj *skill_project ) { //--- CLayerDescription *descr; //--- if(!state_encoder) { state_encoder = new CArrayObj(); if(!state_encoder) return false; } if(!actor) { actor = new CArrayObj(); if(!actor) return false; } if(!critic) { critic = new CArrayObj(); if(!critic) return false; } if(!convolution) { convolution = new CArrayObj(); if(!convolution) return false; } if(!descriminator) { descriminator = new CArrayObj(); if(!descriminator) return false; } if(!skill_project) { skill_project = new CArrayObj(); if(!skill_project) return false; }

首先,我们有一个环境状态编码器的模型。我们已开始讨论这个模型的功能。如您所知,我们的环境状态由两个模块组成:历史数据和帐户状态。我们将这两个张量馈送到编码器输入端。该模型的架构会让您想起之前在扮演者模型中所用的源数据预处理模块。

bool CreateDescriptions(CArrayObj *state_encoder, CArrayObj *actor, CArrayObj *critic, CArrayObj *convolution, CArrayObj *descriminator, CArrayObj *skill_project ) { //--- CLayerDescription *descr; //--- if(!state_encoder) { state_encoder = new CArrayObj(); if(!state_encoder) return false; } if(!actor) { actor = new CArrayObj(); if(!actor) return false; } if(!critic) { critic = new CArrayObj(); if(!critic) return false; } if(!convolution) { convolution = new CArrayObj(); if(!convolution) return false; } if(!descriminator) { descriminator = new CArrayObj(); if(!descriminator) return false; } if(!skill_project) { skill_project = new CArrayObj(); if(!skill_project) return false; } //--- State Encoder state_encoder.Clear(); //--- Input layer if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; int prev_count = descr.count = (HistoryBars * BarDescr); descr.activation = None; descr.optimization = ADAM; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBatchNormOCL; descr.count = prev_count; descr.batch = 1000; descr.activation = None; descr.optimization = ADAM; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConvOCL; prev_count = descr.count = prev_count - 1; descr.window = 2; descr.step = 1; descr.window_out = 8; descr.activation = LReLU; descr.optimization = ADAM; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConvOCL; prev_count = descr.count = prev_count; descr.window = 8; descr.step = 8; descr.window_out = 8; descr.activation = LReLU; descr.optimization = ADAM; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = 256; descr.optimization = ADAM; descr.activation = LReLU; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 5 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = 128; descr.activation = LReLU; descr.optimization = ADAM; if(!state_encoder.Add(descr)) { delete descr; return false; } //--- layer 6 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConcatenate; descr.count = NSkills; descr.window = prev_count; descr.step = AccountDescr; descr.optimization = ADAM; descr.activation = SIGMOID; if(!state_encoder.Add(descr)) { delete descr; return false; }

接下来,我们看一下扮演者架构。它仍然是相同的模型。不过,我们排除了放置在单独编码器当中的源数据初步处理模块。但有一处细节。我们添加另一个输入张量来描述正在使用的技能。

此外,我们拒绝使用随机政策,如此便可清晰地区分使用不同技能时扮演者的行为政策。

//--- Actor actor.Clear(); //--- layer 0 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = NSkills; descr.activation = None; descr.optimization = ADAM; if(!actor.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConcatenate; descr.count = LatentCount; descr.window = prev_count; descr.step = NSkills; descr.optimization = ADAM; descr.activation = SIGMOID; if(!actor.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!actor.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!actor.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = NActions; descr.activation = SIGMOID; descr.optimization = ADAM; if(!actor.Add(descr)) { delete descr; return false; }

如常,在扮演者之后,我们描述评论者架构。是时候思考它的功能了。初看,这个问题很简单。评论者估测转移到新状态的预期回报。对于特定转换的奖励取决于所执行的动作,而非所用技能。当然,动作是由扮演者根据指定的技能选择的。但环境并不关心智能体的动机由来。它对智能体的影响做出反应。

另一方面,评论者评估扮演者的政策,并预测后续用此政策的预期奖励。扮演者的政策直接取决于所用技能。因此,在初始数据中,评论者不需要传达环境的当前状态、所用技能、和扮演者选定动作。在此,我们将使用以前曾用过的技术。我们将采用扮演者的隐含状态,它已经考虑了环境状态的描述和所用技能,并添加由扮演者选定的动作。因此,评论者架构保持不变。但扮演者的隐含状态 ID 已更改。

此外,我们放弃了奖励函数的分解。这是一项必要的措施。如前所述,我们将分两个阶段训练模型。在每个阶段,我们都采用不同的奖励函数。我们面临着一个选择。我们也许会用到奖励分解,并在每个阶段训练 2 个不同的评论者。要不然,我们也许会放弃奖励分解,但在两个阶段都使用相同的评论者。我决定走第二条路。

//--- Critic critic.Clear(); //--- Input layer if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = LatentCount; descr.activation = None; descr.optimization = ADAM; if(!critic.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConcatenate; descr.count = LatentCount; descr.window = prev_count; descr.step = NActions; descr.optimization = ADAM; descr.activation = LReLU; if(!critic.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!critic.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!critic.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = NRewards; descr.optimization = ADAM; descr.activation = None; if(!critic.Add(descr)) { delete descr; return false; }

接下来,我们将我们的愿景带入到算法优化。方法作者建议使用转换熵作为内部奖励,使用来自 k-最近邻的颗粒方法,就像我们在上一篇文章中所做的那样。唯一的区别是,作者已训练编码器表象中采用了距小批量的转换距离。为了达成这一点,我们需要在每次更新参数的迭代中针对特定转换包进行编码。我们不能一次性为小批量编码,并在训练中使用此表象。毕竟,每次更新编码器参数后,其结果空间都会发生变化。

但我们知道,即使是随机卷积模型也能给予我们足够的数据来比较两个状态。因此,出于内在奖励的目的,我们将创建一个不可训练的卷积模型。在训练之前,我们首先针对来自经验回放缓冲区的所有转换创建压缩表象。在训练期间,我们将只对所分析转换进行编码。

说到转化,我们指的是两个后续的环境状态。

//--- Convolution convolution.Clear(); //--- Input layer if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = 2 * (HistoryBars * BarDescr + AccountDescr); descr.activation = None; descr.optimization = ADAM; if(!convolution.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = 512; descr.window = prev_count; descr.step = NActions; descr.optimization = ADAM; descr.activation = SIGMOID; if(!convolution.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConvOCL; prev_count = descr.count = 512 / 8; descr.window = 8; descr.step = 8; int prev_wout = descr.window_out = 2; descr.activation = LReLU; descr.optimization = ADAM; if(!convolution.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConvOCL; prev_count = descr.count = (prev_count * prev_wout) / 4; descr.window = 4; descr.step = 4; prev_wout = descr.window_out = 2; descr.activation = LReLU; descr.optimization = ADAM; if(!convolution.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConvOCL; prev_count = descr.count = (prev_count * prev_wout) / 4; descr.window = 4; descr.step = 4; prev_wout = descr.window_out = 2; descr.activation = LReLU; descr.optimization = ADAM; if(!convolution.Add(descr)) { delete descr; return false; } //--- layer 5 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = EmbeddingSize; descr.activation = LReLU; descr.optimization = ADAM; if(!convolution.Add(descr)) { delete descr; return false; }

我们转入鉴别器。在这种情况下,鉴别器将由两个模型组成。一个名为 Discriminator 的模型取两个连续的环境状态作为输入,并返回一些转换的潜在表象。如上所述,该模型只为环境中的转换编码,并未考虑所用技能和所采取的动作。在此,作为初始数据,我们使用编码器的结果,是为两个后续状态。

在模型输出中,我们用 SoftMax 对获得的结果常规化。

//--- Descriminator descriminator.Clear(); //--- layer 0 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = NSkills; descr.activation = None; descr.optimization = ADAM; if(!descriminator.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronConcatenate; descr.count = LatentCount; descr.window = prev_count; descr.step = NSkills; descr.optimization = ADAM; descr.activation = SIGMOID; if(!descriminator.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!descriminator.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!descriminator.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = EmbeddingSize; descr.activation = LReLU; descr.optimization = ADAM; if(!descriminator.Add(descr)) { delete descr; return false; } //--- layer 5 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronSoftMaxOCL; descr.count = EmbeddingSize; descr.step = 1; descr.optimization = ADAM; if(!descriminator.Add(descr)) { delete descr; return false; }

鉴别器的第二个部件是表现所用技能潜在表象的模型。从模型的功能来看,后续它只接收所用技能作为输入,返回其张量形式的压缩表象,类似于转换的潜在表象(鉴别器模型的结果)。

这两个模型的结果将是对比内在控制的数据。相应地,我们也在模型的输出中使用 SoftMax。

//--- Skills project skill_project.Clear(); //--- layer 0 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; prev_count = descr.count = NSkills; descr.activation = None; descr.optimization = ADAM; if(!skill_project.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.optimization = ADAM; descr.activation = SIGMOID; if(!skill_project.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!skill_project.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!skill_project.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = EmbeddingSize; descr.activation = LReLU; descr.optimization = ADAM; if(!skill_project.Add(descr)) { delete descr; return false; } //--- layer 5 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronSoftMaxOCL; descr.count = EmbeddingSize; descr.step = 1; descr.optimization = ADAM; if(!skill_project.Add(descr)) { delete descr; return false; } //--- return true; }

尽管最后两个模型使用不同的初始数据,但它们具有相当类似的功能。这就是为什么我们为它们使用了类似的架构方案。

如您所见,我们已经完成了描述所用模型架构方案的方法。但它没有描述调度器的架构。我们不会在技能训练阶段使用调度器。展望未来,我要说我们将在第一个训练阶段随机生成技能表象。这将允许我们的扮演者能够更好地学习不同的行为政策。但我们将用调度器来教导使用技能的政策,从而达成预期目标。因此,调度器模型已移至单独的 SchedulerDescriptions 方法。

bool SchedulerDescriptions(CArrayObj *scheduler) { //--- Scheduller if(!scheduler) { scheduler = new CArrayObj(); if(!scheduler) return false; } scheduler.Clear(); //--- CLayerDescription *descr = NULL; //--- layer 0 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; int prev_count = descr.count = NSkills; descr.activation = None; descr.optimization = ADAM; if(!scheduler.Add(descr)) { delete descr; return false; } //--- layer 1 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.window = prev_count; descr.optimization = ADAM; descr.activation = SIGMOID; if(!scheduler.Add(descr)) { delete descr; return false; } //--- layer 2 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!scheduler.Add(descr)) { delete descr; return false; } //--- layer 3 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = LatentCount; descr.activation = LReLU; descr.optimization = ADAM; if(!scheduler.Add(descr)) { delete descr; return false; } //--- layer 4 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronBaseOCL; descr.count = NSkills; descr.activation = LReLU; descr.optimization = ADAM; if(!scheduler.Add(descr)) { delete descr; return false; } //--- layer 5 if(!(descr = new CLayerDescription())) return false; descr.type = defNeuronSoftMaxOCL; descr.count = NSkills; descr.step = 1; descr.optimization = ADAM; if(!scheduler.Add(descr)) { delete descr; return false; } //--- return true; }

据其,我们完成了描述所用模型架构方案的工作,并转入为它们的操作构建算法。

2.2训练样本采集 EA

如前,我们将在训练模型时用到若干程序。我们第一个用到 “...\CIC\Research.mq5” EA 来收集训练样本。数据收集过程本身没有变化。我们需要始终如一地使用多个模型来形成扮演者动作。但首先我们应该在 EA 的 OnInit 初始化方法中创建它们。

在方法主体中,我们像往常一样初始化所有必要的指标。

int OnInit() { //--- if(!Symb.Name(_Symbol)) return INIT_FAILED; Symb.Refresh(); //--- if(!RSI.Create(Symb.Name(), TimeFrame, RSIPeriod, RSIPrice)) return INIT_FAILED; //--- if(!CCI.Create(Symb.Name(), TimeFrame, CCIPeriod, CCIPrice)) return INIT_FAILED; //--- if(!ATR.Create(Symb.Name(), TimeFrame, ATRPeriod)) return INIT_FAILED; //--- if(!MACD.Create(Symb.Name(), TimeFrame, FastPeriod, SlowPeriod, SignalPeriod, MACDPrice)) return INIT_FAILED; if(!RSI.BufferResize(HistoryBars) || !CCI.BufferResize(HistoryBars) || !ATR.BufferResize(HistoryBars) || !MACD.BufferResize(HistoryBars)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); return INIT_FAILED; } //--- if(!Trade.SetTypeFillingBySymbol(Symb.Name())) return INIT_FAILED;

接下来,加载编码器和扮演者模型。如果没有预训练模型,我们将生成随机模型。

//--- load models float temp; if(!Encoder.Load(FileName + "Enc.nnw", temp, temp, temp, dtStudied, true) || !Actor.Load(FileName + "Act.nnw", temp, temp, temp, dtStudied, true)) { CArrayObj *actor = new CArrayObj(); CArrayObj *encoder = new CArrayObj(); CArrayObj *descr = new CArrayObj(); if(!CreateDescriptions(encoder,actor, descr,descr,descr,descr)) { delete encoder; delete actor; delete descr; return INIT_FAILED; } if(!Encoder.Create(encoder) || !Actor.Create(actor)) { delete encoder; delete actor; delete descr; return INIT_FAILED; } delete encoder; delete actor; delete descr; //--- }

调度器的情况略有不同。我们需要收集两个训练阶段的训练样本数据。在第一阶段使用调度器模型也许在一定程度上限制了扮演者的动作空间。使用随机生成的技能张量在许多方面类似于使用具有随机参数的调度器。同时,它比模型的直接验算迅捷很多倍。

同时,建议在训练的第二阶段使用预先训练的调度器。这不仅可以收集其政策动作领域的数据,还可以估测训练结果。

因此,我们尝试加载预训练调度器模型,并按用法标志将操作结果写入随机技能向量。

bRandomSkills = (!Scheduler.Load(FileName + "Sch.nnw", temp, temp, temp, dtStudied, true));

接着,我们将所有用到的模型转移到单个 OpenCL 关联环境之中。

COpenCLMy *opcl = Encoder.GetOpenCL();

Actor.SetOpenCL(opcl);

if(!bRandomSkills)

Scheduler.SetOpenCL(opcl);

检查模型的合规性。

Actor.getResults(ActorResult); if(ActorResult.Size() != NActions) { PrintFormat("The scope of the actor does not match the actions count (%d <> %d)", NActions, Result.Total()); return INIT_FAILED; } //--- Encoder.GetLayerOutput(0, Result); if(Result.Total() != (HistoryBars * BarDescr)) { PrintFormat("Input size of State Encoder doesn't match state description (%d <> %d)", Result.Total(), (HistoryBars * BarDescr)); return INIT_FAILED; } //--- vector<float> EncoderResults; Actor.GetLayerOutput(0,Result); Encoder.getResults(EncoderResults); if(Result.Total() != int(EncoderResults.Size())) { PrintFormat("Input size of Actor doesn't match Encoder outputs (%d <> %d)", Result.Total(), EncoderResults.Size()); return INIT_FAILED; } //--- if(!bRandomSkills) { Scheduler.GetLayerOutput(0,Result); if(Result.Total() != int(EncoderResults.Size())) { PrintFormat("Input size of Scheduler doesn't match Encoder outputs (%d <> %d)", Result.Total(), EncoderResults.Size()); return INIT_FAILED; } }

初始化变量。

//--- PrevBalance = AccountInfoDouble(ACCOUNT_BALANCE); PrevEquity = AccountInfoDouble(ACCOUNT_EQUITY); //--- return(INIT_SUCCEEDED); }

在 OnTick 方法中收集数据。如前,所有操作仅在开立新柱线时运作。

void OnTick() { //--- if(!IsNewBar()) return;

此处,我们首先收集历史数据和帐户数据。该过程已转移,与前面讨论的算法没有变化。我不会在此赘述。我们立即转入安排模型的直接验算。我们首先调用编码器。

//--- Encoder if(!Encoder.feedForward(GetPointer(bState), 1, false, GetPointer(bAccount))) return;

然后,我们检查随机技能向量用法标志。如果我们之前设法加载了调度器模型,那么我们会按顺序调用调度器和扮演者。

//--- Scheduler & Actor if(!bRandomSkills) { if(!Scheduler.feedForward((CNet *)GetPointer(Encoder),-1,NULL,-1) || !Actor.feedForward(GetPointer(Encoder),-1,GetPointer(Scheduler),-1)) return; }

否则,我们首先生成一个随机技能张量。不要忘记调用 SoftMax 函数对其进行常规化,因为这些是使用独立技能的概率向量。最后,调用扮演者。

else { vector<float> skills = vector<float>::Zeros(NSkills); for(int i = 0; i < NSkills; i++) skills[i] = (float)((double)MathRand() / 32767.0); skills.Activation(skills,AF_SOFTMAX); bSkills.AssignArray(skills); if(bSkills.GetIndex() >= 0 && !bSkills.BufferWrite()) return; if(!Actor.feedForward(GetPointer(Encoder),-1,(CBufferFloat *)GetPointer(bSkills))) return; }

模型的直接验算结果就是,我们在扮演者输出处得到了一个确定的动作张量。随机政策的拒绝会导致在初始数据和所选动作之间扮演者严格关联。出于环境研究目的,我们将在生成的动作向量中加入一点噪声。

PrevBalance = sState.account[0]; PrevEquity = sState.account[1]; //--- vector<float> temp; Actor.getResults(temp); //--- for(ulong i = 0; i < temp.Size(); i++) { float rnd = ((float)MathRand() / 32767.0f - 0.5f) * 0.1f; temp[i] += rnd; } temp.Clip(0.0f,1.0f); ActorResult = temp;

这些操作后,我们执行扮演者动作,并将结果保存到经验回放缓冲区之中。

请记住,我们保存的数据集没有技能标识符。我们需要从环境中转换和奖励来训练模型,同时我们将在训练期间生成各种技能识别向量。这将令我们能够数倍扩展训练集,而无需与环境进行额外的交互。

其余方法代码以及,整个 EA 也好,均保持不变,并从以前研究过的类似 EA 搬运而来。我们现在就不详细分析了。您可从附件中找到它。

2.3技能训练

模型训练的第一阶段 — 学习技能 — 安排在 “...\CIC\Pretrain.mq5” EA 当中。在许多方面,它的构建是据前面所讨论的 “Study.mq5” EA 类比而来,同时考虑了正在研讨的对比内在控制算法的细节。

EA 初始化 OnInit 的算法,与之前讨论过的类似 EA 的同名方法没有区别。我们只讨论所用的模型清单。在此,我们看到编码器、扮演者、两个评论者、随机卷积编码器、和鉴别器模型。但只有一个编码器模型是针对那个。

我们需要两个编码器模型来为已分析及后续环境状态编码,这些状态由鉴别器使用。

不过,我们不用扮演者和评论者的目标模型,因为在这个阶段,我们正在教导扮演者在特定环境状态、特定技能的影响下执行可单独的动作。我们不寻求为各种技能积累内在奖励。我们在每时每刻都最大限度地发挥它的作用。

int OnInit() { //--- ....... ....... //--- load models float temp; if(!Encoder.Load(FileName + "Enc.nnw", temp, temp, temp, dtStudied, true) || !Actor.Load(FileName + "Act.nnw", temp, temp, temp, dtStudied, true) || !Critic1.Load(FileName + "Crt1.nnw", temp, temp, temp, dtStudied, true) || !Critic2.Load(FileName + "Crt2.nnw", temp, temp, temp, dtStudied, true) || !Descriminator.Load(FileName + "Des.nnw", temp, temp, temp, dtStudied, true) || !SkillProject.Load(FileName + "Skp.nnw", temp, temp, temp, dtStudied, true) || !Convolution.Load(FileName + "CNN.nnw", temp, temp, temp, dtStudied, true) || !TargetEncoder.Load(FileName + "Enc.nnw", temp, temp, temp, dtStudied, true)) { CArrayObj *encoder = new CArrayObj(); CArrayObj *actor = new CArrayObj(); CArrayObj *critic = new CArrayObj(); CArrayObj *descrim = new CArrayObj(); CArrayObj *convolution = new CArrayObj(); CArrayObj *skill_poject = new CArrayObj(); if(!CreateDescriptions(encoder,actor, critic, convolution,descrim,skill_poject)) { delete encoder; delete actor; delete critic; delete descrim; delete convolution; delete skill_poject; return INIT_FAILED; } if(!Encoder.Create(encoder) || !Actor.Create(actor) || !Critic1.Create(critic) || !Critic2.Create(critic) || !Descriminator.Create(descrim) || !SkillProject.Create(skill_poject) || !Convolution.Create(convolution)) { delete encoder; delete actor; delete critic; delete descrim; delete convolution; delete skill_poject; return INIT_FAILED; } if(!TargetEncoder.Create(encoder)) { delete encoder; delete actor; delete critic; delete descrim; delete convolution; delete skill_poject; return INIT_FAILED; } delete encoder; delete actor; delete critic; delete descrim; delete convolution; delete skill_poject; //--- TargetEncoder.WeightsUpdate(GetPointer(Encoder), 1.0f); } //--- OpenCL = Actor.GetOpenCL(); Encoder.SetOpenCL(OpenCL); Critic1.SetOpenCL(OpenCL); Critic2.SetOpenCL(OpenCL); TargetEncoder.SetOpenCL(OpenCL); Descriminator.SetOpenCL(OpenCL); SkillProject.SetOpenCL(OpenCL); Convolution.SetOpenCL(OpenCL); //--- ........ ........ //--- return(INIT_SUCCEEDED); }

训练模型的实际过程安排在 Train 方法当中。

与上一篇文章类似,我们在方法开始时针对经验回放缓冲区中可用状态之间的所有转换进行编码。构造过程的算法雷同。不过,它有自己的细微差别。我们为转换编码。因此,我们提供两个连续状态的张量作为随机编码器的输入,而不考虑正在执行的动作。

此外,我们在这个阶段只使用内部奖励。这意味着我们排除了外部环境奖励的过程。

void Train(void) { int total_tr = ArraySize(Buffer); uint ticks = GetTickCount(); //--- int total_states = Buffer[0].Total - 1; for(int i = 1; i < total_tr; i++) total_states += Buffer[i].Total - 1; vector<float> temp; Convolution.getResults(temp); matrix<float> state_embedding = matrix<float>::Zeros(total_states,temp.Size()); int state = 0; for(int tr = 0; tr < total_tr; tr++) { for(int st = 0; st < Buffer[tr].Total - 1; st++) { State.AssignArray(Buffer[tr].States[st].state); float PrevBalance = Buffer[tr].States[MathMax(st,0)].account[0]; float PrevEquity = Buffer[tr].States[MathMax(st,0)].account[1]; State.Add((Buffer[tr].States[st].account[0] - PrevBalance) / PrevBalance); State.Add(Buffer[tr].States[st].account[1] / PrevBalance); State.Add((Buffer[tr].States[st].account[1] - PrevEquity) / PrevEquity); State.Add(Buffer[tr].States[st].account[2]); State.Add(Buffer[tr].States[st].account[3]); State.Add(Buffer[tr].States[st].account[4] / PrevBalance); State.Add(Buffer[tr].States[st].account[5] / PrevBalance); State.Add(Buffer[tr].States[st].account[6] / PrevBalance); double x = (double)Buffer[tr].States[st].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_MN1); State.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_W1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_D1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); //--- State.AddArray(Buffer[tr].States[st + 1].state); State.Add((Buffer[tr].States[st + 1].account[0] - PrevBalance) / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[1] / PrevBalance); State.Add((Buffer[tr].States[st + 1].account[1] - PrevEquity) / PrevEquity); State.Add(Buffer[tr].States[st + 1].account[2]); State.Add(Buffer[tr].States[st + 1].account[3]); State.Add(Buffer[tr].States[st + 1].account[4] / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[5] / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[6] / PrevBalance); x = (double)Buffer[tr].States[st + 1].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_MN1); State.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_W1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_D1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); if(!Convolution.feedForward(GetPointer(State),1,false,NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); ExpertRemove(); return; } Convolution.getResults(temp); state_embedding.Row(temp,state); state++; if(GetTickCount() - ticks > 500) { string str = StringFormat("%-15s %6.2f%%", "Embedding ", state * 100.0 / (double)(total_states)); Comment(str); ticks = GetTickCount(); } } } if(state != total_states) { state_embedding.Reshape(state,state_embedding.Cols()); total_states = state; }

接下来,声明局部变量。

vector<float> reward = vector<float>::Zeros(NRewards); vector<float> rewards1 = reward, rewards2 = reward; int bar = (HistoryBars - 1) * BarDescr;

安排模型训练循环。在循环主体中,我们和以前一样,从经验回放缓冲区中随机选择轨迹和已分析状态。

for(int iter = 0; (iter < Iterations && !IsStopped()); iter ++) { int tr = (int)((MathRand() / 32767.0) * (total_tr - 1)); int i = (int)((MathRand() * MathRand() / MathPow(32767, 2)) * (Buffer[tr].Total - 2)); if(i < 0) { iter--; continue; }

使用抽取的状态数据,我们形成模型的初始数据张量。

//--- State State.AssignArray(Buffer[tr].States[i].state); float PrevBalance = Buffer[tr].States[MathMax(i - 1, 0)].account[0]; float PrevEquity = Buffer[tr].States[MathMax(i - 1, 0)].account[1]; Account.Clear(); Account.Add((Buffer[tr].States[i].account[0] - PrevBalance) / PrevBalance); Account.Add(Buffer[tr].States[i].account[1] / PrevBalance); Account.Add((Buffer[tr].States[i].account[1] - PrevEquity) / PrevEquity); Account.Add(Buffer[tr].States[i].account[2]); Account.Add(Buffer[tr].States[i].account[3]); Account.Add(Buffer[tr].States[i].account[4] / PrevBalance); Account.Add(Buffer[tr].States[i].account[5] / PrevBalance); Account.Add(Buffer[tr].States[i].account[6] / PrevBalance); double x = (double)Buffer[tr].States[i].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_MN1); Account.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_W1); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_D1); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); if(Account.GetIndex() >= 0) Account.BufferWrite();

在此,我们形成所用技能的随机张量。

//--- Skills vector<float> skills = vector<float>::Zeros(NSkills); for(int sk = 0; sk < NSkills; sk++) skills[sk] = (float)((double)MathRand() / 32767.0); skills.Activation(skills,AF_SOFTMAX); Skills.AssignArray(skills); if(Skills.GetIndex() >= 0 && !Skills.BufferWrite()) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

我们首先将生成的初始数据提交到编码器输入。

//--- Encoder State if(!Encoder.feedForward(GetPointer(State), 1, false, GetPointer(Account))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

然后我们运作扮演者的直接验算。

//--- Actor if(!Actor.feedForward(GetPointer(Encoder), -1, GetPointer(Skills))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

基于生成的动作张量,我们形成一个预测的后续状态。依据历史价格走势数据我们并无问题。我们简单地从经验回放缓冲区中取出它们。为了计算预测帐户状态,我们将创建 ForecastAccount 方法,稍后再研究其算法。

//--- Next State TargetState.AssignArray(Buffer[tr].States[i + 1].state); double cl_op = Buffer[tr].States[i + 1].state[bar]; double prof_1l = SymbolInfoDouble(_Symbol, SYMBOL_TRADE_TICK_VALUE_PROFIT) * cl_op / SymbolInfoDouble(_Symbol, SYMBOL_POINT); Actor.getResults(Result); vector<float> forecast = ForecastAccount(Buffer[tr].States[i].account,Result,prof_1l, Buffer[tr].States[i + 1].account[7]); TargetAccount.AssignArray(forecast); if(TargetAccount.GetIndex() >= 0 && !TargetAccount.BufferWrite()) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

执行贯穿目标编码器的直接验算,来获得后续状态的潜在表象。

if(!TargetEncoder.feedForward(GetPointer(TargetState), 1, false, GetPointer(TargetAccount))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

在这个阶段,我们有一个后续两种环境状态的潜在表象。我们能够获得转换表象向量。我们在此得到技能表象向量。

//--- Descriminator if(!Descriminator.feedForward(GetPointer(Encoder),-1,GetPointer(TargetEncoder),-1) || !SkillProject.feedForward(GetPointer(Skills),1,false,NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

两个对比结果向量的比较结果作为我们内部奖励的第一部分。最大化此奖励会鼓励扮演者训练易于分离和可预测的技能,这些技能很容易映射到环境中的独立状态转换。

Descriminator.getResults(rewards1); SkillProject.getResults(rewards2); float norm1 = rewards1.Norm(VECTOR_NORM_P,2); float norm2 = rewards2.Norm(VECTOR_NORM_P,2); reward[0] = (rewards1 / norm1).Dot(rewards2 / norm2);

我们立即更新鉴别器模型的参数。在算法不会进一步复杂化的情况下,我们只需训练鉴别器模型来近似技能的压缩表象。技能预测模型经过训练,以近似于压缩的转换表象。

同时,我们训练编码器以一种可由某种技能识别的方式表示环境状态。我们根据从鉴别器接收到的误差梯度来训练编码器,类似于在连续的动作空间中的扮演者和评论者。

Result.AssignArray(rewards2); if(!Descriminator.backProp(Result,GetPointer(TargetEncoder)) || !Encoder.backPropGradient(GetPointer(Account),GetPointer(Gradient))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } Result.AssignArray(rewards1); if(!SkillProject.backProp(Result,(CNet *)NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

我们内部奖励函数的第二个部件是针对当前缺乏持仓的惩罚。我们从账户的预测状态中获取有关交易存在的信息。

if(forecast[3] == 0.0f && forecast[4] == 0.f) reward[0] -= Buffer[tr].States[i + 1].state[bar + 6] / PrevBalance;

我们内在奖励的第三个部件是转换熵,它刺激扮演者去学习各种行为,并掌握大量技能。为了获得转换熵,我们首先在随机编码器空间中获得转换的压缩表象,并在 KNNReward 方法中确定 k-最近邻。

State.AddArray(GetPointer(Account)); State.AddArray(GetPointer(TargetState)); State.AddArray(GetPointer(TargetAccount)); if(!Convolution.feedForward(GetPointer(State),1,false,NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } Convolution.getResults(rewards1); reward[0] += KNNReward(7,rewards1,state_embedding);

我们将得到的转换熵结果加到我们的内部奖励之中。

现在我们已经确立了我们复杂的内在奖励的全部含义,我们可以转入训练评论者和扮演者。我们早前已运作了扮演者的前向验算。我们现在调用两个评论者的直接验算。

Result.AssignArray(reward); //--- if(!Critic1.feedForward(GetPointer(Actor), LatentLayer, GetPointer(Actor),-1) || !Critic2.feedForward(GetPointer(Actor), LatentLayer, GetPointer(Actor),-1)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

我们将用最小误差评论者训练扮演者。检查评论者的误差移动均值。首先,我们按最小误差运作评论者的反向验算。接下来是扮演者的反向验算。最后一个阶段是评论者的反向验算,依据预测的扮演者动作成本的最大平均误差。

if(Critic1.getRecentAverageError() <= Critic2.getRecentAverageError()) { if(!Critic1.backProp(Result, GetPointer(Actor)) || !Actor.backPropGradient(GetPointer(Skills), GetPointer(Gradient), -1) || !Critic2.backProp(Result, GetPointer(Actor))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } } else { if(!Critic2.backProp(Result, GetPointer(Actor)) || !Actor.backPropGradient(GetPointer(Skills), GetPointer(Gradient), -1) || !Critic1.backProp(Result, GetPointer(Actor))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } }

接下来,我们更新目标编码器的参数,并通知用户有关模型训练的状态。

//--- Update Target Nets TargetEncoder.WeightsUpdate(GetPointer(Encoder), Tau); //--- if(GetTickCount() - ticks > 500) { string str = StringFormat("%-20s %5.2f%% -> Error %15.8f\n", "Critic1", iter * 100.0 / (double)(Iterations), Critic1.getRecentAverageError()); str += StringFormat("%-20s %5.2f%% -> Error %15.8f\n", "Critic2", iter * 100.0 / (double)(Iterations), Critic2.getRecentAverageError()); Comment(str); ticks = GetTickCount(); } }

完成所有训练循环迭代后,我们清除图表注释字段,并启动程序关闭过程。

Comment(""); //--- PrintFormat("%s -> %d -> %-20s %10.7f", __FUNCTION__, __LINE__, "Critic1", Critic1.getRecentAverageError()); PrintFormat("%s -> %d -> %-20s %10.7f", __FUNCTION__, __LINE__, "Critic2", Critic2.getRecentAverageError()); ExpertRemove(); //--- }

为了得到训练的概貌,我们研究另一种生成 ForecastAccount 帐户预测状态的方法。在参数中,该方法接收指向前一个账户状态的指针、一个动作张量、下一根柱线的 1-手多头持仓的利润值、以及下一根柱线的时间戳。每 1-手的盈利大小是在调用该方法之前,基于后续蜡烛数据判定的。这种操作只能基于价格走势历史数据离线训练。

我们将首先在方法主体中做一些准备工作。在此,我们声明局部变量,并加载有关该工具的一些信息。应当注意的是,由于我们没有在训练数据中的任何位置指定金融产品,因此我们将采用有关图表金融产品的数据。因此,为了正确训练,有必要在所需的金融产品图表上启动学习 EA。

vector<float> ForecastAccount(float &prev_account[], CBufferFloat *actions,double prof_1l,float time_label) { vector<float> account; vector<float> act; double min_lot = SymbolInfoDouble(_Symbol,SYMBOL_VOLUME_MIN); double step_lot = SymbolInfoDouble(_Symbol,SYMBOL_VOLUME_STEP); double stops = MathMax(SymbolInfoInteger(_Symbol,SYMBOL_TRADE_STOPS_LEVEL), 1) * Point(); double margin_buy,margin_sell; if(!OrderCalcMargin(ORDER_TYPE_BUY,_Symbol,1.0,SymbolInfoDouble(_Symbol,SYMBOL_ASK),margin_buy) || !OrderCalcMargin(ORDER_TYPE_SELL,_Symbol,1.0,SymbolInfoDouble(_Symbol,SYMBOL_BID),margin_sell)) return vector<float>::Zeros(prev_account.Size());

为方便起见,我们把参数中获得的数据转移到向量。

actions.GetData(act); account.Assign(prev_account);

此后,我们将调整智能体的动作,仅在一个方向上开仓,以便达到所声明交易量的差异。之后,检查操作资金是否充足。如果账户资金不足,重置交易量为零。

if(act[0] >= act[3]) { act[0] -= act[3]; act[3] = 0; if(act[0]*margin_buy >= MathMin(account[0],account[1])) act[0] = 0; } else { act[3] -= act[0]; act[0] = 0; if(act[3]*margin_sell >= MathMin(account[0],account[1])) act[3] = 0; }

接下来是解码接收动作的操作。该过程由类比构建,依据的算法是 EA 中执行收集训练数据的动作。仅替换执行的动作,我们更改帐户状态描述的相应元素。首先,我们看一下多头持仓的要素。如果交易量等于 “0” 或止损水平小于金融产品的最小保证金,则这组参数表示交易的平仓,前提是有一笔持仓。我们在其方向上重置当前持仓规模,同时将累计的盈亏加到当前余额之中。

//--- buy control if(act[0] < min_lot || (act[1] * MaxTP * Point()) <= stops || (act[2] * MaxSL * Point()) <= stops) { account[0] += account[4]; account[2] = 0; account[4] = 0; }

在开仓或持仓的情况下,我们常规化交易量,并核对结果交易量与之前开仓的交易量。如果持仓大于扮演者提供的那一笔,则我们按提供量与平仓量的比例切分累积盈亏。将平仓量的盈亏加到余额之中。将差额留在累计盈利字段。将仓位交易量更改为扮演者建议的仓位交易量。此外,将转换到下一个环境状态的盈利/亏损加到累积量中。

else { double buy_lot = min_lot + MathRound((double)(act[0] - min_lot) / step_lot) * step_lot; if(account[2] > buy_lot) { float koef = (float)buy_lot / account[2]; account[0] += account[4] * (1 - koef); account[4] *= koef; } account[2] = (float)buy_lot; account[4] += float(buy_lot * prof_1l); }

空头持仓重复这些操作。

//--- sell control if(act[3] < min_lot || (act[4] * MaxTP * Point()) <= stops || (act[5] * MaxSL * Point()) <= stops) { account[0] += account[5]; account[3] = 0; account[5] = 0; } else { double sell_lot = min_lot + MathRound((double)(act[3] - min_lot) / step_lot) * step_lot; if(account[3] > sell_lot) { float koef = float(sell_lot / account[3]); account[0] += account[5] * (1 - koef); account[5] *= koef; } account[3] = float(sell_lot); account[5] -= float(sell_lot * prof_1l); }

多头和空头持仓的累计盈利构成账户的累计盈利。累计盈利和余额的总和给出净值参数。

account[6] = account[4] + account[5]; account[1] = account[0] + account[6];

使用获取的值形成描述帐户状态的向量,并将其返回给调用程序。

vector<float> result = vector<float>::Zeros(AccountDescr); result[0] = (account[0] - prev_account[0]) / prev_account[0]; result[1] = account[1] / prev_account[0]; result[2] = (account[1] - prev_account[1]) / prev_account[1]; result[3] = account[2]; result[4] = account[3]; result[5] = account[4] / prev_account[0]; result[6] = account[5] / prev_account[0]; result[7] = account[6] / prev_account[0]; double x = (double)time_label / (double)(D'2024.01.01' - D'2023.01.01'); result[8] = (float)MathSin(2.0 * M_PI * x); x = (double)time_label / (double)PeriodSeconds(PERIOD_MN1); result[9] = (float)MathCos(2.0 * M_PI * x); x = (double)time_label / (double)PeriodSeconds(PERIOD_W1); result[10] = (float)MathSin(2.0 * M_PI * x); x = (double)time_label / (double)PeriodSeconds(PERIOD_D1); result[11] = (float)MathSin(2.0 * M_PI * x); //--- return result return result; }

训练过程完成后,所有模型都保存在 EA 的 OnDeinit 逆初始化方法之中。

//+------------------------------------------------------------------+ //| Expert deinitialization function | //+------------------------------------------------------------------+ void OnDeinit(const int reason) { //--- TargetEncoder.WeightsUpdate(GetPointer(Encoder), Tau); Actor.Save(FileName + "Act.nnw", 0, 0, 0, TimeCurrent(), true); TargetEncoder.Save(FileName + "Enc.nnw", Critic1.getRecentAverageError(), 0, 0, TimeCurrent(), true); Critic1.Save(FileName + "Crt1.nnw", Critic1.getRecentAverageError(), 0, 0, TimeCurrent(), true); Critic2.Save(FileName + "Crt2.nnw", Critic2.getRecentAverageError(), 0, 0, TimeCurrent(), true); Convolution.Save(FileName + "CNN.nnw", 0, 0, 0, TimeCurrent(), true); Descriminator.Save(FileName + "Des.nnw", 0, 0, 0, TimeCurrent(), true); SkillProject.Save(FileName + "Skp.nnw", 0, 0, 0, TimeCurrent(), true); delete Result; }

我们针对 EA 的工作到此结束,其在没有外部奖励的情况下初步训练扮演者技能。完整的 EA 代码可在附件中找到。在那里,您还可以找到本文中用到的所有程序的完整代码。

2.4优调 EA

模型训练遵照训练调度器结束,调度器生成所用技能的向量,从而控制扮演者的动作。

调度器的政策经过训练,可以最大化外部奖励。我们在 “...\CIC\Finetune.mq5” EA 中安排训练。EA 的构建与前一个类似,但也有一些细微差别。为了让 EA 正常工作,我们需要预先训练的编码器、扮演者和评论者模型。我们还要用到指定模型的目标副本。

//+------------------------------------------------------------------+ //| Expert initialization function | //+------------------------------------------------------------------+ int OnInit() { //--- ResetLastError(); if(!LoadTotalBase()) { PrintFormat("Error of load study data: %d", GetLastError()); return INIT_FAILED; } //--- load models float temp; if(!Encoder.Load(FileName + "Enc.nnw", temp, temp, temp, dtStudied, true) || !Actor.Load(FileName + "Act.nnw", temp, temp, temp, dtStudied, true) || !Critic1.Load(FileName + "Crt1.nnw", temp, temp, temp, dtStudied, true) || !Critic2.Load(FileName + "Crt2.nnw", temp, temp, temp, dtStudied, true) || !Convolution.Load(FileName + "CNN.nnw", temp, temp, temp, dtStudied, true) || !TargetEncoder.Load(FileName + "Enc.nnw", temp, temp, temp, dtStudied, true) || !TargetActor.Load(FileName + "Act.nnw", temp, temp, temp, dtStudied, true) || !TargetCritic1.Load(FileName + "Crt1.nnw", temp, temp, temp, dtStudied, true) || !TargetCritic2.Load(FileName + "Crt2.nnw", temp, temp, temp, dtStudied, true)) { Print("No pretrained models found"); return INIT_FAILED; }

此外,我们还加载了一个随机卷积编码器模型。但我们不加载鉴别器模型。在这个阶段,我们仅使用外部奖励。扮演者的行为政策已在前一阶段研究过了。现在我们必须学习调度器的顶级策略。

因此,在加载预训练模型之后,我们尝试加载调度器模型。如果一个都找不到,那么这次我们创建一个新模型,并用随机参数对其进行初始化。

if(!Scheduler.Load(FileName + "Sch.nnw", temp, temp, temp, dtStudied, true)) { CArrayObj *descr = new CArrayObj(); if(!SchedulerDescriptions(descr) || !Scheduler.Create(descr)) { delete descr; return INIT_FAILED; } delete descr; }

接着,我们将所有模型转移到单个 OpenCL 关联环境之中,并禁用扮演者和编码器训练模式。

OpenCL = Actor.GetOpenCL(); Encoder.SetOpenCL(OpenCL); Critic1.SetOpenCL(OpenCL); Critic2.SetOpenCL(OpenCL); TargetEncoder.SetOpenCL(OpenCL); TargetActor.SetOpenCL(OpenCL); TargetCritic1.SetOpenCL(OpenCL); TargetCritic2.SetOpenCL(OpenCL); Scheduler.SetOpenCL(OpenCL); Convolution.SetOpenCL(OpenCL); //--- Actor.TrainMode(false); Encoder.TrainMode(false);

在初始化方法的最后,我们检查模型架构的一致性,并生成训练开始事件。

vector<float> ActorResult; Actor.getResults(ActorResult); if(ActorResult.Size() != NActions) { PrintFormat("The scope of the actor does not match the actions count (%d <> %d)", NActions, Result.Total()); return INIT_FAILED; } //--- Encoder.GetLayerOutput(0, Result); if(Result.Total() != (HistoryBars * BarDescr)) { PrintFormat("Input size of State Encoder doesn't match state description (%d <> %d)", Result.Total(), (HistoryBars * BarDescr)); return INIT_FAILED; } //--- vector<float> EncoderResults; Actor.GetLayerOutput(0,Result); Encoder.getResults(EncoderResults); if(Result.Total() != int(EncoderResults.Size())) { PrintFormat("Input size of Actor doesn't match Encoder outputs (%d <> %d)", Result.Total(), EncoderResults.Size()); return INIT_FAILED; } //--- Actor.GetLayerOutput(LatentLayer, Result); int latent_state = Result.Total(); Critic1.GetLayerOutput(0, Result); if(Result.Total() != latent_state) { PrintFormat("Input size of Critic doesn't match latent state Actor (%d <> %d)", Result.Total(), latent_state); return INIT_FAILED; } //--- Gradient.BufferInit(AccountDescr, 0); //--- if(!EventChartCustom(ChartID(), 1, 0, 0, "Init")) { PrintFormat("Error of create study event: %d", GetLastError()); return INIT_FAILED; } //--- return(INIT_SUCCEEDED); }

在 EA 的逆初始化方法当中,我们只保存评论者和调度器模型。

//+------------------------------------------------------------------+ //| Expert deinitialization function | //+------------------------------------------------------------------+ void OnDeinit(const int reason) { //--- TargetCritic1.WeightsUpdate(GetPointer(Critic1), Tau); TargetCritic2.WeightsUpdate(GetPointer(Critic2), Tau); TargetCritic1.Save(FileName + "Crt1.nnw", Critic1.getRecentAverageError(), 0, 0, TimeCurrent(), true); TargetCritic2.Save(FileName + "Crt2.nnw", Critic2.getRecentAverageError(), 0, 0, TimeCurrent(), true); Scheduler.Save(FileName + "Sch.nnw", 0, 0, 0, TimeCurrent(), true); delete Result; }

我不认为有人质疑训练调度器的必要性。但是更新评论者参数,并修复扮演者参数的问题可能值得解释。在上一步中,我们根据所用的技能训练了扮演者的政策。在这个阶段,我们学习管理技能。因此,我们修复扮演者的参数,并训练调度器来控制它。

另一个问题涉及评论者。在技能训练阶段,我们仅用内部奖励,旨在训练扮演者的各种技能。当然,评论者已经在扮演者的行为及其对内部奖励的影响之间建立了依赖关系。但我们在这个阶段使用外部奖励。最有可能的是,扮演者的行为对其产生完全不同的影响。因此,我们必须对评论者再训练,以适应新的情况。

此外,虽然我们之前用到了关于所选技能对结果影响的假设,但现在我们将奖励误差梯度通过扮演者从评论者传递给调度器。但我们回到我们的 EA,并查看安排过程的算法。

模型训练过程仍安排在 Train 方法。与上面讨论的技能训练 EA 一样,我们在方法开始时为转换进行编码。不过,这一次我们添加了从环境加载的外部奖励。注意,我们只对每个单独的转换进行奖励。我们将使用目标模型预测累积奖励。

//+------------------------------------------------------------------+ //| Train function | //+------------------------------------------------------------------+ void Train(void) { int total_tr = ArraySize(Buffer); uint ticks = GetTickCount(); float loss = 0; //--- int total_states = Buffer[0].Total - 1; for(int i = 1; i < total_tr; i++) total_states += Buffer[i].Total - 1; vector<float> temp; Convolution.getResults(temp); matrix<float> state_embedding = matrix<float>::Zeros(total_states,temp.Size()); matrix<float> rewards = matrix<float>::Zeros(total_states,NRewards); int state = 0; for(int tr = 0; tr < total_tr; tr++) { for(int st = 0; st < Buffer[tr].Total - 1; st++) { State.AssignArray(Buffer[tr].States[st].state); float PrevBalance = Buffer[tr].States[MathMax(st,0)].account[0]; float PrevEquity = Buffer[tr].States[MathMax(st,0)].account[1]; State.Add((Buffer[tr].States[st].account[0] - PrevBalance) / PrevBalance); State.Add(Buffer[tr].States[st].account[1] / PrevBalance); State.Add((Buffer[tr].States[st].account[1] - PrevEquity) / PrevEquity); State.Add(Buffer[tr].States[st].account[2]); State.Add(Buffer[tr].States[st].account[3]); State.Add(Buffer[tr].States[st].account[4] / PrevBalance); State.Add(Buffer[tr].States[st].account[5] / PrevBalance); State.Add(Buffer[tr].States[st].account[6] / PrevBalance); double x = (double)Buffer[tr].States[st].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_MN1); State.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_W1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st].account[7] / (double)PeriodSeconds(PERIOD_D1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); //--- State.AddArray(Buffer[tr].States[st + 1].state); State.Add((Buffer[tr].States[st + 1].account[0] - PrevBalance) / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[1] / PrevBalance); State.Add((Buffer[tr].States[st + 1].account[1] - PrevEquity) / PrevEquity); State.Add(Buffer[tr].States[st + 1].account[2]); State.Add(Buffer[tr].States[st + 1].account[3]); State.Add(Buffer[tr].States[st + 1].account[4] / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[5] / PrevBalance); State.Add(Buffer[tr].States[st + 1].account[6] / PrevBalance); x = (double)Buffer[tr].States[st + 1].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_MN1); State.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_W1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[st + 1].account[7] / (double)PeriodSeconds(PERIOD_D1); State.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); if(!Convolution.feedForward(GetPointer(State),1,false,NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); ExpertRemove(); return; } Convolution.getResults(temp); state_embedding.Row(temp,state); temp.Assign(Buffer[tr].States[st].rewards); for(ulong r = 0; r < temp.Size(); r++) temp[r] -= Buffer[tr].States[st + 1].rewards[r] * DiscFactor; rewards.Row(temp,state); state++; if(GetTickCount() - ticks > 500) { string str = StringFormat("%-15s %6.2f%%", "Embedding ", state * 100.0 / (double)(total_states)); Comment(str); ticks = GetTickCount(); } } } if(state != total_states) { state_embedding.Reshape(state,state_embedding.Cols()); rewards.Reshape(state,NRewards); total_states = state; }

接下来,我们安排一个模型训练循环。在循环主体中,我们从经验回放缓冲区抽取状态。

vector<float> reward, rewards1, rewards2, target_reward; int bar = (HistoryBars - 1) * BarDescr; for(int iter = 0; (iter < Iterations && !IsStopped()); iter ++) { int tr = (int)((MathRand() / 32767.0) * (total_tr - 1)); int i = (int)((MathRand() * MathRand() / MathPow(32767, 2)) * (Buffer[tr].Total - 2)); if(i < 0) { iter--; continue; } reward = vector<float>::Zeros(NRewards); rewards1 = reward; rewards2 = reward; target_reward = reward;

准备源数据缓冲区。

//--- State State.AssignArray(Buffer[tr].States[i].state); float PrevBalance = Buffer[tr].States[MathMax(i - 1, 0)].account[0]; float PrevEquity = Buffer[tr].States[MathMax(i - 1, 0)].account[1]; if(PrevBalance == 0.0f || PrevEquity == 0.0f) continue; Account.Clear(); Account.Add((Buffer[tr].States[i].account[0] - PrevBalance) / PrevBalance); Account.Add(Buffer[tr].States[i].account[1] / PrevBalance); Account.Add((Buffer[tr].States[i].account[1] - PrevEquity) / PrevEquity); Account.Add(Buffer[tr].States[i].account[2]); Account.Add(Buffer[tr].States[i].account[3]); Account.Add(Buffer[tr].States[i].account[4] / PrevBalance); Account.Add(Buffer[tr].States[i].account[5] / PrevBalance); Account.Add(Buffer[tr].States[i].account[6] / PrevBalance); double x = (double)Buffer[tr].States[i].account[7] / (double)(D'2024.01.01' - D'2023.01.01'); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_MN1); Account.Add((float)MathCos(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_W1); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); x = (double)Buffer[tr].States[i].account[7] / (double)PeriodSeconds(PERIOD_D1); Account.Add((float)MathSin(x != 0 ? 2.0 * M_PI * x : 0)); if(Account.GetIndex() >= 0) Account.BufferWrite();

在生成所选状态的完整初始数据集后,我们运作一次编码器的直接验算。

//--- Encoder State if(!Encoder.feedForward(GetPointer(State), 1, false, GetPointer(Account))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

之后的编码器是调度器的前向验算,它估测环境状态的潜在表象,并为扮演者生成技能向量。

//--- Skills if(!Scheduler.feedForward(GetPointer(Encoder), -1, NULL,-1)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

扮演者依序使用由调度器指定的技能,并分析来自编码器的环境状态的潜在表象。根据初始数据的总和,扮演者生成一个动作向量。

//--- Actor if(!Actor.feedForward(GetPointer(Encoder), -1, GetPointer(Scheduler),-1)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

我们使用生成的动作向量来预测环境的下一个状态。

//--- Next State TargetState.AssignArray(Buffer[tr].States[i + 1].state); double cl_op = Buffer[tr].States[i + 1].state[bar]; double prof_1l = SymbolInfoDouble(_Symbol, SYMBOL_TRADE_TICK_VALUE_PROFIT) * cl_op / SymbolInfoDouble(_Symbol, SYMBOL_POINT); Actor.getResults(Result); vector<float> forecast = ForecastAccount(Buffer[tr].States[i].account,Result,prof_1l, Buffer[tr].States[i + 1].account[7]); TargetAccount.AssignArray(forecast); if(TargetAccount.GetIndex() >= 0 && !TargetAccount.BufferWrite()) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

我们针对目标模型对后续状态重复这些操作。调度器被排除在该链条之外,因为我们假设使用相同的技能。

if(!TargetEncoder.feedForward(GetPointer(TargetState), 1, false, GetPointer(TargetAccount))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } //--- Target if(!TargetActor.feedForward(GetPointer(TargetEncoder), -1, GetPointer(Scheduler),-1)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; }

不过,为了估测扮演者的政策,我们需要评论者估测其动作。在此,我们将使用较低的估值作为未来奖励的预测。

//--- if(!TargetCritic1.feedForward(GetPointer(TargetActor), LatentLayer, GetPointer(TargetActor)) || !TargetCritic2.feedForward(GetPointer(TargetActor), LatentLayer, GetPointer(TargetActor))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } TargetCritic1.getResults(rewards1); TargetCritic2.getResults(rewards2); if(rewards1.Sum() <= rewards2.Sum()) target_reward = rewards1; else target_reward = rewards2; target_reward *= DiscFactor;

我们将根据预测转换的 k-最近邻来估测当前动作。为此,我们将使用随机编码器。

State.AddArray(GetPointer(TargetState)); State.AddArray(GetPointer(TargetAccount)); if(!Convolution.feedForward(GetPointer(State),1,false,NULL)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } Convolution.getResults(rewards1); reward[0] += KNNReward(7,rewards1,state_embedding,rewards); reward += target_reward; Result.AssignArray(reward);

我们将当前和预测奖励结合起来。现在,我们有一个目标值来训练模型。所有剩余的就是选择评论者模型来更新调度器参数。我们运作两个评论者的直接验算,并为扮演者选择的动作选择最低评分。

if(!Critic1.feedForward(GetPointer(Actor), LatentLayer, GetPointer(Actor),-1) || !Critic2.feedForward(GetPointer(Actor), LatentLayer, GetPointer(Actor),-1)) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } Critic1.getResults(rewards1); Critic2.getResults(rewards2);

与之前的 EA 一样,我们执行一次贯穿选定评论者、扮演者和调度器的逆向验算。在后者中,我们运作一次评论者的逆向验算,依据扮演者动作的最大估值。

if(rewards1.Sum() <= rewards2.Sum()) { loss = (loss * MathMin(iter,999) + (reward - rewards1).Sum()) / MathMin(iter + 1,1000); if(!Critic1.backProp(Result, GetPointer(Actor)) || !Actor.backPropGradient(GetPointer(Scheduler),-1,-1) || !Scheduler.backPropGradient() || !Critic2.backProp(Result, GetPointer(Actor))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } } else { loss = (loss * MathMin(iter,999) + (reward - rewards2).Sum()) / MathMin(iter + 1,1000); if(!Critic2.backProp(Result, GetPointer(Actor)) || !Actor.backPropGradient(GetPointer(Scheduler),-1,-1) || !Scheduler.backPropGradient() || !Critic1.backProp(Result, GetPointer(Actor))) { PrintFormat("%s -> %d", __FUNCTION__, __LINE__); break; } }

在训练循环的迭代结束时,我们所要做的就是更新目标评论者模型,并通知用户有关模型训练的进度。

//--- Update Target Nets TargetCritic1.WeightsUpdate(GetPointer(Critic1), Tau); TargetCritic2.WeightsUpdate(GetPointer(Critic2), Tau); //--- if(GetTickCount() - ticks > 500) { string str = StringFormat("%-20s %5.2f%% -> Error %15.8f\n", "Critic1", iter * 100.0 / (double)(Iterations), Critic1.getRecentAverageError()); str += StringFormat("%-20s %5.2f%% -> Error %15.8f\n", "Critic2", iter * 100.0 / (double)(Iterations), Critic2.getRecentAverageError()); str += StringFormat("%-20s %5.2f%% -> Error %15.8f\n", "Scheduler", iter * 100.0 / (double)(Iterations), loss); Comment(str); ticks = GetTickCount(); } }

模型训练循环的所有迭代完成之后,我们清除图表上的注释,并启动 EA 的终止进程。

Comment(""); //--- PrintFormat("%s -> %d -> %-20s %10.7f", __FUNCTION__, __LINE__, "Critic1", Critic1.getRecentAverageError()); PrintFormat("%s -> %d -> %-20s %10.7f", __FUNCTION__, __LINE__, "Critic2", Critic2.getRecentAverageError()); PrintFormat("%s -> %d -> %-15s %10.7f", __FUNCTION__, __LINE__, "Scheduler", loss); ExpertRemove(); //--- }

为实现所提出算法,我们针对程序的研究至此结束。我们尚未看过测试训练模型的 EA。它已得到类似于收集训练样本 EA 的调整。不过,我没有在动作向量中添加随机噪声,来估测训练模型的真实品质。本文所有程序的完整代码可在附件中找到。

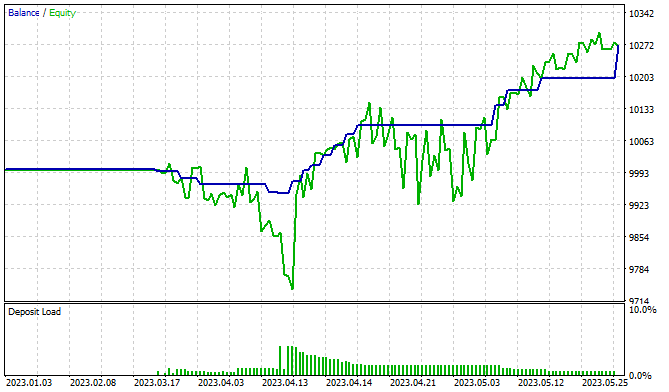

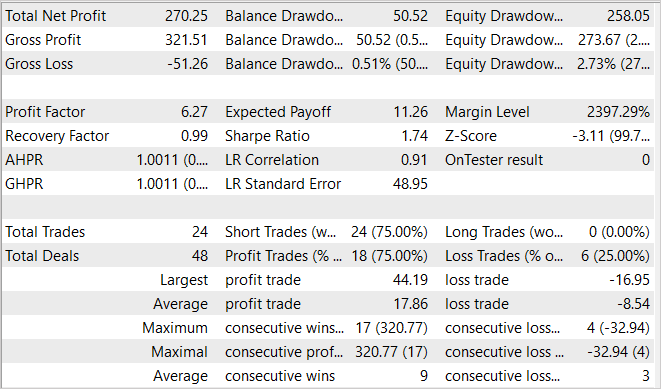

3. 测试

模型的训练和测试依据 2023 年前 5 个月的 EURUSD H1 进行。始终如一,所有指标采用默认参数。模型训练过程相当漫长。方法作者在训练技能的第一阶段提议两百万次迭代。当然,对于更复杂的环境,可以增加迭代次数。在训练我们的模型时,我按若干种方式遵循这条路径,并配合额外收集的训练数据。

训练完技能之后,是时候优调和训练调度器了。此阶段也至少有十万次迭代。我还建议以若干种方法运作这一阶段。我们首先初始化一个随机调度器模型,并在宽广的数据集上训练它。在第一次调度器训练验算之后,我们会收集其它训练集,其中包括调度器政策如何与环境交互的样本。这将允许调整其政策,从而令其更佳。

在训练期间,我能够训练出一个产生盈利的模型。该图形展示了余额曲线的明显上升趋势。同时,我注意到一些净值回撤区域,这也许表明需要对模型进行额外的训练。我们知道,金融市场是一个相当随机和复杂的环境。故此,可以预期需要更长的训练时间才能获得预期的结果。

结束语

在本文中,我们概述了层次化强化学习领域中一种很有前途的方法 — 对比内部控制(CIC)。这种方法属于基于自控制的内在奖励算法家族。基于 DIAYN 算法的原理,旨在遵照引入对比训练来提升智能体层次化技能的提取。

CIC 的主要特点之一是它能够在潜在行为数量可能相当庞大的复杂环境中学习各种技能。该性质在解决具有连续动作空间问题的领域中尤其实用。使用对比训练允许我们指导智能体,如此其不仅可在各种场景中有效学习,还可以从这些场景中提取有价值的知识。

在本文的实践部分,我们以 MQL5 实现了该算法。该模型依据真实历史数据进行了训练和测试。所得结果表明了该方法的潜在效率。训练大量技能也需要相符的智能体训练成本。

链接

本文中用到的程序

| # | 名称 | 类型 | 说明 |

|---|---|---|---|

| 1 | Research.mq5 | 智能交易系统 | 样本收集 EA |

| 2 | Pretrain.mq5 | 智能交易系统 | 扮演者技能训练 EA |

| 3 | Finetune.mq5 | 智能交易系统 | 调度器优调及训练 EA |

| 4 | Test.mq5 | 智能交易系统 | 模型测试 EA |

| 5 | Trajectory.mqh | 类库 | 系统状态定义结构 |

| 6 | NeuroNet.mqh | 类库 | 用于创建神经网络的类库 |

| 7 | NeuroNet.cl | 代码库 | OpenCL 程序代码库 |

本文由MetaQuotes Ltd译自俄文

原文地址: https://www.mql5.com/ru/articles/13212

注意: MetaQuotes Ltd.将保留所有关于这些材料的权利。全部或部分复制或者转载这些材料将被禁止。

本文由网站的一位用户撰写,反映了他们的个人观点。MetaQuotes Ltd 不对所提供信息的准确性负责,也不对因使用所述解决方案、策略或建议而产生的任何后果负责。

文章中的截图只显示了空头头寸(卖出)。

如何让它双向运行?Expert Advisor 已停止学习。嵌入后,Pretrain 和 Finetune 会飞离图表。真不幸。我应该重新开始吗?

专家顾问停止了学习。嵌入后,Pretrain 和 Finetune 正在飞速提升。

日志中有哪些信息?

日志信息是什么?

烟雾又复活了。我注意到一个奇怪的现象--在测试仪中通过 Research 之后,电脑会挂一会儿。这可能就是他们崩溃的原因。让我们继续学习吧

烟馆还活着。我注意到一个奇怪的现象--在测试仪中通过 "研究 "后,电脑会挂一会儿。也许这就是它们飞走的原因。我们继续学习。

通过 "研究 "后,会保存示例数据库。如果数据库足够大,在处理数据库并将其写入光盘时,您可能会感觉电脑变慢。当然,如果在保存数据库时出现错误,Pretrain 和 Finetune 将无法读取数据库,从而导致死机。