Aprendizaje automático en el trading: teoría, práctica, operaciones y más - página 2820

Está perdiendo oportunidades comerciales:

- Aplicaciones de trading gratuitas

- 8 000+ señales para copiar

- Noticias económicas para analizar los mercados financieros

Registro

Entrada

Usted acepta la política del sitio web y las condiciones de uso

Si no tiene cuenta de usuario, regístrese

En estos ejemplos todas las posibles relaciones entre las variables se establecieron de forma automática.

Aunque se pueden desactivar, o establecer variables específicas para la relación.

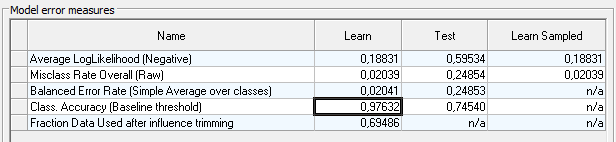

He jugado con el ajuste sin aproximación, aumentó el número de nodos por árbol al número de variables.

El modelo se hizo más compleja, entrenado durante 12 minutos.

en el traine assugasusubió a 0,97

pero la prueba se echa a perder todo en 0,74.

En general, es probable que haya algo para trabajar y pensar. Tal vez algo va asalir de sus datos.

Hay un montón de diferentes ajustes en el programa, simplemente no entiendo completamente cómo trabajar con ellos.

Sólo estoy estudiando la funcionalidad a mí mismo desde ayer ))

Y su conjunto de datos acaba de pasar a aparecer, para estudiar la funcionalidad, así, tal vez algo va a salir de sus datos.

No entiendo muy bien lo que quiere decir con constructor automático de características?

Auto búsqueda de características en sí, o la búsqueda automática de las relaciones entre las características existentes?

En estos ejemplos, todas las posibles relaciones entre variables se han establecido automáticamente.

Aunque puede desactivarlas, o establecer variables específicas para la relación.

No, eso no es lo que quería decir.

Quise decir que entrené xgboost en otros rasgos para obtener akurasi 0.83 en nuevos datos.

Construido los rasgos de OHLC y otro indicador

de acuerdo con el principio

O[i] - H[i-1]

L[i-5]-indic[i-10]

........

....

..

y así todas las combinaciones posibles (todos con todos).

Tengo unos 10.000 rasgos.

300 de ellos útiles.

el modelo dio 0.83 en los nuevos datos.

===========

No entiendo muy bien a qué te refieres con un constructor automático de rasgos?

Quiero automatizar lo descrito anteriormente para que el propio ordenador construya características, y entonces no habrá 10k características para elegir, sino mil millones por ejemplo....

¿Búsqueda automática de las características en sí, o búsqueda automática de dependencias entre las características disponibles?

creación/construcción automática de características ---> comprobación de idoneidad ---> selección de las mejores ---> posiblemente mutación de las mejores en busca de otras aún mejores ....

Y todo es automático.

Basado en MSUA, si lo has leído... pero sólo basado en él....

Hay un montón de ajustes diferentes en el programa, sólo que no entiendo muy bien cómo trabajar con ellos.

Sólo estoy estudiando la funcionalidad a mí mismo desde ayer ))

Y su conjunto de datos sólo por cierto, para estudiar la funcionalidad, así, tal vez algo y exprimir de sus datos.

¿Qué es este programa?

leer probabilidadgeométrica

Es un verdadero muñón, aferrándose a cada palabra.

Tiene distrofia cognitiva total, ¿cómo puede siquiera argumentar sobre algo?esa es la probabilidad de una agrupación, interpretada geométricamente.

se te ha dicho que deliras y que no sabes de lo que hablas. Nadie ha cambiado desde entonces.