交易中的机器学习:理论、模型、实践和算法交易 - 页 2820 1...281328142815281628172818281928202821282228232824282528262827...3399 新评论 Roman 2022.11.07 16:15 #28191 梯度提升 在托盘中,asscgasu升至 0.85,但在测试中却降至 0.75。 为了提高分析 结果的准确性,可以尝试对重要变量 的影响进行近似 分析, 对每一类-1、0、1 将这些曲线作为新变量使用。 例如,对于第 1 类,RSI 的影响如下 经过近似,我们得到了一个新的样条。 以此类推,对每个变量和每个类别都是如此。 因此,我们将得到一组新的样条,并将其输入到输入端,而不是原始变量。 mytarmailS 2022.11.07 18:54 #28192 Roman #:梯度提升上,增益上升到 0.85,但在测试 上,增益下降到 0.75 作为一个提高增益的 选项,您可以尝试近似重要变量 的影响,对于每个类 -1, 0, 1 将这些样条作为新变量使用。例如,对于 1 类,RSI 的影响如下经过近似,我们得到了一个新的样条。以此类推,每个变量和每个等级都是如此。 结果,我们得到了一组新的样条,并将其输入到输入中,而不是原始变量。嗯,值得称赞 我在 xgboost 上得到的结果是 0.83,但在其他变量上,我已经用 ohlc 和 donchian 通道建立了变量之间所有可能的关系,每个变量与每个变量之间的关系......我得到了超过 10k 个迹象....。但有大约 300 个变量有重要的符号。近似的想法很有趣,虽然我不理解,但可以试试....。有意思。如果你能挤出 0.9,我觉得会很酷。=======我想创建一个自动功能生成器,但在代码架构....,我怎么也搞不定。从本质上讲,它应该是个炸弹,但这只是理论上的。=======你用什么训练模型? Roman 2022.11.07 20:42 #28193 mytarmailS #:嗯,这一点值得称赞! 我在 xgboost 上得到了 0.83,但从其他变量中,我利用 ohlc 和 donchian 通道建立了变量之间所有可能的关系,每个变量与每个变量之间......我得到了超过 10k 的符号....。 但有大约 300 个变量有重要的符号。 近似的想法很有趣,虽然我不理解,但可以试试....。有趣 如果能挤出 0.9,我觉得会很酷。 ======= 我想创建一个自动功能生成器,但我无法理解代码架构.... 从本质上讲,它应该是一个炸弹,但这只是理论上的 ======= 你用什么训练你的模型? 在这些例子中,变量之间所有可能的关系都是自动设置的。 虽然你可以禁用它们,或者为关系设置特定的变量。 我玩了一下不近似的调整,将每棵树的节点数增加到变量数。 模型变得更复杂了,训练了 12 分钟。 在 traine assugasu 上上升到 0.97,但测试破坏了一切,只有 0.74。 总的来说,可能有一些东西需要研究和思考。程序中有很多不同的设置,只是我还不完全了解如何使用它们。我从昨天开始就自己研究功能了))而你的数据集恰好出现,正好可以研究功能,也许你的数据 中会有一些东西。 我不太明白你说的自动特征构建器是什么意思? 自动搜索特征本身,还是自动搜索现有特征之间的关系? mytarmailS 2022.11.07 20:56 #28194 Roman #:在这些示例中,变量之间所有可能的关系都已自动设置。,但您可以禁用它们,或为关系设置特定变量。 不,我不是 这个意思。 我的意思是,我对其他特征进行了 xgboost 训练,从而在新数据上获得了 0.83 的 akurasi 值。 从 OHLC 和另一个指标中构建特征 根据以下原则 O[i]-H[i-1]-L[i-5]-指标 L[i-5]-指标[i-10] ........ .... .. 等等所有可能的组合(所有与所有)。 我得到了大约 10 000 个特征。 其中 300 个有用。 在新数据上,模型得到了 0.83。 =========== Roman#: 我不太明白你说的自动特征构建器是 什么意思? 我想实现上述自动化,让计算机自己构建特征,这样就不会有 10k 个特征可供选择,而是有十亿个特征可供选择,例如....。 Roman#: 自动搜索特征本身,还是自动搜索可用特征之间的依赖关系? 自动创建/构建特征--->测试适用性 --- >选择最佳特征 - -->可能对最佳特征进行突变,以寻找更好的特征....。 这一切都是自动的。基于 MSUA,如果你读过的话......但只是基于它.... Machine learning in trading: MQL5 中的范畴论 (第 9 利用 MQL5 矩阵的反向传播神经网络 Aleksey Vyazmikin 2022.11.07 22:21 #28195 Roman #:程序中有很多不同的设置,我只是不完全了解如何使用它们。从昨天开始,我就在自己研究这些功能了))还有你的数据集,顺便研究一下这些功能,也许能从你的数据中挤出点什么来。 这是什么程序? [删除] 2022.11.07 22:43 #28196 关于目标和属性的结论与 HMM 相同。不清楚这些结论从何而来 😀 mytarmailS 2022.11.08 11:31 #28197 认为接近性和概率是一回事的非蠢人不懂.....。 [删除] 2022.11.08 11:52 #28198 职业学校没有教的是,在数学上,任何矩阵都是一样的 😀😀😀😀,对它们的运算也是一样的。只有簇定义和名称的算法不同。 mytarmailS 2022.11.08 11:57 #28199 没错,数学上任何矩阵都是一样的,因此接近度和概率也是一样的))))。别丢人现眼了,你这个非学生。 [删除] 2022.11.08 12:12 #28200 读几何 概率他真是个木头桩子,一个字都不放过。 你完全患有认知萎缩症,怎么还能争论什么呢? 1...281328142815281628172818281928202821282228232824282528262827...3399 新评论 您错过了交易机会: 免费交易应用程序 8,000+信号可供复制 探索金融市场的经济新闻 注册 登录 拉丁字符(不带空格) 密码将被发送至该邮箱 发生错误 使用 Google 登录 您同意网站政策和使用条款 如果您没有帐号,请注册 可以使用cookies登录MQL5.com网站。 请在您的浏览器中启用必要的设置,否则您将无法登录。 忘记您的登录名/密码? 使用 Google 登录

梯度提升

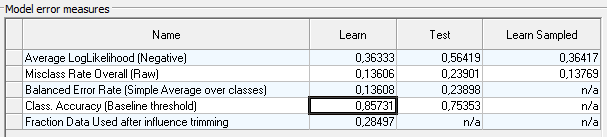

在托盘中,asscgasu升至 0.85

,但在测试中却降至 0.75。

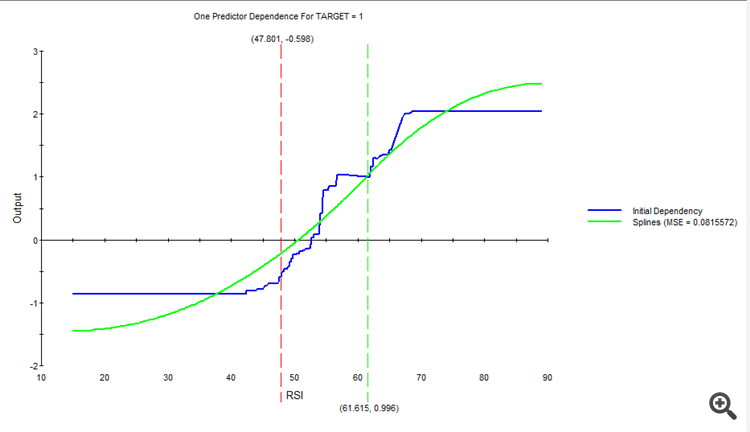

为了提高分析 结果的准确性,可以尝试对重要变量 的影响进行近似 分析, 对每一类-1、0、1

将这些曲线作为新变量使用。

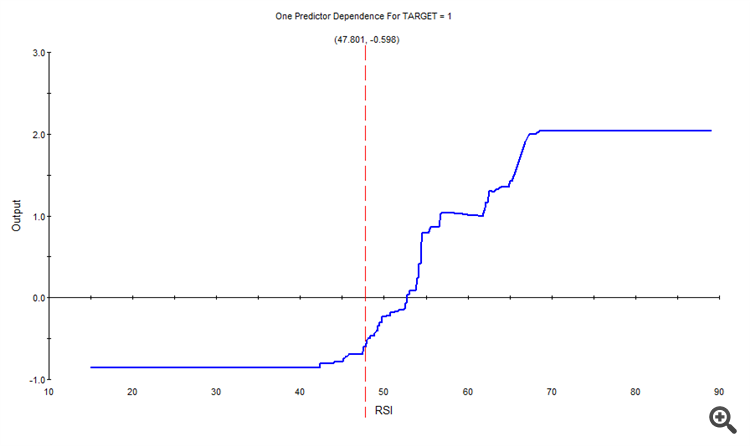

例如,对于第 1 类,RSI 的影响如下

经过近似,我们得到了一个新的样条。

以此类推,对每个变量和每个类别都是如此。

因此,我们将得到一组新的样条,并将其输入到输入端,而不是原始变量。

梯度提升

上,增益上升到 0.85

,但在测试

上,增益下降到 0.75

作为一个提高增益的 选项,您可以尝试近似重要变量 的影响,对于每个类 -1, 0, 1

将这些样条作为新变量使用。

例如,对于 1 类,RSI 的影响如下

经过近似,我们得到了一个新的样条。

以此类推,每个变量和每个等级都是如此。

结果,我们得到了一组新的样条,并将其输入到输入中,而不是原始变量。

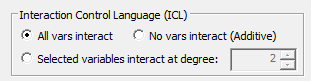

在这些例子中,变量之间所有可能的关系都是自动设置的。

虽然你可以禁用它们,或者为关系设置特定的变量。

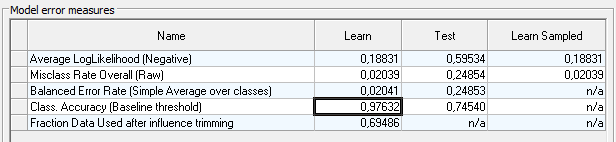

我玩了一下不近似的调整,将每棵树的节点数增加到变量数。

模型变得更复杂了,训练了 12 分钟。

在 traine assugasu 上上升到 0.97

,但测试破坏了一切,只有 0.74。

总的来说,可能有一些东西需要研究和思考。

程序中有很多不同的设置,只是我还不完全了解如何使用它们。

我从昨天开始就自己研究功能了))

而你的数据集恰好出现,正好可以研究功能,也许你的数据 中会有一些东西。

我不太明白你说的自动特征构建器是什么意思?

自动搜索特征本身,还是自动搜索现有特征之间的关系?

在这些示例中,变量之间所有可能的关系都已自动设置。

,但您可以禁用它们,或为关系设置特定变量。

不,我不是 这个意思。

我的意思是,我对其他特征进行了 xgboost 训练,从而在新数据上获得了 0.83 的 akurasi 值。

从 OHLC 和另一个指标中构建特征

根据以下原则

O[i]-H[i-1]-L[i-5]-指标

L[i-5]-指标[i-10]

........

....

..

等等所有可能的组合(所有与所有)。

我得到了大约 10 000 个特征。

其中 300 个有用。

在新数据上,模型得到了 0.83。

===========

我不太明白你说的自动特征构建器是 什么意思?

我想实现上述自动化,让计算机自己构建特征,这样就不会有 10k 个特征可供选择,而是有十亿个特征可供选择,例如....。

自动搜索特征本身,还是自动搜索可用特征之间的依赖关系?

自动创建/构建特征--->测试适用性 --- >选择最佳特征 - -->可能对最佳特征进行突变,以寻找更好的特征....。

这一切都是自动的。

基于 MSUA,如果你读过的话......但只是基于它....

程序中有很多不同的设置,我只是不完全了解如何使用它们。

从昨天开始,我就在自己研究这些功能了))

还有你的数据集,顺便研究一下这些功能,也许能从你的数据中挤出点什么来。

这是什么程序?

读几何 概率

他真是个木头桩子,一个字都不放过。

你完全患有认知萎缩症,怎么还能争论什么呢?