Aprendizado de máquina no trading: teoria, prática, negociação e não só - página 626

Você está perdendo oportunidades de negociação:

- Aplicativos de negociação gratuitos

- 8 000+ sinais para cópia

- Notícias econômicas para análise dos mercados financeiros

Registro

Login

Você concorda com a política do site e com os termos de uso

Se você não tem uma conta, por favor registre-se

Porquê, não, há demasiadas árvores... estava bem mesmo com 10 (não me lembro de quantas eu montei)

500 é muito, o suficiente para qualquer conjunto de dados.

Porque é que tais erros ocorreram com números fracionários? ... estranho, eu esperava que a máquina pudesse aprender exactamente... Assim, no caso de padrões (em forex) sua forma está longe de ser clara (como tabela de multiplicação) é bom se você obtiver previsões corretas em 60% dos casos.

Os erros ocorreram porque o parâmetro r era baixo, o que significa que apenas metade dos exemplos foram utilizados para treinamento, e esta metade foi treinada em metade das árvores :) e há poucos exemplos

você tem que definir r~1 para ser exato. Utilizado para pseudoregularização e para testes em amostras fora de saco

é que este mecanismo precisa de ser ajustado, no caso da floresta, existem apenas 2 configurações

Você também deve entender que NS (RF) não é uma calculadora, mas se aproxima de uma função, e precisão muito alta é mais ruim do que boa para muitas tarefas.

Receio que a regressão/previsão na rede produza mais ou menos a mesma coisa que a procura de sites/padrões similares na história (o que fiz há 3 meses atrás):

Os erros ocorreram porque o parâmetro r era baixo, o que significa que apenas metade dos exemplos foram utilizados para treinamento, e esta metade foi treinada em metade das árvores :) e há poucos exemplos

você tem que definir r~1 para ser exato. Utilizado para pseudoregularização e para testes em amostras fora de saco

Você só precisa saber afinar este mecanismo, no caso da floresta, existem apenas 2 configurações

Isto é, se você definir r para 1, então ele será treinado em todas as amostras.

A floresta não utilizará todos os atributos de qualquer forma, portanto há uma modificação do modelo onde você pode configurá-lo para utilizar todos os atributos. Mas isso não é recomendado porque a floresta vai se lembrar de todas as opções

e a seleção de configurações é muitas vezes uma coisa tão subjetiva, você tem que experimentar

se for inferior a 1, o modelo é validado nas amostras restantes (o modelo é estimado nos dados que não foram levados para a amostra de treino). r clássico é 0,67, no modelo 33% restante é validado. Claro que isto é verdade para as amostras grandes, para as pequenas é como com a tabela de multiplicação - é melhor definir 1.

A floresta não utilizará todos os atributos de qualquer maneira, portanto há uma modificação do modelo onde você pode configurá-lo para utilizar todos os atributos. Mas isso não é recomendado porque a floresta vai se lembrar de todas as opções

e a seleção de configurações é muitas vezes uma coisa tão subjetiva, você tem que experimentar

Se for inferior a 1, o modelo é validado nas amostras restantes (o modelo é estimado em dados que não foram levados para a amostra de treinamento). De acordo com o r clássico é definido como 0,67, no modelo 33% restante é validado

Seleção de características

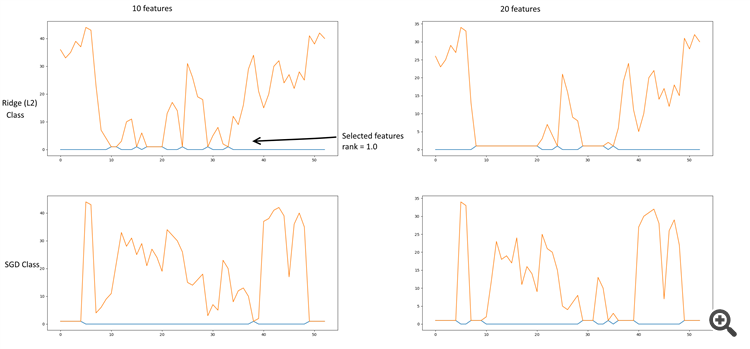

Um pouco de datamining. Eu estava fazendo a seleção de características via Chi^2 + KBest, RFE (Recursive feature elimination) + (SGDClassifier, RidgeClassifier), L2 (Ridge, RidgeClassifier), L1 (Lasso). A regularização da crista dá resultados mais sãos.

Alguns gráficos:

RFE + Ridge & SGD

Regressor de cumeeira (L2).

Classificador de cumeeira (L2)

O arquivo contém uma tabela de valores de parâmetros, e sua amostragem por seleção de características.

Os coeficientes mais significativos acabaram por ser os mais significativos:

- 10, 11 - Fechar, Delta (Abrir-Fechar)

- 18-20 - Derivados Alto, Baixo, Fechado

- 24 - Derivado de log Fechar

- 29, 30 - Lowess

- 33 - Detranding Close - Lowess

- 35 - EMA 26 (13 como opção)

- 40 - EMA Derivado 13

PS. A linha Ridge Classifier na tabela é baseada em uma classe, ela não reflete dependências de parâmetros em outras classes.Referência ao guião.

esboçou um novo diagrama de rede, esta é a primeira descrição. Haverá mais tarde (esperemos)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

esboçou um novo diagrama de rede, esta é a primeira descrição. Haverá mais tarde (esperemos)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

Porque será que o primeiro post foi apagado? Ele blogou o esquema. =)