Muito bom trabalho!

Eu o li em um piscar de olhos.

Muito obrigado!

Bom artigo. Seria interessante saber sua opinião sobre o artigo de Stepanov, no qual ele apresenta uma hipótese sobre a natureza não estocástica das flutuações de volatilidade.

O senhor me atingiu em cheio no meu TS. Estou tentando usar splines em vez de HP.

Eu estava me perguntando o que é melhor para escolher o período e o grau de suavização.

Parece que é melhor confiar no teste de distribuição normal dos resíduos?

Você me acertou em cheio no meu TC. Em vez de HP, estou tentando splines.

Gostaria de saber o que é melhor para escolher o período e o grau de suavização.

Parece que é melhor confiar no teste de distribuição normal dos resíduos?

Bom artigo. Seria interessante saber sua opinião sobre o artigo de Stepanov, no qual ele apresenta uma hipótese sobre a natureza não estocástica das flutuações de volatilidade.

O artigo é complexo e contraditório. Por um lado, o autor usa terminologia probabilística, ferramentas estatísticas, caracteriza o incremento de preço e a volatilidade como variáveis aleatórias, constrói distribuições de diferentes medidas de volatilidade, etc., por outro lado, ele não gosta de modelos de volatilidade estocástica.

Na minha opinião, sim, se você criar modelos para incrementos em intervalos de tempo constantes, precisará reduzir tudo a ruído gaussiano no final. Esse é provavelmente o objetivo da econometria - todos os fatores não considerados no modelo devem se comportar como ruído suave.

Interessante, ainda não fiz isso. No artigo, o autor selecionou os parâmetros de forma empírica. Mas é possível fazer a otimização por meio da função de verossimilhança.

Tópico para pesquisa :)

Interessante, ainda não fiz isso. No artigo, o autor selecionou os parâmetros de forma empírica. Mas é possível fazer a otimização por meio da função de verossimilhança.

Tópico para pesquisa :)

Eu criei o LLM DeepSeek com a ajuda de Deus. Você pode substituir seus próprios dados.

Explicação:

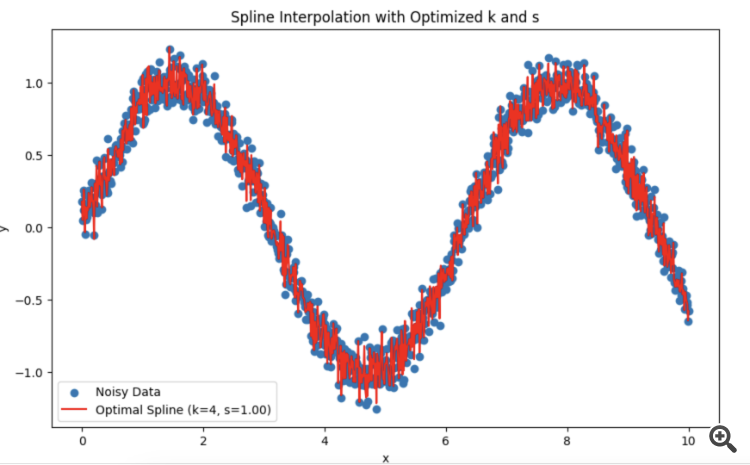

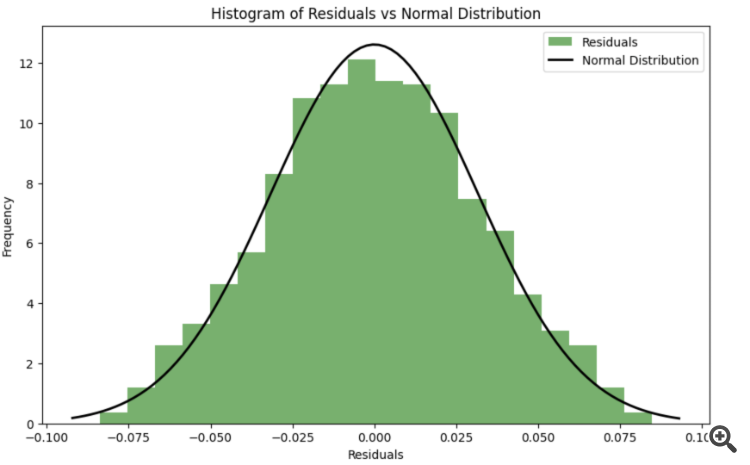

Para tornar os resíduos o mais próximo possível de uma distribuição normal durante o processo de otimização, um critério de concordância (por exemplo, o critério de Shapiro-Wilk ou o critério de Kolmogorov-Smirnov) pode ser usado para avaliar a normalidade dos resíduos. Os parâmetros k k e s spodem então ser otimizados para que o desvio dos resíduos da distribuição normal seja minimizado.

-

Função de erro considerando a normalidade dos resíduos: Foi introduzida uma nova função spline_error_with_normality , que calcula os resíduos e usa o critério de Shapiro-Wilk para avaliar sua normalidade. O valor p negativo é minimizado para maximizar a normalidade dos resíduos.

-

Otimização: é usada para otimizar os parâmetros k k e s s com base em uma nova função de erro.

Essa abordagem permite que os parâmetros de spline sejam ajustados de modo que os resíduos maximizem a distribuição normal, o que pode melhorar a qualidade do modelo e a interpretabilidade dos resultados.

- Aplicativos de negociação gratuitos

- 8 000+ sinais para cópia

- Notícias econômicas para análise dos mercados financeiros

Você concorda com a política do site e com os termos de uso

Novo artigo Ferramentas econométricas para previsão de volatilidade: Modelo GARCH foi publicado:

O artigo descreve as propriedades do modelo não linear de heterocedasticidade condicional (GARCH). O indicador iGARCH para prever a volatilidade um passo à frente é construído com base nele. A biblioteca de análise numérica ALGLIB é usada para estimar os parâmetros do modelo.

A volatilidade é um indicador importante para avaliar a flutuação dos preços dos ativos financeiros. Na análise das cotações, há muito tempo que se observou, que grandes mudanças de preços levam frequentemente a mudanças ainda maiores, especialmente em períodos de crise financeira. Por outro lado, pequenas mudanças nos preços são geralmente seguidas por outras pequenas mudanças. Assim, períodos de relativa estabilidade são alternados com períodos de volatilidade.

O primeiro modelo a tentar explicar esse fenômeno foi o modelo ARCH,desenvolvido por Engle), — que considera a heteroscedasticidade condicional autorregressiva (não uniformidade). Além de explicar o efeito de agrupamento (concentração de retornos em valores altos e baixos), esse modelo também explicava a ocorrência de caudas pesadas e excesso positivo, características de todas as distribuições de incrementos de preços. O sucesso do modelo ARCH condicionalmente gaussiano levou ao surgimento de uma série de generalizações, cujo objetivo era explicar outros fenômenos observados na análise de séries temporais financeiras. Historicamente, uma das primeiras generalizações do modelo ARCH foi o modelo GARCH (Generalized ARCH).

A principal vantagem do GARCH em relação ao ARCH é que ele é mais econômico e não exige uma estrutura de longos atrasos na adequação dos dados amostrais. Neste artigo, pretendo descrever o que é o modelo GARCH, e, mais importante, propor uma ferramenta pronta para a previsão de volatilidade com base nele, já que a previsão — é um dos principais objetivos na análise de dados financeiros.

Autor: Evgeniy Chernish