この記事は面白い。私はこれまでニューラルネットワークを「暗い森」だと信じて見ようともしなかったし、以前このトピックで読んだものはすべて、理解しがたい言葉の多さに反発していた。しかしこの記事では、確かに理論は非常にシンプルで理解しやすい。著者に感謝したい。

そして、このフレーズを明確にしたい。"どちらのEAも、6%強の的中率で同様の結果を示した。"。

そして、35エポックのトレーニングの後、わずか12%?

このような低い結果は、このトピックをさらに研究する動機にはならない。

予測の精度を向上させる方法とは?

こんにちは、ディミトリ。

このトピックはとても興味深く、必要なものだ。これらの記事をありがとう)

1.Traine(... ) メソッドのコードについて質問があります:

TempData.Clear(); bool sell=(High.GetData(i+2)<High.GetData(i+1) && High.GetData(i)<High.GetData(i+1)); //в строчке ниже скорее всего не верно определяется Low фрактал bool buy=(Low.GetData(i+2)<Low.GetData(i+1) && Low.GetData(i)<Low.GetData(i+1)); //знаки сравнения нужно поменять наоборот buy=(Low.GetData(i+2)>Low.GetData(i+1) && Low.GetData(i)>Low.GetData(i+1));/

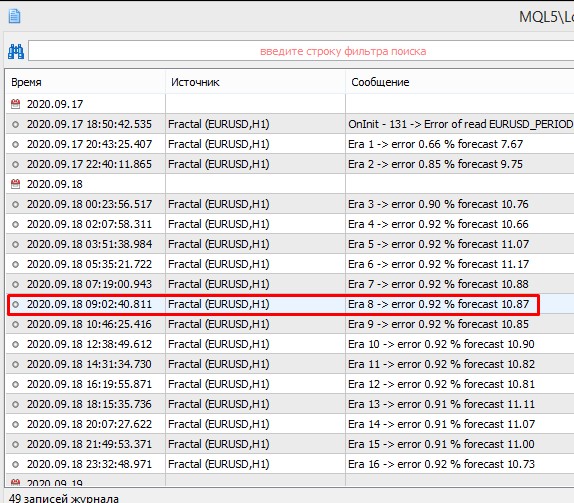

修正版をトレーニングで実行したところ、結果が改善されました:

エポック8ですでに精度は16.98%で、同じエポックでの旧バリアントの精度は10.87%でした。

2.多層ニューラル・ネットワークの精度が低いのはなぜですか?

こんにちは、ディミトリ。

このトピックはとても興味深く、必要なものだ。このような記事をありがとう)

1.Traine(... ) メソッドのコードについて質問があります:

修正版をトレーニングに使用したところ、結果が改善されました:

エポック8ですでに精度は16.98%だったのに対し、同じエポックでの古いバージョンは10.87%でした。

アレクサンダー、コメントありがとう。コピーペーストのミスです。

こんにちは、ディミトリ。

2.多層ニューラルネットワークの精度が50%にも満たないのはなぜですか?

私は最初の記事で、標準的なパラメータを持つ標準的な指標からランダムな指標を選んだと書きました。ニューラルネットワークは 良いツールだが、超自然的なものではない。どこにパターンがあるかを探す。しかし、生データにパターンがなければ、それだけでパターンを見つけることはできない。フラクタルを正確にヒットさせるのはかなり難しい作業で、正直なところ、正確にヒットするとは思っていなかった。しかし、私が得たものは、さらなる研究のための根拠を与えてくれる。

アレクサンダー、コメントありがとう。残念なコピペミスだ。

よくあることです)

私は最初の記事で、標準的なパラメータを持つ標準的な指標からランダムな指標を取り出したと書いた。ニューラルネットワークは良いツールだが、超自然的なものではない。どこにパターンがあるかを探す。しかし、生データにパターンがなければ、それだけでパターンを見つけることはできない。フラクタルを正確にヒットさせるのはかなり難しい作業で、正直なところ、正確にヒットするとは思っていなかった。しかし、私が得たものは、さらなる研究のための根拠を与えてくれる。

理にかなっている)。

いずれにしても、あなたの仕事は素晴らしい。)

ドミトリー、こんにちは!

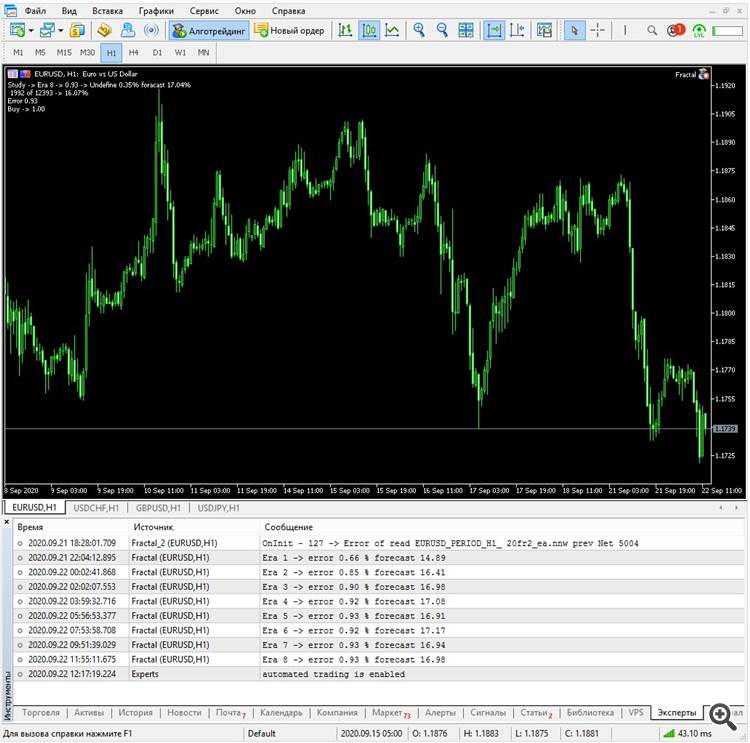

ニューラルネットワークに関する一連の記事はとても興味深い。現在、私はさまざまな指標セットとネットワークのタスクを試しています。私は、次のバーの発生確率を、Hightレベルが現在のバーのOpenレベルより100ポイント高いか、Lowレベルが現在のバーのOpenレベルより100ポイント低いかを 決定するタスクをネットワークに設定することにしました。

if(add_loop && i<(int)(bars-MathMax(HistoryBars,0)-1) && i>1 && Time.GetData(i)>dtStudied && dPrevSignal!=-2) { TempData.Clear(); double DiffMin=100; double DiffLow=Open.GetData(i+1)-Low.GetData(i); double DiffHigh=High.GetData(i)-Open.GetData(i+1); bool sell=(DiffLow>=DiffMin); bool buy=(DiffHigh>=DiffMin); TempData.Add((double)buy); TempData.Add((double)sell); TempData.Add((double)(!buy && !sell)); Net.backProp(TempData); ... }

Expert Advisor をテスト すると、予測されたフラクタルのラベルはチャートに表示されますが、正しく予測されたフラクタルの統計と見つからなかったフラクタルの統計は更新されず、常に 0.00% になります。 私が犯したエラーを教えてください。

if(DoubleToSignal(dPrevSignal)!=Undefine) { if(DoubleToSignal(dPrevSignal)==DoubleToSignal(TempData.At(0))) dForecast+=(100-dForecast)/Net.recentAverageSmoothingFactor; else dForecast-=dForecast/Net.recentAverageSmoothingFactor; dUndefine-=dUndefine/Net.recentAverageSmoothingFactor; } else { if(sell || buy) dUndefine+=(100-dUndefine)/Net.recentAverageSmoothingFactor; }

- www.mql5.com

ディミトリ、こんにちは!

ニューラルネットワークに関する一連の記事はとても興味深い。現在、私はさまざまなインジケータとネットワークのタスクを試しています。私はネットワークに、次のバーの出現確率を、Hightレベルが現在のバーのOpenレベルより100ポイント高いか、Lowレベルが現在のバーのOpenレベルより100ポイント低いかを 決定するタスクを設定することにしました。

Expert Advisor をテスト すると、予測されたフラクタルのラベルはチャートに表示されますが、正しく予測されたフラクタルの統計と見つからなかったフラクタルの統計は更新されず、常に 0.00% になります。 私が犯したエラーを教えてください。

こんにちは。

Diff=100と指定されていますが、私の理解ではこれはpips単位です。そして、差は価格によって計算されます。例えば、EURUSDの場合、1.16715-1.15615=0.01と計算されます。その結果、比較可能なデータがなく、売りと買いは常に偽になります。

こんにちは、

Diff=100と指定されましたが、私の理解する限り、これはポイントです。そして、その差は価格によって計算されます。例えば、EURUSDの場合、1.16715-1.15615=0.01と計算されます。その結果、比較可能なデータがなく、売りと買いは常に偽になります。

疑問があります:このニューラルネットワークの精度が無視できるものであるなら、なぜ、このような一連の非常に難解な記事のトピックを研究する必要があるのでしょうか・・・。私は、このトピックは中止するか、EAを改良すべきだと思う。

私のニューラルネットワークは、あなたのものよりもはるかに「複雑」ですが、正しい入力の70-80%を与えることが保証されており、同時に構造的にははるかに単純であることを付け加えておきます.

そして、あなたのものよりもはるかに精度の高いニューラルネットワークが他にもたくさんあることも付け加えておく。

一般的に、あなたの記事にはお金が支払われているような印象を受けるが、何の役にも立たない.ごめんなさい.

また、「ニューラルネットワークは簡単」というタイトルにも同意できません。ビッグデータの機械学習に携わっている人ならわかると思いますが、簡単ではないのです.:-)

>ネットワークの性能を評価するには、予測の平均二乗誤差、正しく予測されたフラクタルの割合、外れたフラクタルの割合を使うことができます。

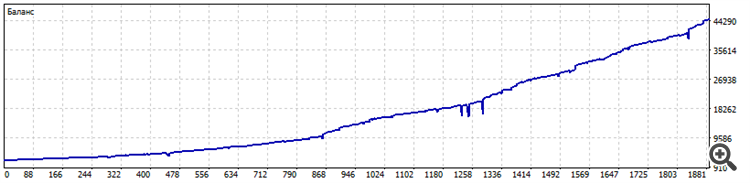

結果は最終的な収支と純利益だけで、他には何もない.科学のための科学ではなく、利益のための科学なのだ。

60%の精度を持つExpert Advisorが存在する。しかし、巧妙なシステムのおかげで、彼らは80%の精度の顧問よりも多くの利益を与える...

そして、あなたはあなたのEAの最終的な取引の統計のチャートで開始する必要がありますまたはそれを読むことに意味がありません、私はすぐに統計がないか、それが私の要件を満たしていない場合、あなたは全く読むことができない、以下は私の非常にスマートではないneuronkaのテストです。

そして、あなたはあなたのEAの最終的な取引状態のチャートで起動する必要がありますまたはそれを読むことに意味がありません、私はすぐにダウンして、状態がないか、それが私の要件を満たしていない場合は、全く読むことができない、以下は私の非常にスマートではないneuronkaのテストです。

その後、記事のセクションは必要ありません。

あなたの要件 - 収益性の高いsteithのために、セクションCodobaseと市場が適しています。

はい、ところで、あなたのメッセージもあなたの要件に適合していないので、それも無視することができますか?)))

あなたは記事が必要です、あなたは適切にニューラルネットワークに基づいて動作するEAをテストするためにそれらが必要です、あなたの状態は、MT4からだけでなく、テスターからのものである可能性が高いですが、あなたは訓練/テスト/検証に訓練サンプルを分割していない可能性があります。

構造化された読みやすいコードの 書き方を学ぶには、記事が必要です。この記事の著者のコードは、これらの要件にぴったりだと思います。

- 無料取引アプリ

- 8千を超えるシグナルをコピー

- 金融ニュースで金融マーケットを探索

新しい記事「ニューラルネットワークと容易性(後編)。ネットワークのトレーニングとテスト」はパブリッシュされました:

第2回目の今回は、引き続きニューラルネットワークの勉強をし、作成したCNetクラスをEAで使用した例を考えていきます。 学習時間、予測精度ともに同様の結果を示す2つのニューラルネットワークモデルを用いてタスクを行います。

最初のエポックは、初期段階でランダムに選択されたニューラルネットワークの加重に強く依存します。

35エポックのトレーニングを行った後、統計量の差はわずかに増加した - 回帰ニューラルネットワークモデルはより良いパフォーマンスを示しました。

テストの結果、どちらのニューラルネットワーク組織亜種も、学習時間と予測精度の点で似たような結果が得られることがわかりました。 同時に、得られた結果から、ニューラルネットワークのトレーニングには追加の時間とリソースが必要であることが示されました。 ニューラルネットワークの学習ダイナミクスを解析したい場合は、添付ファイルの各学習エポックのスクリーンショットをご覧ください。

作者: Dmitriy Gizlyk