Discussão do artigo "Redes neurais em trading: Abordagem sem máscara para previsão do movimento de preços"

Olá, Dmitriy,

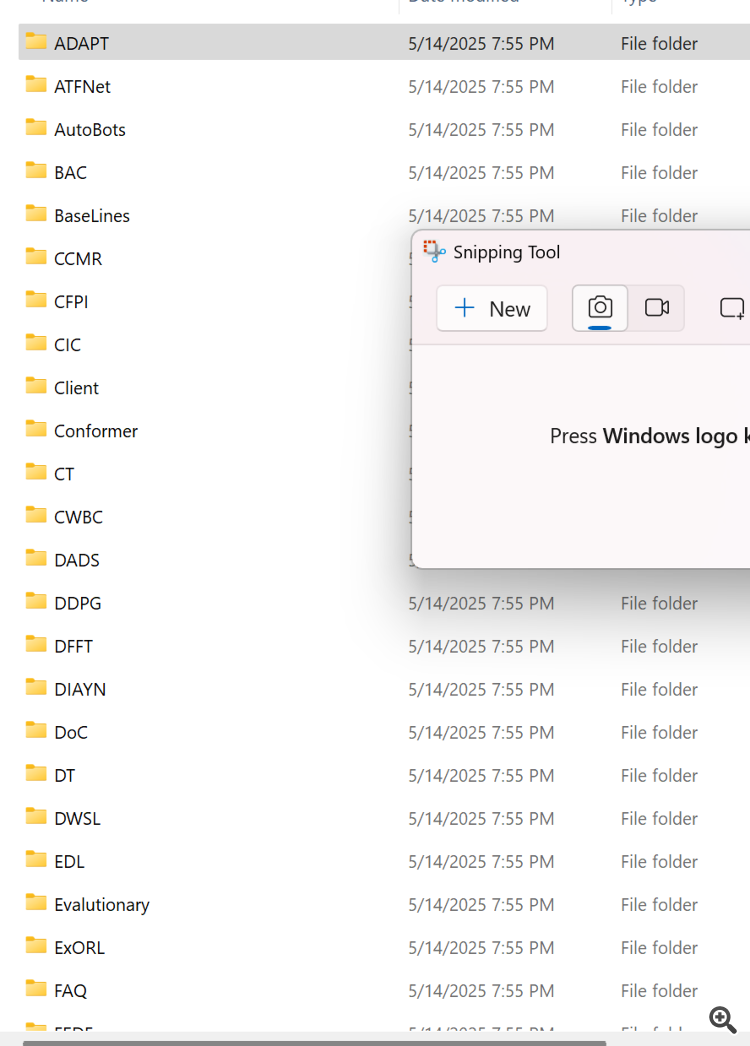

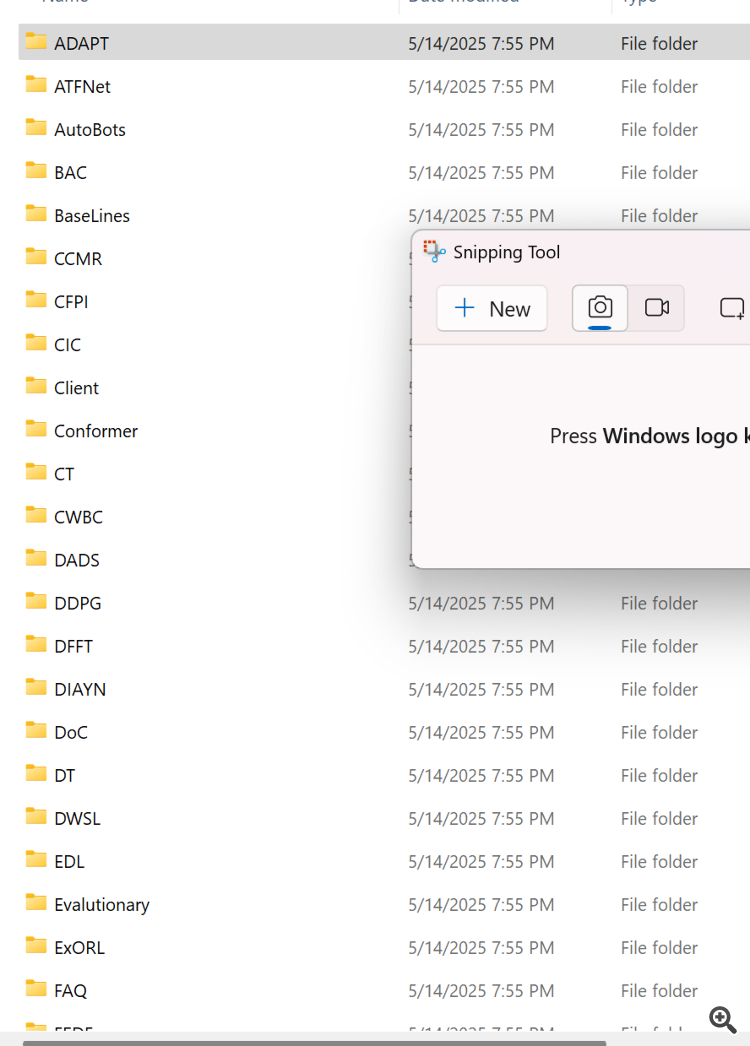

Parece que seus arquivos zip foram criados incorretamente. Eu esperava ver o código-fonte listado na sua caixa, mas é isso que o zip contém. Parece que cada diretório listado contém os arquivos que você usou em seus vários artigos. Você poderia fornecer uma descrição de cada um ou, melhor ainda, anexar o número do artigo a cada diretório, conforme apropriado.

Obrigado

CapeCoddah

Oi Dmitriy,

Parece que seus arquivos zip foram criados incorretamente. Eu esperava ver o código-fonte listado na sua caixa, mas é isso que o zip contém. Parece que cada diretório listado contém os arquivos que você usou em seus vários artigos. Você poderia fornecer uma descrição de cada um ou, melhor ainda, anexar o número do artigo a cada diretório, conforme apropriado.

Muito obrigado

CapeCoddah

Oi CapeCoddah,

O arquivo zip contém arquivos de todas as séries. O programa OpenCL foi salvo em "MQL5\Experts\NeuroNet_DNG\NeuroNet.cl". A biblioteca com todas as classes pode ser encontrada em "MQL5\Experts\NeuroNet_DNG\NeuroNet.mqh". E o modelo e os especialistas mencionados neste artigo estão localizados no diretório "MQL5\Experts\MAFT\"

Atenciosamente,

Dmitriy.

Oi CapeCoddah,

O arquivo zip contém arquivos de todas as séries. O programa OpenCL foi salvo em "MQL5\Experts\NeuroNet_DNG\NeuroNet.cl". A biblioteca com todas as classes pode ser encontrada em "MQL5\Experts\NeuroNet_DNG\NeuroNet.mqh". E o modelo e os especialistas mencionados neste artigo estão localizados no diretório "MQL5\Experts\MAFT\"

Atenciosamente,

Dmitriy.

Olá, Dmitriy,

Obrigado pela pronta resposta. Entendo o que você está dizendo, mas acho que você não me entendeu. Como faço para associar os nomes dos subdiretórios ao respectivo artigo, seja por nome ou por número de artigo, a partir do qual é possível pesquisar para encontrar o artigo.

Abraços

CapeCoddah

Oi Dmitriy,

Obrigado pela resposta rápida. Entendo o que você está dizendo, mas acho que você não me entendeu. Como faço para associar os nomes dos subdiretórios ao respectivo artigo, seja por nome ou por número de artigo, a partir do qual é possível pesquisar para encontrar o artigo.

Obrigado

CapeCoddah

Pelo nome da estrutura

- Aplicativos de negociação gratuitos

- 8 000+ sinais para cópia

- Notícias econômicas para análise dos mercados financeiros

Você concorda com a política do site e com os termos de uso

Novo artigo Redes neurais em trading: Abordagem sem máscara para previsão do movimento de preços foi publicado:

Neste artigo, apresentamos o método Mask-Attention-Free Transformer (MAFT) e sua aplicação na área de trading. Ao contrário dos Transformers tradicionais, que exigem mascaramento de dados ao processar sequências, o MAFT otimiza o processo de atenção, eliminando a necessidade de mascaramento, o que melhora significativamente a eficiência computacional.

O algoritmo SPFormer é um pipeline totalmente end-to-end que permite que as consultas de objetos gerem previsões diretas das instâncias. Com o uso de decodificadores Transformer, um número fixo de consultas aos objetos agrega informações globais dos objetos na nuvem de pontos analisada. Além disso, SPFormer utiliza máscaras de objetos para orientar a atenção cruzada, garantindo que as consultas considerem apenas as características mascaradas. No entanto, nos estágios iniciais do treinamento, são utilizadas máscaras de baixa qualidade. Isso impede a obtenção de bons resultados nas camadas subsequentes, aumentando a complexidade do treinamento do modelo.

Por esse motivo, os autores do método MAFT introduzem uma tarefa auxiliar de regressão do centro para gerenciar a segmentação de instâncias. Primeiro, as posições globais 𝒫 são selecionadas a partir da nuvem de pontos original, e os recursos globais dos objetos ℱ são extraídos utilizando a espinha dorsal base. Esses recursos podem ser tanto voxels quanto Superpoints. Além das consultas de conteúdo 𝒬0c, os autores do MAFT introduzem um número fixo de consultas posicionais 𝒬0p, que representam os centros normalizados dos objetos. 𝒬0p é inicializado aleatoriamente, enquanto 𝒬0ccomeça com valores nulos. O objetivo principal é permitir que as consultas posicionais orientem as respectivas consultas contextuais na atenção cruzada e, em seguida, refinem iterativamente ambos os conjuntos de consultas para prever os centros dos objetos, suas classes e máscaras.

Autor: Dmitriy Gizlyk