havalı

makale için teşekkürler!

Kullanışlı bir senaryo, teşekkürler.

Ben de biraz pişirdim :

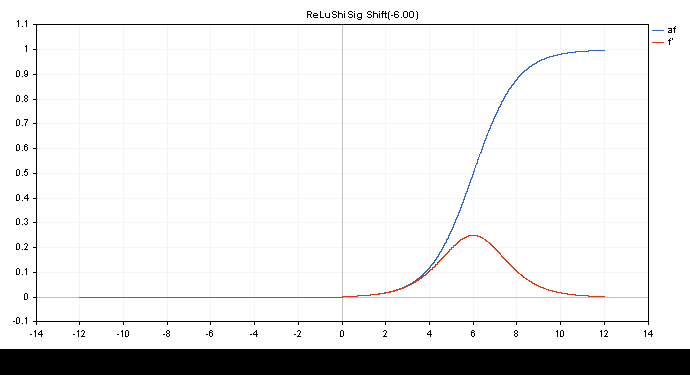

ReLu + Sigmoid + 0.0'dan 1.0'a çıkışı yakalamak için Shift (giriş -12'den 12'ye)

double activationSigmoid(double x){ return(1/(1+MathExp(-1.0*x))); } double derivativeSigmoid(double activation_value){ return(activation_value*(1-activation_value)); } double activationReLuShiSig(double x,double shift=-6.0){ if(x>0.0){ return(activationSigmoid(x+shift)); } return(0.0); } double derivativeReLuShiSig(double output){ if(output>0.0){ return(derivativeSigmoid(output)); } return(0.0); }

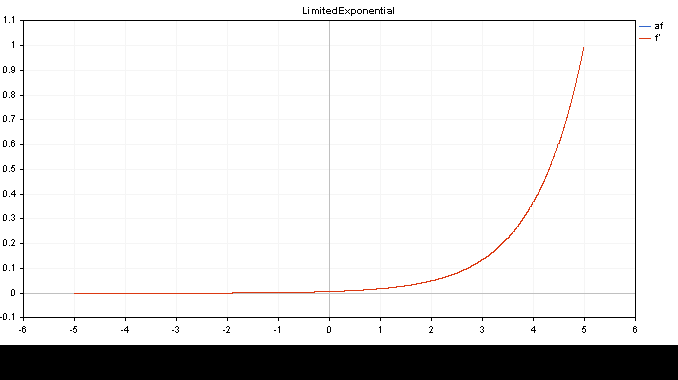

Sınırlı üstel.af=f' (giriş -5.0 ila 5.0)

double activationLimitedExponential(double x){ return(MathExp(x)/149.00); } //ve türevin kendisi double derivativeLimitedExponential(double x){ return(x); }

👨🔧

Alım-satım fırsatlarını kaçırıyorsunuz:

- Ücretsiz alım-satım uygulamaları

- İşlem kopyalama için 8.000'den fazla sinyal

- Finansal piyasaları keşfetmek için ekonomik haberler

Kayıt

Giriş yap

Web sitesi politikasını ve kullanım şartlarını kabul edersiniz

Hesabınız yoksa, lütfen kaydolun

Yeni makaleye göz atın: MQL5'te matrisler ve vektörler: Aktivasyon fonksiyonları.

Burada makine öğreniminin sadece bir yönünü - aktivasyon fonksiyonlarını - açıklayacağız. Yapay sinir ağlarında, bir nöron aktivasyon fonksiyonu, bir girdi sinyalinin veya bir dizi girdi sinyalinin değerlerine dayalı olarak bir çıktı sinyali değerini hesaplar. Sürecin iç işleyişini derinlemesine inceleyeceğiz.

Aktivasyon fonksiyonunun ve türevlerinin grafikleri -5'ten 5'e kadar monoton olarak artan bir sırayla çizimler olarak hazırlanmıştır. Fonksiyon grafiğini fiyat grafiğinde görüntüleyen komut dosyası da geliştirilmiştir. Page Down tuşuna basıldığında, kaydedilen görüntünün adını belirtmek için bir dosya açma iletişim kutusu görüntülenir.

ESC tuşu komut dosyasını sonlandırır. Komut dosyasının kendisi aşağıda eklenmiştir.

Yazar: MetaQuotes