酷

感谢您的文章!

剧本很实用,谢谢。

我也制作了一些:

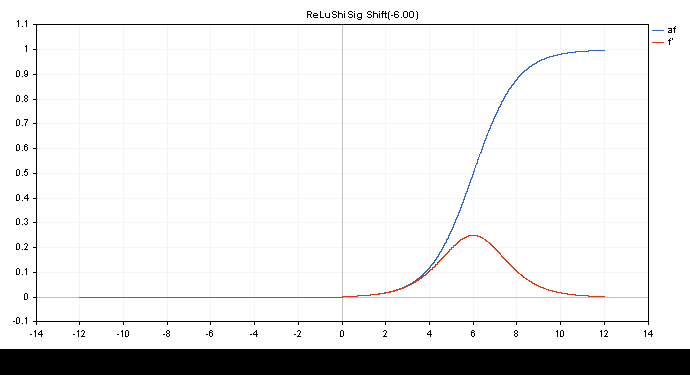

ReLu + Sigmoid + Shift 捕获从 0.0 到 1.0 的输出(输入 -12 到 12)

double activationSigmoid(double x){ return(1/(1+MathExp(-1.0*x))); } double derivativeSigmoid(double activation_value){ return(activation_value*(1-activation_value)); } double activationReLuShiSig(double x,double shift=-6.0){ if(x>0.0){ return(activationSigmoid(x+shift)); } return(0.0); } double derivativeReLuShiSig(double output){ if(output>0.0){ return(derivativeSigmoid(output)); } return(0.0); }

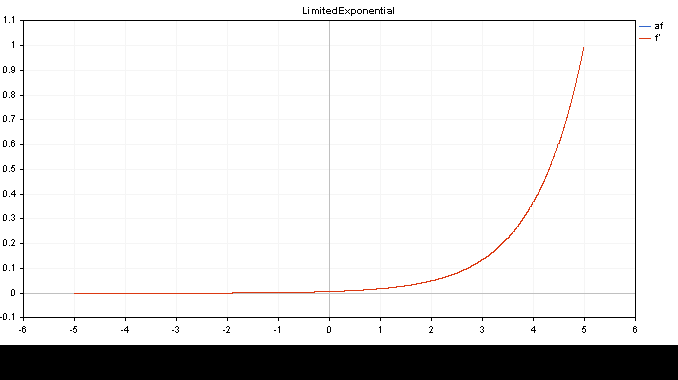

有限指数.af=f' (输入 -5.0 至 5.0)

double activationLimitedExponential(double x){ return(MathExp(x)/149.00); } //而导数本身就是 double derivativeLimitedExponential(double x){ return(x); }

👨🔧

新文章 MQL5 中的矩阵和向量:激活函数已发布:

在此,我们将只讲述机器学习的一个方面 — 激活函数。 在人工神经网络中,神经元激活函数会根据一个或一组输入信号的数值,计算输出信号值。 我们将深入研究该过程的内部运作。

激活函数及其导数的图形基于从 -5 到 5 的单调递增序列来描图。 在价格图表上显示函数图的脚本也已开发完毕。 显示打开文件对话框,可通过按 “下一页(Page Down)”键来指定保存图像的文件名称。

ESC 键终止脚本。 脚本本身附在下面。

作者:MetaQuotes