Обсуждение статьи "Машинное обучение и Data Science (Часть 23): Почему LightGBM и XGBoost лучше многих ИИ-моделей?"

Вы упускаете торговые возможности:

- Бесплатные приложения для трейдинга

- 8 000+ сигналов для копирования

- Экономические новости для анализа финансовых рынков

Регистрация

Вход

Вы принимаете политику сайта и условия использования

Если у вас нет учетной записи, зарегистрируйтесь

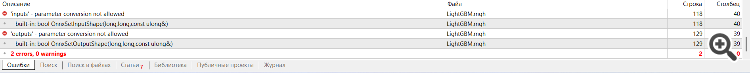

Опубликована статья Машинное обучение и Data Science (Часть 23): Почему LightGBM и XGBoost лучше многих ИИ-моделей?:

LightGBM и XGBoost — продвинутые методы построения деревьев решений с использованием градиентного бустинга, они обеспечивают превосходную производительность и гибкость, что делает их идеальными для финансового моделирования и алгоритмической торговли. В этой статье мы поговорим о том, как использовать эти инструменты для оптимизации торговых стратегий, повышения точности прогнозов и получения выгоды на финансовых рынках.

Деревья решений с градиентным бустингом (Gradient Boosted Decision Trees, GBDT) — это эффективный метод машинного обучения, используемый в основном для задач регрессии и классификации. Они объединяют прогнозы нескольких слабых учеников, обычно деревьев решений, для создания сильной прогностической модели.

Основная идея заключается в последовательном построении моделей, при этом каждая новая модель пытается исправить ошибки, допущенные предыдущими.

Примеры деревьев с бустингом:

Эти алгоритмы приобрели большую популярность в сообществе машинного обучения — многие победители в командных соревнованиях по машинному обучению используют именно их. В этой статье мы узнаем, как эти точные модели можно использовать в торговых приложениях.

Автор: Omega J Msigwa