1) A grade é capaz de recuperar a função se os dados de entrada a contiverem. Se no último experimento o valor do período depende da volatilidade, então a grade deve ter dado alguma estimativa dessa volatilidade, ou seja, você pode não ter fornecido todos os dados necessários para a recuperação.

2) Você pode espremer tudo o que precisa fora do MLP. Use outras redes quando puder provar matematicamente que usar outra arquitetura é melhor do que o MLP.

3)NS2 - resultado rápido, de qualidade, fácil de transferir para qualquer lugar...

Esse não é sequer o problema principal. Bem OK, você ensinou à grade a entender que 2x2=4, e até mesmo que um simples abafamento é a média aritmética dos preços. Mas como você ensina a grade a prever? É aqui que surge a principal questão sobre a capacidade mental da rede.

O erro no teste deixa de diminuir... Normalmente faço pelo menos 3-5 treinamentos, talvez mais quando o resultado é mais importante, com seleção de neurônios em camadas, mais precisamente em uma camada. alguns treinamentos para ver o espalhamento e mínimo.

Na minha opinião, quando o erro no teste deixa de diminuir, é muito provável que haja sobretreinamento. Como a rede se comporta no OOS, com um erro tão mínimo no teste?

Se os neurônios forem selecionados corretamente, a rede se comporta absolutamente da mesma forma que no treinamento, ainda mais com uma amostra de 200 000, o mesmo resultado é obtido com uma amostra de treinamento muito menor (mais de 5 vezes menor).

Isto é, às vezes selecionando neurônios podemos equalizar os erros da amostra de teste e treinamento.

Se os neurônios forem selecionados incorretamente, o erro no teste é um pouco maior, mas permanece na amostra "geral".

- Aplicativos de negociação gratuitos

- 8 000+ sinais para cópia

- Notícias econômicas para análise dos mercados financeiros

Você concorda com a política do site e com os termos de uso

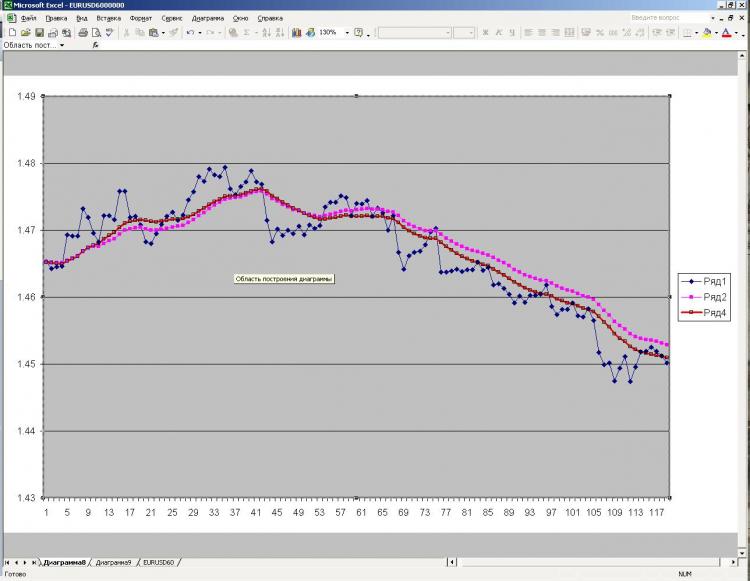

Cavalheiros, boa tarde. Uma pergunta para especialistas na área de redes neurais. O resultado final é este. Instalei a statisctica e comecei minha pesquisa com redes neurais automáticas. Multilayer perspetron. Estabeleci um objetivo para entender o quanto as redes neurais inteligentes são capazes de encontrar padrões. O que eu fiz? Levou o LVSS mais usual (média ponderada linearmente) para as últimas 20 barras. Dei o último valor do LSS como meta (saída) e os últimos 20 pontos dos quais depende o valor atual do LSS. Obviamente, uma pessoa conhecendo os últimos 20 pontos e a fórmula de cálculo do LVLS seria capaz de restaurar 100% de seu valor. A grade não conhecia a fórmula e sua tarefa era compreendê-la à sua própria maneira. Resultado - a pilha restaurou o LFSS em 100%, ou seja, entendeu como o LFSS está arranjado. Podemos considerar que ela lidou perfeitamente com a tarefa, ou seja, se existe um padrão, a rede realmente o encontra. Em seguida, foi realizada uma experiência semelhante com EMA, SAR e osciladores. O resultado é o mesmo. 100%. Depois disso, decidi complicar a tarefa. Eu peguei a média adaptativa. Deixe-me lembrar que isso muda o parâmetro de média, dependendo da volatilidade do mercado. A volatilidade, por sua vez, é calculada para uma certa quantidade de barras. Introduzo todas as barras necessárias para construir o ACS e iniciar a rede. O resultado foi muito pior do que 100%, embora uma pessoa conhecendo a fórmula do ACC e possuindo todos os pontos fosse capaz de construir o ACC a 100%. Na verdade, a rede falhou, estamos falando de redes neuronais automáticas.

Conclusão e perguntas aos especialistas na área.

1) Eu acertei que uma rede neural é incapaz de reconstruir uma função se ela for inerentemente dinâmica como no caso do ACC, mesmo que eu tenha todos os dados necessários para o cálculo, pois se a fórmula for rigidamente estática como no caso do LVSS ou EMA, não há problema.

2) Se eu estiver errado, quais redes devem ser usadas? E utilizou o MLP em estatísticas.

3) Ouvi a opinião de que as redes automotivas e as redes de desenho próprio e...., se me é permitido dizê-lo, não há fundamentalmente muita diferença. É este realmente o caso?

4) Que redes e que programas você aconselharia para aplicação nos mercados financeiros, em particular para a tarefa que descrevi, ou seja, restaurar valores a partir de todos os dados conhecidos.

Respeitosamente, mrstock