そして現在も将来も、すべての計算はRで行うが、Pythonのパッケージ(モジュール)を使う。たくさんあるよ。

わかった、偽造してみるよ :)

はじめまして、azzeddineです、

Kerasは、構造的に複雑なモデルを構築するために最小限のコード量で済むという意味で、人間のために設計されています。もちろん、私たちはEAでこれらのモデルを使うことができますし、使うべきです。これは解決され、解決された問題に過ぎない。そうでなければ、なぜこのような練習が必要なのでしょうか?

もちろん、ツイッターのテキストメッセージやブロムバーグのニュースフィードの ムードを追跡・分析するモデルを構築することもできる。これは私がテストしたことのない別の分野であり、率直に言ってあまり信じていない。しかし、このトピックに関する例はインターネット上にたくさんある。

まずは簡単なものから始めてみてはどうだろう。

幸運を祈る。

ウラジミールさん、こんにちは。私はプログラマーで、主に.NET、c#を使用しています。あなたの記事に基づいて、mt5ターミナル用のExpert Advisorを作成しました。私はGPUサポートのKerasを使用しており、モデルのトレーニングにかかる時間と神経を節約し、R.Netを介してRとmt5をリンクしています(私はライブラリDLLを書きました。)H2Oも試しましたが、動作が遅く、GPUサポートはlinuxのみで、適していません。あなたの記事でKerasに切り替えたことをうれしく思う。Expert AdvisorはEURUSD 15Mで良い結果を示しました。データサンプルは2003年から2017年まで(トレーニング、テスト)、私はv.fatl、v.rbci、v.ftlmの3つの予測変数のみを使用しました。Expert Advisorはあなたのものとほとんど同じですが、少し修正して、損切り500、利食い100、私は10以上のポジションを開かず、すべてのポジションを閉じます。 新しいポジションがあれば、買います。まあ、このコードはすべてEURUSDのためのものであり、他の相場では、おそらくすべてが異なる方法で行う必要があります。

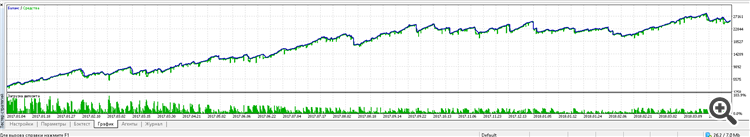

2017年から現在までのExpert Advisorの作業結果です:

セント口座にExpert Advisorを入れて2週間テストしたが、今のところプラスで機能している。ニューラルネットワークモデルの検索とテストに多くの時間を費やし、Dense、LSTM、CONVネットワークのさまざまなバリエーションを試しましたが、私はシンプルなDenseに止まりました。また、さまざまな予測因子の選択、DigFiltr+あらゆる種類の指標、あなたの予測因子は、追加指標なしで最高の結果を示しました。私はこれが限界ではなく、もっと良いEAを作ることができると思います。もしよろしければ、私の成功についてもお知らせします。

Pythonのkeras/TensorFlowパッケージを使ってニューラルネットワークを構築する。

Rの何が問題なのか

keras:「Keras」へのRインターフェース

kerasR: KerasディープラーニングライブラリへのRインターフェース

- cran.r-project.org

ウラジミールさん、こんにちは。私はプログラマーで、主に.NET、c#を使用しています。あなたの記事に基づいて、mt5ターミナル用のExpert Advisorを作成しました。私はGPUサポートのKerasを使用しており、モデルのトレーニングにかかる時間と神経を節約し、R.Netを介してRとmt5をリンクしています(私はライブラリDLLを書きました。)H2Oも試しましたが、動作が遅く、GPUサポートはlinuxのみで、適していません。あなたの記事でKerasに切り替えたことをうれしく思う。Expert AdvisorはEURUSD 15Mで良い結果を示しました。データサンプルは2003年から2017年まで(トレーニング、テスト)、私はv.fatl、v.rbci、v.ftlmの3つの予測変数のみを使用しました。Expert Advisorはあなたのものとほとんど同じですが、少し修正して、損切り500、利食い100、私は10以上のポジションを開かず、すべてのポジションを閉じます。 新しいポジションがあれば、買います。まあ、このコードはすべてEURUSDのためだけのものであり、他の引用符のために、それは別のすべてを行う必要があるかもしれません。

ここに2017年から現在までのExpert Advisorの作業結果があります:

セント口座にExpert Advisorを導入し、2週間テストしましたが、今のところプラスで機能しています。ニューラルネットワークモデルの検索とテストに多くの時間を費やし、Dense、LSTM、CONVネットワークのさまざまなバリエーションを試しましたが、私はシンプルなDenseに止まりました。また、さまざまな予測因子の選択、DigFiltr+あらゆる種類の指標、あなたの予測因子は、追加指標なしで最高の結果を示しました。私はこれが限界ではなく、もっと良いEAを作ることができると思います。もしよろしければ、私の成功についてもお知らせします。

こんにちは、ユージーン。

私の記事の資料がお役に立てたようで嬉しいです。いくつか質問があります。

1.私が理解する限り、あなたはRのためにkerasを使用していますか? あなたはRまたはPythonでスクリプトを書いていますか?

2.私たちが使用しているゲートウェイライブラリは、あなたのために動作しませんでしたか?こちらを 参照してください。

3.ライブラリのバージョンとスクリプトの例を投稿してください。見て、試して、比較するのは面白いです。

4.もちろん、私も、そして多くの愛好家も、あなたの実験にとても興味があると思います。

5.言語やモデルに関する具体的な質問について、氾濫することなく議論することが可能な、別のRUSERGroopスレッドを開くことを、私は長い間考えていました。夢

Python(reticulate)へのAPIの登場は、どんな複雑なシステム構築にもほぼ無限の可能性を開く。近い将来、ニューラルネットワークと並行して強化学習でトレーニングする計画がある。

あなたの成功について書き、質問してください。

幸運を祈る。

- 無料取引アプリ

- 8千を超えるシグナルをコピー

- 金融ニュースで金融マーケットを探索

新しい記事 ディープニューラルネットワーク(その7)ニューラルネットワークのアンサンブル: スタッキング はパブリッシュされました:

アンサンブルの構築を続けます。今回は、以前に作成したバギングアンサンブルに、訓練可能な結合器、つまりディープニューラルネットワークが追加されます。ニューラルネットワークの1つは、刈り込み後に7つの最良アンサンブル出力を組み合わせます。2つ目はアンサンブルの500個の出力をすべて入力として取り込み、刈り込んで結合します。ニューラルネットワークは、Python用のKeras/TensorFlowパッケージを使用して構築されます。このパッケージの特徴には簡単に触れます。テストが実行されて、バギングアンサンブルとスタッキングアンサンブルの分類品質が比較されます。

訓練履歴をプロットしましょう。

図11 DNN500ニューラルネットワーク訓練履歴

分類品質を向上させるために、ニューロンの初期化方法、ニューロンの活性化の正則化およびその重みなど、多くのハイパーパラメータを変更することができます。ほぼ直観的に選択されたパラメータで得られた結果は、有望な品質を有しますが、失望もあります。最適化なしでは、精度を0.82以上に上げることはできませんでした。結論は、ニューラルネットワークのハイパーパラメータを最適化する必要があるということです。前回の記事では、ベイジアン最適化を実験しました。ここでも同様に適用はできますが、これは別の難しいトピックです。

作者: Vladimir Perervenko