記事"ニューロネット用レシピ"についてのディスカッション 新しいコメント MetaQuotes 2016.04.22 12:18 新しい記事 ニューロネット用レシピ はパブリッシュされました:本稿は、『多層』ケーキを焼く初心者を対象としています。例を用いてこの概念をお話します。可視化のためには、計算はすべて二次元の入力ベクトルとして出されます。図1 では、入力ベクトルが色づきで表示されています。コホーネン層(その他の層のように)のニューロンはすべて、単純にインプットをウェイトで掛け、合計しま す。実際、コホーネン層のウェイトはすべてこのニューロンに対するベクトル座標です。 よって、コホーネンニューロンそれぞれのアウトプットは2つのベクトルの内積です。幾何学から、ベクトル間の角度が傾けば(角度のコサインが1に傾 く)、最大内積はゼロになることがわかっています。よって、最大値は入力ベクトルにもとも近いコホーネンニューロンの値なのです。 図1 勝者はそのベクトルが入力シグナルにもっとも近いニューロンである作者: o_O 新しいコメント 取引の機会を逃しています。 無料取引アプリ 8千を超えるシグナルをコピー 金融ニュースで金融マーケットを探索 新規登録 ログイン スペースを含まないラテン文字 このメールにパスワードが送信されます エラーが発生しました Googleでログイン WebサイトポリシーおよびMQL5.COM利用規約に同意します。 新規登録 MQL5.com WebサイトへのログインにCookieの使用を許可します。 ログインするには、ブラウザで必要な設定を有効にしてください。 ログイン/パスワードをお忘れですか? Googleでログイン

新しい記事 ニューロネット用レシピ はパブリッシュされました:

本稿は、『多層』ケーキを焼く初心者を対象としています。

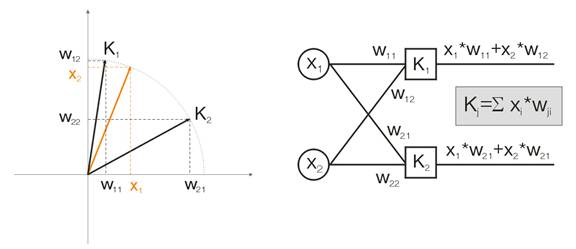

例を用いてこの概念をお話します。可視化のためには、計算はすべて二次元の入力ベクトルとして出されます。図1 では、入力ベクトルが色づきで表示されています。コホーネン層(その他の層のように)のニューロンはすべて、単純にインプットをウェイトで掛け、合計しま す。実際、コホーネン層のウェイトはすべてこのニューロンに対するベクトル座標です。

よって、コホーネンニューロンそれぞれのアウトプットは2つのベクトルの内積です。幾何学から、ベクトル間の角度が傾けば(角度のコサインが1に傾 く)、最大内積はゼロになることがわかっています。よって、最大値は入力ベクトルにもとも近いコホーネンニューロンの値なのです。

図1 勝者はそのベクトルが入力シグナルにもっとも近いニューロンである作者: o_O