你能对经过培训的历史片段进行测试吗?

Sergey Chalyshev 遗传算法的 文章都是虚构的。 2.实际测试与文章不符 ((

1.这篇文章是关于简单的 MLP 网络使用,而不是关于优化算法(所有这些算法都被你错误地称为遗传算法)。什么是虚构?源代码附在文章后面,结果正是我自己得到的。

2.哪些测试和哪些文章与真实测试不符?最好能举例说明这种 "不吻合",以便进行有意义的交流。

如果我们谈论这篇文章中的 MLP 专家顾问,我们就应该明白,它只使用了两个简单的指标和归一化的柱值作为输入,也就是说,输入神经元的信息相当原始,因此我们不应该期待有很好的结果。文章中介绍的 MLP 智能交易系统仅用于教学目的,以便了解如何快速、轻松地开始使用神经网络。当然,有必要对馈送给神经网络的信息进行实验,很难指望有人会在文章中发布一个现成可用的圣杯(不劳而获)。

如果我们谈论文章中描述的优化算法,它们都是现成可用的工具,没有任何使用条件和限制。

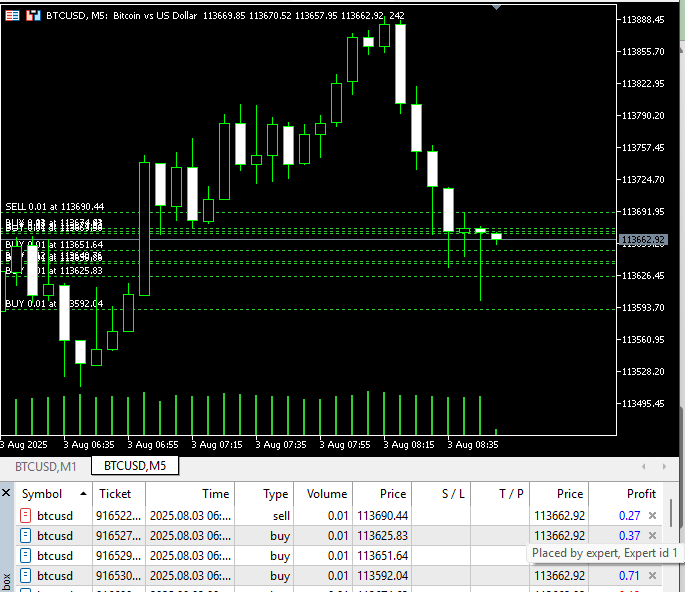

近在咫尺的对面信号失灵

你好,安德烈、

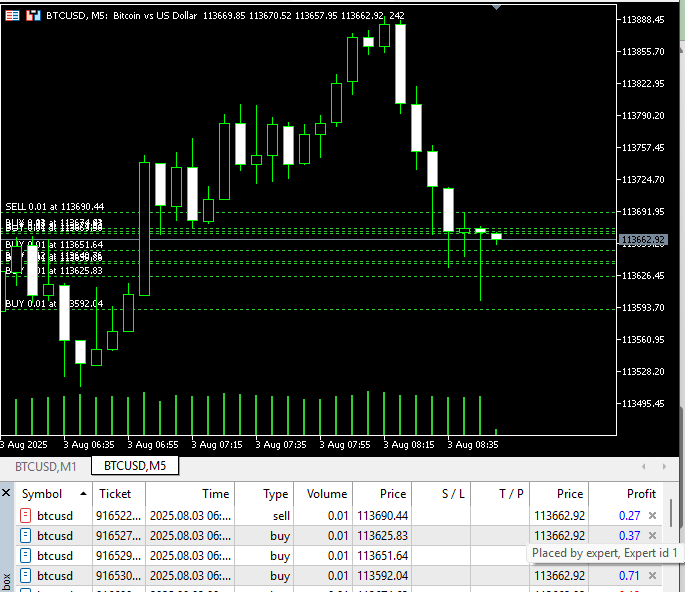

这篇文章看起来很不错,我很感兴趣。 不过,我很困惑。 首先,我发现两个压缩包中都没有包含 #C_AO 和 #C_AO_enum。对我来说,这些变量似乎是从图表设置中获取的。

你好,安德烈、

知道了,谢谢您的快速回复。

科达角

新文章 基于通用 MLP 逼近器的EA已发布:

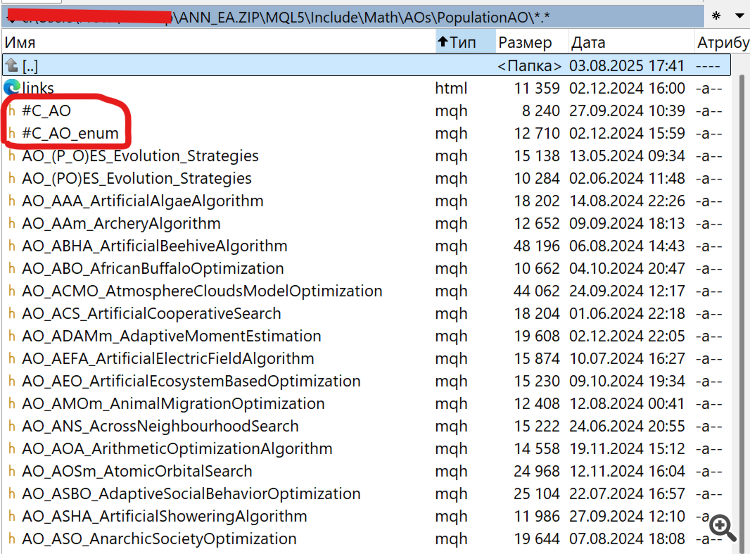

我提出的方法属于第二种类型——无监督学习。在这种方法中,我们不试图“教会”神经网络如何正确交易,也不告诉它在哪里开仓或平仓,因为我们自己也不知道这些问题的答案。相反,让网络自己做出交易决策,而我们的工作是评估其整体的交易结果。

在这种情况下,我们不需要对评估函数进行归一化,也无需担心“权重爆炸”和“网络停滞”等问题,因为在这种方法中它们根本不存在。我们从代码逻辑上将神经网络与优化算法分离开来,只赋予它一项任务:将输入数据转换为一种反映交易员技能的新型信息。本质上,我们只是将一种信息转换为另一种信息,而无需理解时间序列中的模式,也无需知道如何交易才能盈利。

MLP(多层感知机)这类神经网络非常适合扮演这个角色,通用逼近定理也证实了这一点。该定理指出,神经网络可以逼近任何连续函数。在我们的案例中,“连续函数”指的是在被分析的时间序列中发生的过程。这种方法使我们无需诉诸于“噪声”和“过拟合”这类人为且主观的概念,因为它们没有量化价值。

图例 1. 将一种类型的信息转换位另一种类型

作者:Andrey Dik