Maxim Dmitrievsky #: 힘들지 않나요? 임계값이 없는 원시 확률과 임계값이 이미 있는 클러스터 비교

사진에서 불연속형과 연속형을 비교하고 있는 것을 볼 수 있습니다. 그리고 그는 허공에서 임계값을 그리고 있습니다. 그리고 그 모자를 증거로 사용하고 있습니다.

왜 그래프에 그 선을 그리지 않았을까요? 똑같습니다.

사실, 유사성이 있고, 선은 패턴의 평균이며, 예, 많을수록 적으며, 움직임을 특성화하는 방법은 무엇입니까? 이동 한 거리로만, 거리는 가장 작은 거리, 즉 격자에 의해서만 가능합니다. 예, 불연속형 엔티티는 연속형 엔티티보다 더 복잡하지만 우리가 가진 것은 우리가 작업하는 것입니다)).

모든 클러스터링 또는 분류기에는 확률, 전환 또는 거리의 행렬이 있습니다. 이를 원시값이라고 합니다. 그리고 클래스/클러스터 레이블이 있습니다. 서로 다른 것을 비교하는 것입니다.

네, 하지만 완전히 정확하지는 않습니다. 저는 현재 상태를 설명하고 미래를 예측하는 데 이 방법을 선호합니다. 이러한 작업은 본질적으로 동일합니다. 상태의 변화는 현재 상태에 대한 설명이긴 하지만 예측입니다))))

네, 하지만 완전히 정확하지는 않습니다. 저는 현재 상태를 설명하고 미래를 예측하는 데 이 방법을 선호합니다. 이 두 작업은 본질적으로 동일합니다. 상태의 변화는 현재 상태에 대한 설명이지만 예측입니다))))

분명합니다. 오빠와 손가락을 비교하는 한 저는 더 이상 대화에 참여하지 않을 것입니다. 게다가 제가 시작하지 않았습니다.

본질적으로 미래 확률과 상태 클러스터링은 동일한데, 차이점은 무엇인가요?

기본적으로 미래 확률과 상태 클러스터링은 동일한데, 차이점은 무엇인가요?

힘들지 않나요? 임계값이 없는 원시 확률과 임계값이 이미 있는 클러스터 비교

사실, 유사성이 있고, 선은 패턴의 평균이며, 예, 많을수록 적으며, 움직임을 특성화하는 방법은 무엇입니까? 이동 한 거리로만, 거리는 가장 작은 거리, 즉 격자에 의해서만 가능합니다. 예, 불연속형 엔티티는 연속형 엔티티보다 더 복잡하지만 우리가 가진 것은 우리가 작업하는 것입니다)).

차라리 장난감 스트리밍을 할래요. 토요일에 할 일이 또 뭐가 있나요?

https://www.twitch.tv/gamearbuser

레이싱 대회에서 해설자로 아르바이트를 하는 아이가 있습니다)))). 글쎄, 그리고 실제 생활에서도 카트를 타고 직접 스케이트를 타요))))))

저는 컴피티션 레이스에서 해설자로 아르바이트를하는 아이가 있습니다)))). 글쎄, 그리고 카트에서도 실생활에서 그리고 자신도 스케이트를 타요)))))

그가 스케이트를 타는 방법을 스트리밍하게하십시오) 나중에 기부금을 모을 것입니다.

날짜 설정

처음 10개의 주가 정보, 새로운 기능을 만들려면 교육에서 제거해야 합니다.

마지막 줄 - 목표

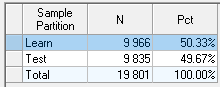

훈련과 테스트를 위해 선택 항목을 반으로 나눕니다.

튜닝 없이 포레스트에서 새로운 데이터를 얻습니다.

에서 새로운 기능으로 테스트한 결과, 아쿠라시 0.83을 얻었습니다.

0,9 아쿠라시를 달성 할 수 있는지 궁금합니다 ?

아무도 건드리지 않았나요? (

그냥 재미로 만져봤어요.)

무작위 숲을 사용했습니다.

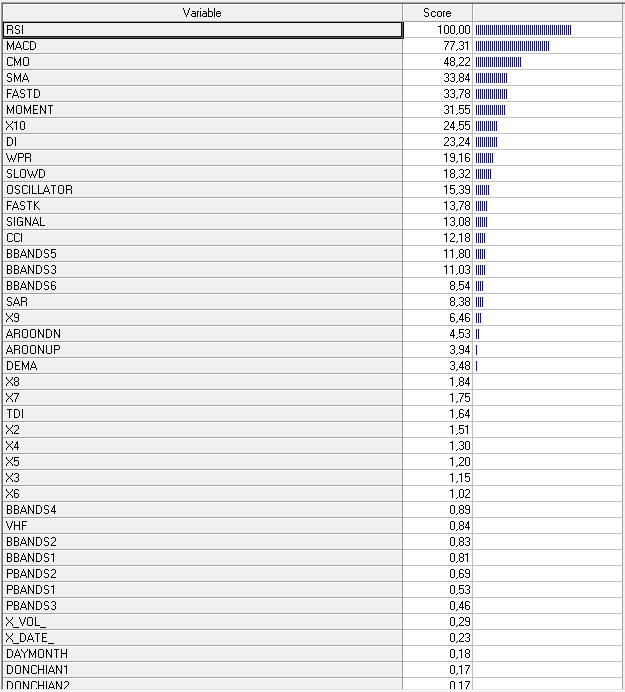

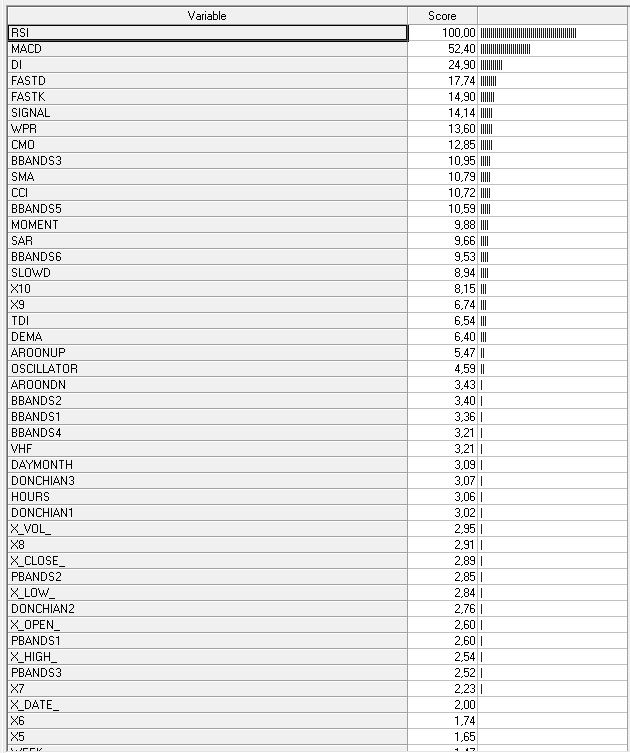

사용되지 않은 변수:

X_OI

X_PER

X_TICKER

요청에 따라 나무를 반으로 자르고 테스트합니다.

최대 나무를 500그루로 제한했습니다.

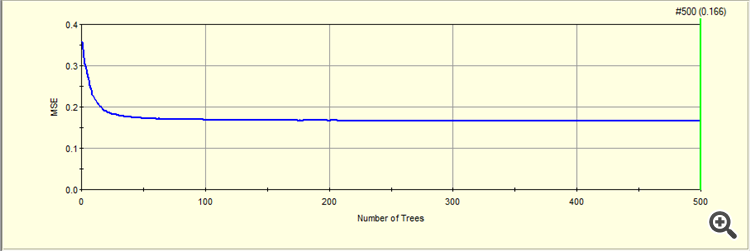

500그루의 나무를 키운 훈련의 MSE

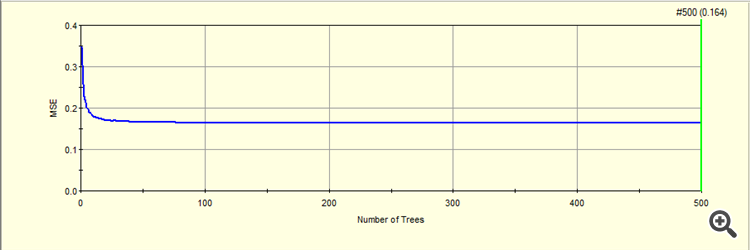

자란 나무 500그루에 대한 MSE 테스트

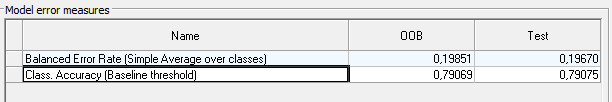

훈련(OOB)과 테스트의 결과 메트릭입니다.

여기서 정확도 0 ,77 무작위 숲을 이 메트릭으로 가져오는 방법을 모르겠습니다.

아마도 MSE를 하나에서빼야 할 것입니다.

1- 0,16 = 0,84

그러면 XGBoost에서와 같은 정확도를 얻을 수 있습니다)).

그리고 훈련에 기여하는 변수들.

제가 얻은 분석 결과는 다음과 같습니다.)

그냥 재미로 만져봤어요)

무작위 숲을 사용했습니다.

사용되지 않은 변수:

X_OI

X_PER

X_TICKER

요청에 따라 절반으로 추적하고 테스트합니다.

내가 쓴 것처럼 ) OHLC 절대 가격도 버려야 할 것입니다.)

500 그루의 자란 나무에 대한 트레이의 MSE

500 그루의 나무에 대한 테스트에 대한 MSE

훈련 (OOB) 및 테스트의 결과 메트릭입니다.

여기서 정확도 0 ,77 무작위 숲을이 메트릭에 가져 오는 방법을 모르겠습니다.

아마도 MSE를 하나에서빼야 할 것입니다,

회귀를 하고 있잖아요, 분류를 하고 있잖아요! 전부 잘못하고 있어요.

이 글을 쓰는 동안 OHLC의 절대 가격도 버려야 할 것입니다.

당신은 회귀를하고 있습니다, 당신은 분류를해야합니다! 당신은 거기에서 모든 것을 잘못하고 있습니다.

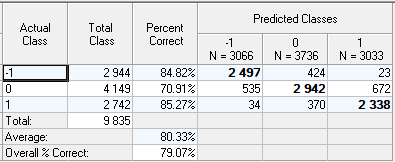

다음은 OHLC를 제외한 분류입니다.

정확도는 0.79입니다.

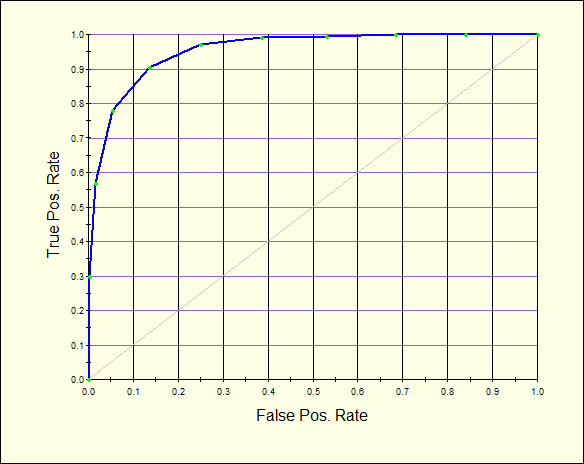

ROC 테스트.

혼동 행렬입니다.

영향 변수